论文分析报告

一、论文摘要

大语言模型中的链式思维推理可能触发"过度思考陷阱":更长的推理路径会增加计算成本和延迟,但往往无法保证准确性的提升。现有方法使用全局、静态的控制策略,可能会抑制必要的推理过程。本文提出了一种基于掌握度门控的样本级软强化学习压缩方法,该方法仅在模型已经解决问题并产生更短的推理路径时才惩罚长输出。在多个基准测试中,该方法将响应长度减少了 20-40%,同时保持或提高准确性,并展现出跨领域的泛化能力:仅在数学问题上训练的模型能自发缩短未见过的任务(代码、指令遵循、常识问答)的输出而不损害准确性。进一步展示了非智能体 CoT 与工具使用智能体之间的双向迁移:非智能体训练将 SWE-Bench Verified 的轮次减少 13%,而压缩思维智能体将 SWE轨迹的 token 数减少 67%、轮次减少 52%,并将非智能体输出缩短最多 44%。因此,压缩不是表面的简洁,而是一种内在的计算策略——决定保留什么,遗忘什么。

二、基本信息

论文 ID: 2601.06052

标题: Reinforcement Learning for Chain of Thought Compression with One-Domain-to-All Generalization

作者:

- Hanyu Li (北京大学 CFCS + 小米 LLM-Core)

- Jiangshan Duo (北京大学多媒体信息处理国家重点实验室 + 小米 LLM-Core)

- Bofei Gao (北京大学多媒体信息处理国家重点实验室 + 小米 LLM-Core)

- Liang Zhao (小米 LLM-Core)

- Hailin Zhang (小米 LLM-Core)

- Sujian Li (北京大学多媒体信息处理国家重点实验室)

- Xiaotie Deng (北京大学 CFCS)

- Fuli Luo (小米 LLM-Core)

单位:

- CFCS, School of Computer Science, Peking University

- State Key Laboratory of Multimedia Information Processing, School of Computer Science, Peking University

- LLM-Core Xiaomi

会议/期刊: arXiv

原文保存位置: ~/.openclaw/workspace/papers/20260407_2601.06052/source/

报告生成日期: 2026-04-07

三、论文主体分析

1 Introduction

生成长链式思维(CoT)显著提升了大语言模型的复杂推理能力。然而,这一成功引入了"过度思考陷阱",其特征是高昂的计算成本、增加的延迟,以及并不总能保证更高准确性的冗长推理路径。本文认为真正的智能表现为压缩。一旦模型掌握了问题解决路径,必然存在更高效的表示。压缩不仅仅是效率的权衡,而是内化成熟能力的指标。

现有方法,包括使用各种长度惩罚的强化学习以及各种形式的蒸馏,奠定了重要基础。它们证明了压缩 CoT 的可行性,并提供了控制计算预算的有价值机制,通常实现了有效的准确性-效率权衡。然而,这些方法通常依赖于全局和静态的控制,如统一惩罚或固定截断限制。

这种"一刀切"策略存在两个关键问题:

- 错误的单位:不能适应个体样本的异质难度,可能无意中惩罚必要的扩展推理

- 错误的时间:在模型可靠掌握问题之前强制缩短解决方案,导致奖励黑客问题

本文提出一种最小干预:仅在模型已掌握的样本上应用软压缩,且仅在超过从其自身正确解决方案推导出的"安全长度"的推理路径上应用。该方法确保难度(与长度区分)得到尊重。模型必须首先学会可靠解决问题;然后才鼓励找到更短路径。本文只在模型明显理解的问题上惩罚过度冗长,而不是在仍在推理的问题上强制截断。

实验揭示了几个关键发现:

- 样本级、门控、软压缩框架显著优于全局惩罚,而硬截断方法灾难性失败

- 门控机制——仅在掌握后压缩——对保持鲁棒性能至关重要

- 压缩技能泛化:在特定领域(如数学)训练压缩推理的模型自发减少所有任务的冗长度

- 识别了稳定的多阶段训练配方,可将平均推理长度减少 20-40% 且准确性相当甚至提高

- 学习到的"高效计算"概念扩展到单轮 CoT:迁移到工具使用智能体,甚至在非智能体推理和智能体轨迹之间展现双向泛化

基于这些发现,本文主张推理压缩应从优化技巧提升为后训练的标准独立阶段。提出稳定课程:首先增强准确性;其次应用安全、门控压缩并早停;最后进行另一准确性增强阶段以恢复或进一步提升性能。这将"压缩即智能"原则转化为可重复的工程过程,能够通过学习何时以及如何压缩来显著提高推理效率。

本文贡献三个方面:

- 提出最小、稳定、样本级门控压缩范式,形式化为实用的后训练配方

- 系统验证机制,从动机到实证现象,提供其动力学、泛化和失败模式的可复现证据

- 将压缩从成本优化技术重构为可测量的能力内化过程,并展示其为适用于纯推理和工具使用设置的智能体无关效率技能

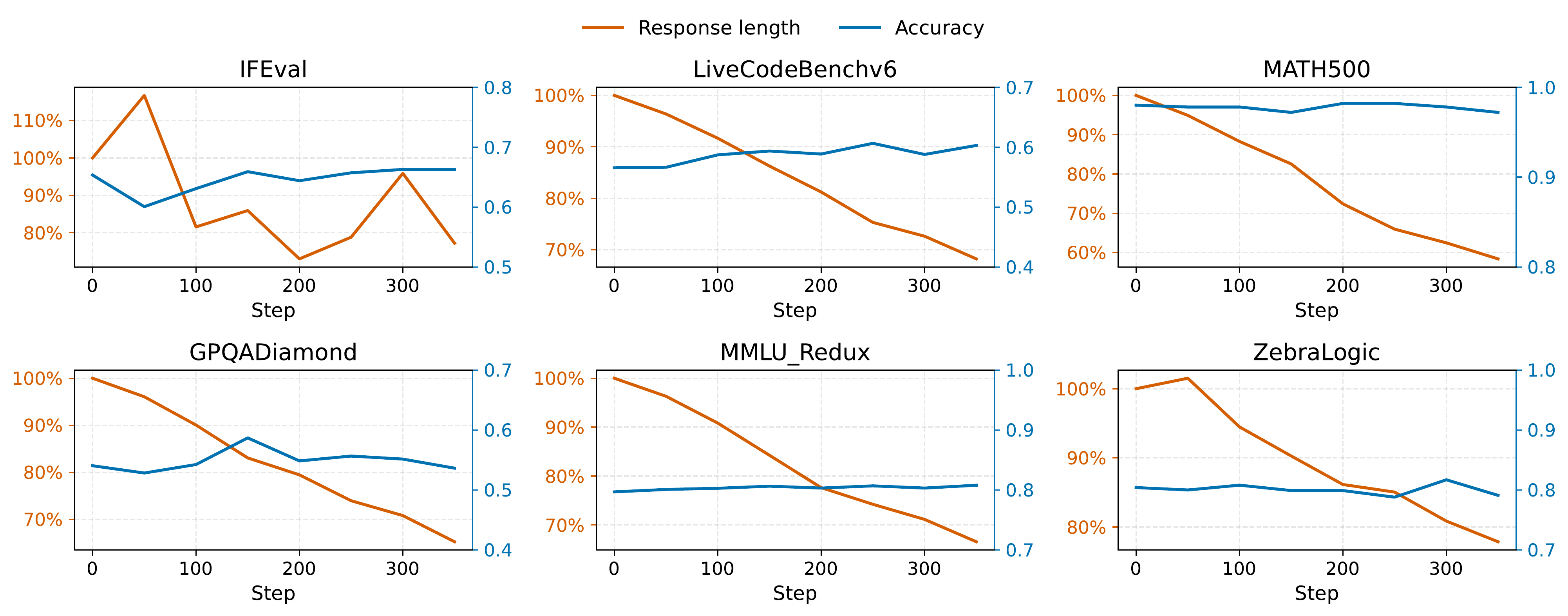

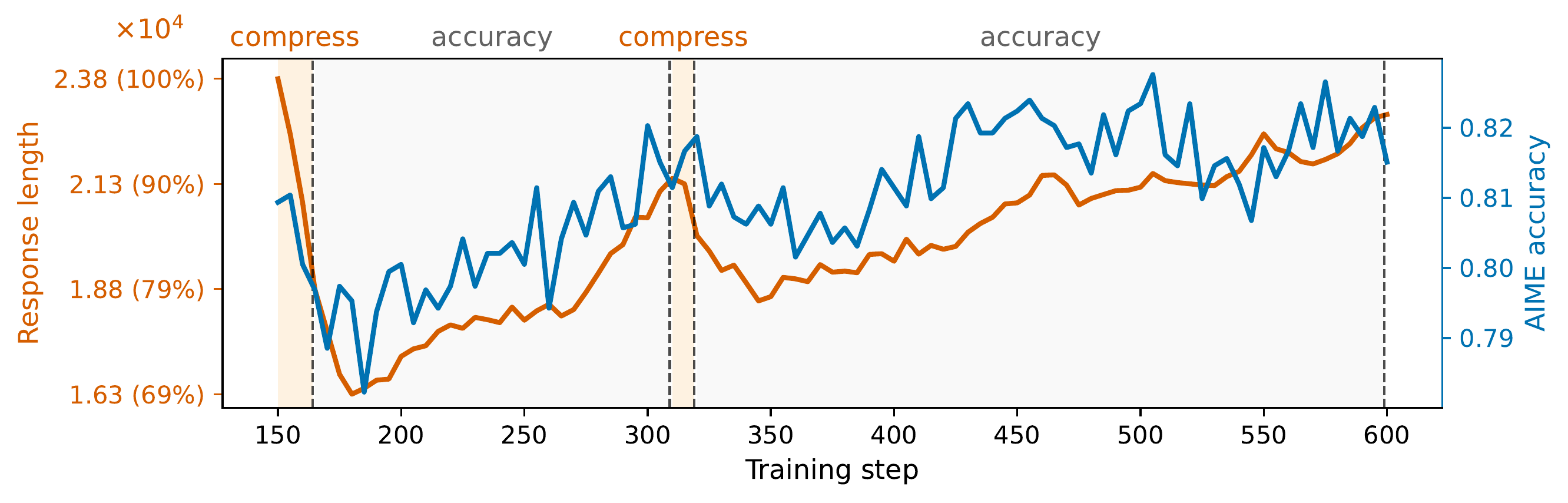

图 1:压缩方法在多种任务上的概览。每个面板展示一个基准测试:橙色曲线为响应长度(token数,在该基准测试起点归一化为100%),蓝色曲线为核心指标(准确性或分数),说明仅在数学问题上的压缩训练广泛缩短链式思维同时保持或提升下游性能。

:::

2 Related Work

2.1 强化学习长度控制

大多数先前工作依赖全局、静态策略:

- ThinkPrune:硬截断

- DLER:截断惩罚 RL

- O1-Pruner:长度协调微调

- L1:约束遵循 RL

- Kimi K1.5:样本级非门控长度惩罚 RL

- DAPO:全局非门控长度惩罚

本文应用样本级、门控、软压缩,仅在掌握后且仅在超过自推导安全长度时触发。

2.2 蒸馏、剪枝和模型合并

相关工作包括:

- CoT 蒸馏(Distilling Step-by-Step, EDIT, D&R Distillation)

- token/计算剪枝和压缩(Efficient Long CoT, DLCoT, TokenSkip, LightThinker, Prune-on-Logic)

- 模型合并(Thinking Spectrum, 模型合并用于长度控制推理)

这些方法追求类似的准确性-效率目标,但本文的循环是在策略上的,仅在模型明显掌握实例时压缩。

3 Method

本文采用标准的可验证奖励强化学习(RLVR)训练策略。只在模型已知道答案的地方压缩。对于每个训练样本,超过样本特定"安全长度"的 token 受到软惩罚,但仅在模型已证明可靠掌握解决该样本之后。

设 $x$ 为输入问题,$y$ 为完整生成的响应(包括链式思维推理和最终答案),$l(y)$ 为其总 token 长度。本文专门测量完整响应长度以防止模型通过将推理内容移至未惩罚的最终答案来黑客奖励。验证器提供二元正确性奖励 $r^{\text{cor}}(x,y) \in \{0, 1\}$。所有用于长度控制的统计量都是在策略上计算的,即从当前模型策略采样的最新推理路径推导,而非来自静态或陈旧数据集。

对于每个样本 $x$ 在当前训练步,生成 $N$ 个在策略推理路径 $\{y_1, ..., y_N\}$。样本当前步的通过率定义为这些推理路径的平均正确性奖励:

$$\hat{p}(x) = \frac{1}{N}\sum_{t=1}^{N} r^{\text{cor}}(x, y_t).$$压缩目标仅在此门被通过时激活,定义为 $\hat{p}(x) = 1.0$。此掌握门作为避免奖励黑客的方式:防止模型在尚未学习的问题上缩短推理,消除通过故意失败问题来提供极短响应的激励。

当门打开(即 $\hat{p}(x) = 1.0$)时,基于当前步正确推理路径子集定义两个样本特定长度目标:

- 安全下界:$L^{\text{start}}(x) = \text{median}\{l(y_t)\}$

- 惩罚上界:$L^{\text{max}}(x) = \max\{l(y_t)\}$

然后应用软惩罚 $r^{\text{len}}(x,y)$ 作为类似于 DAPO 的分段线性函数。短于安全中位数长度($L^{\text{start}}$)的响应不受惩罚。超过最大观测正确长度($L^{\text{max}}$)的响应受到完全惩罚 $-1$。长度介于两者之间的响应受到线性惩罚:

$$r^{\text{len}}(x,y) = \begin{cases} 0, & \text{if } l(y) \le L^{\text{start}}(x), \\ -1, & \text{if } l(y) > L^{\text{max}}(x), \\ -\frac{l(y) - L^{\text{start}}(x)}{L^{\text{max}}(x) - L^{\text{start}}(x)}, & \text{if } L^{\text{start}}(x) < l(y) \le L^{\text{max}}(x). \end{cases}$$在边缘情况 $L^{\text{start}}(x) = L^{\text{max}}(x)$ 时,设 $r^{\text{len}}(x,y)=0$,即对这些推理路径无长度惩罚。

最终塑造奖励 $\tilde{r}(x,y)$ 是验证奖励和此门控长度惩罚的组合:

$$\tilde{r}(x,y) = r^{\text{cor}}(x,y) + I\{\hat{p}(x) = 1.0\} \cdot r^{\text{len}}(x,y).$$其中 $I\{\cdot\}$ 是指示函数。此设计确保:

- 有错误推理路径的问题($r^{\text{cor}}=0$)永不接受长度惩罚,保留正确性优先级

- 避免可能导致突然分布偏移和优化不稳定的硬截断限制

为平衡"学会解决"和"学会压缩"目标,数据加载器实现动态采样器。每步,根据当前掌握状态将样本分为两组:可压缩($\hat{p}(x) = 1.0$)和不可压缩。每个训练批次构建为从可压缩集抽取目标混合比例 $\rho \in (0, 1)$ 的样本,其余从不可压缩集抽取。这保持优化压力聚焦于缩短已掌握案例,同时保留未解决问题上的能力学习容量,避免灾难性遗忘。

使用 GRPO 算法家族(包括 GRPO、DAPO、Dr. GRPO 及 MoE 模型修改)的策略梯度方法优化模型,这些方法对本文设置鲁棒。此外,在压缩阶段应用早停:监控验证准确性和平均响应长度,在"预崩溃"最优点停止——准确性首次显示持续下降而长度仍在下降的点。这可靠避免过度压缩区域。

此方法形成简单稳定的后训练配方:首先,仅用二元验证奖励训练准确性(准确性阶段);其次,启用掌握门和软惩罚压缩(压缩阶段),在预崩溃最优点早停;最后,从压缩检查点恢复新准确性阶段以恢复任何微小准确性下降并进一步提升新更高效推理分布上的性能。整个准确性→压缩循环可运行一次作为标准后训练流程或重复。

4 Experiments

4.1 Experimental Setup

实验基于 MiMo-7B-RL,一个具有强数学推理能力但相对长 CoT 的 7B 密集思维模型。训练时,设置其上下文长度为 64K token 以容纳长形式数学推理。使用 113K 有真实答案的数学问题进行 RLVR 训练,来源为各种公开数据集。

训练算法为 DAPO,一种 GRPO 家族策略梯度方法,裁剪参数 $\text{clip\_low}=0.2$ 和 $\text{clip\_high}=0.27$。实现动态采样和混合策略:每个批次构建为 90% 样本用于标准能力训练(追求正确性),剩余 10% 样本从模型已掌握($\text{passrate}=1.0$)的样本中抽取,用于通过样本级软惩罚进行压缩训练。与 DAPO 不同,构建训练集时不过滤通过率 0 或 1 的样本。批次大小为 256,推理路径数 $n=8$。使用 AdamW 优化器。学习率为 $3\times 10^{-6}$,有 10 步预热。训练温度为 1.0,验证温度为 0.6,两者 top-$p$ 均设为 1.0。

比较三种基线:

- DAPO-lite:全局软惩罚,对训练集前 20% 最长推理路径应用 DAPO 惩罚($L_{\text{start}}=26000$)

- DAPO-heavy:更激进的全局惩罚,对前 40% 最长推理路径($L_{\text{start}}=18000$)

- 样本级硬截断:掌握后截断响应至目标长度而非应用软惩罚的基线

在 AIME24 和 AIME25 基准测试上评估性能,报告正确性和平均响应长度,所有指标通过每测试案例 32 样本计算并平均(avg@32)。

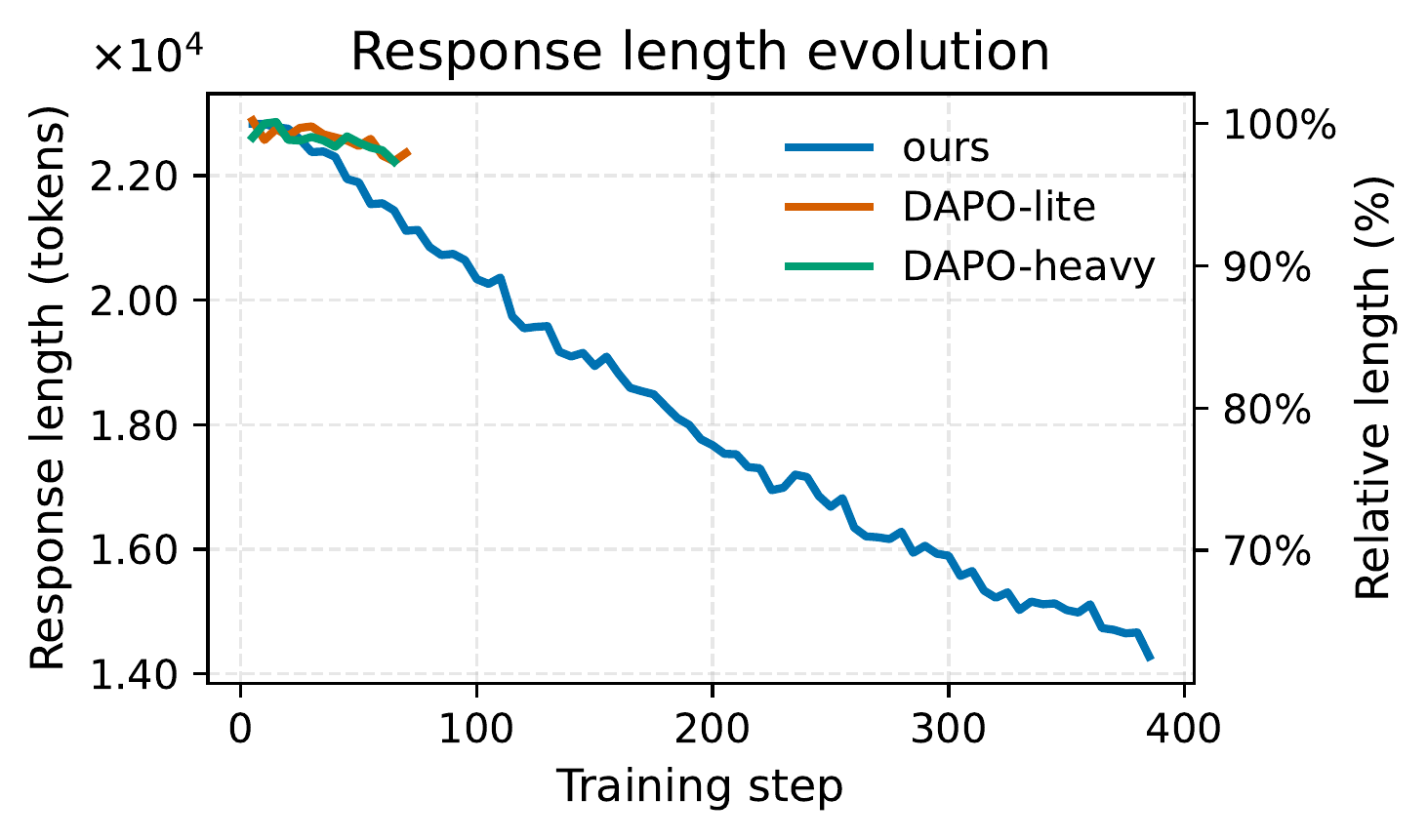

图 2(左):训练过程中响应长度(token 数)的动态变化。左轴显示绝对值(科学记数法),右轴显示相对于本文方法初始长度的百分比。

:::

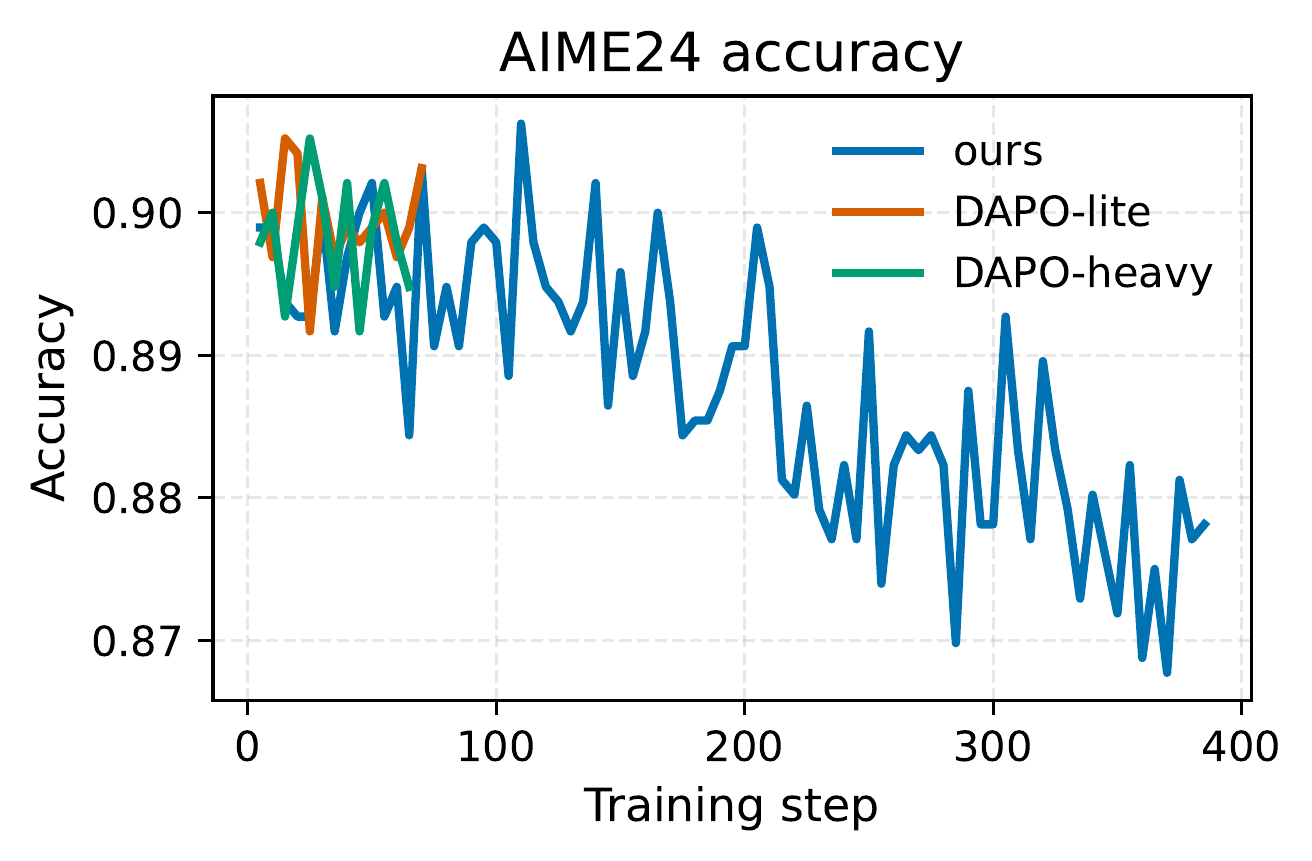

图 2(中):训练过程中 AIME24 验证准确性。本文方法保持性能,而全局惩罚压缩更慢且提供更弱的准确性-效率权衡。

:::

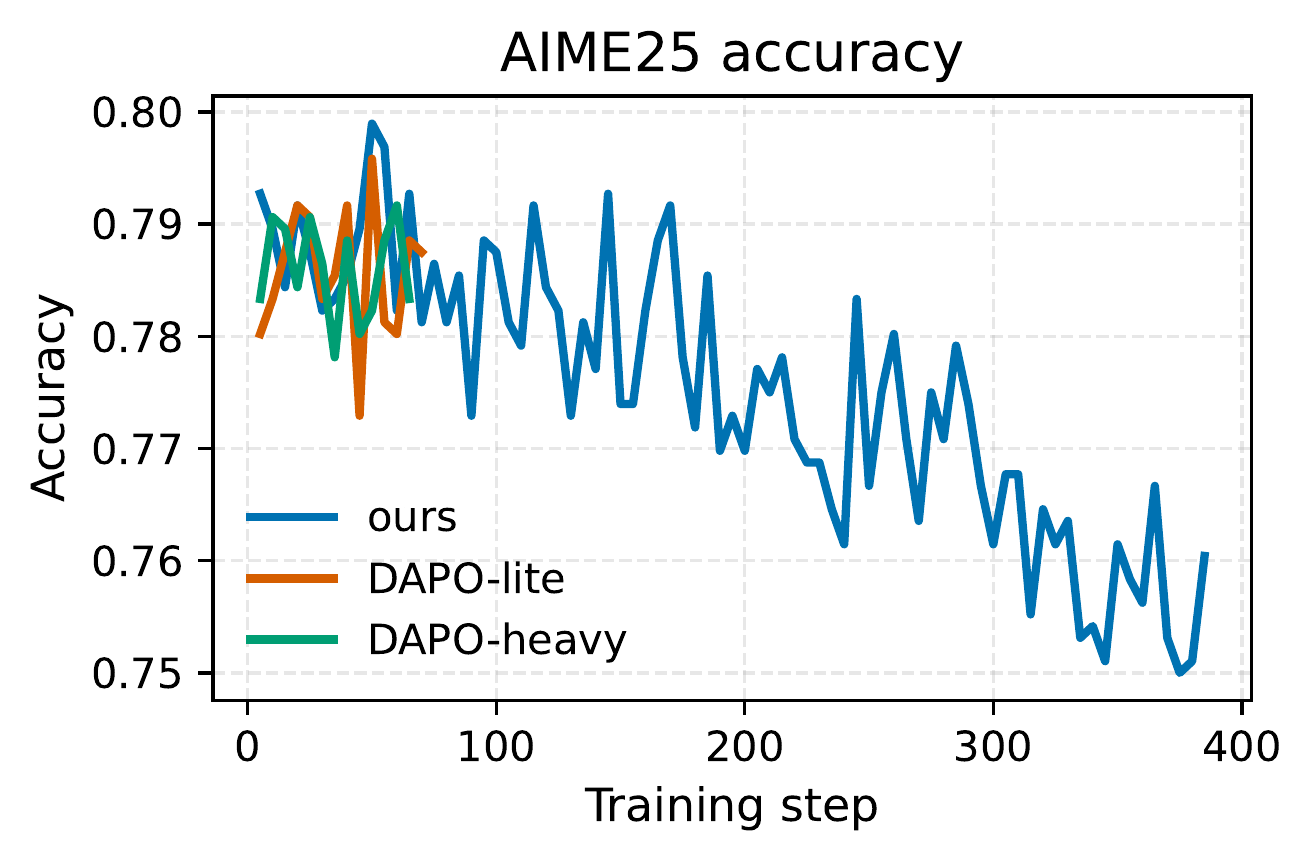

图 2(右):训练过程中 AIME25 验证准确性。本文方法保持性能,而全局惩罚压缩更慢且提供更弱的准确性-效率权衡。

:::

4.2 Main Results

首先,本文方法显著优于全局软惩罚。样本级方法实现快速稳定的长度减少而无立即性能下降。相反,全局软惩罚(DAPO-lite 和 DAPO-heavy)以更慢速率减少长度,展示了"一刀切"策略的低效。

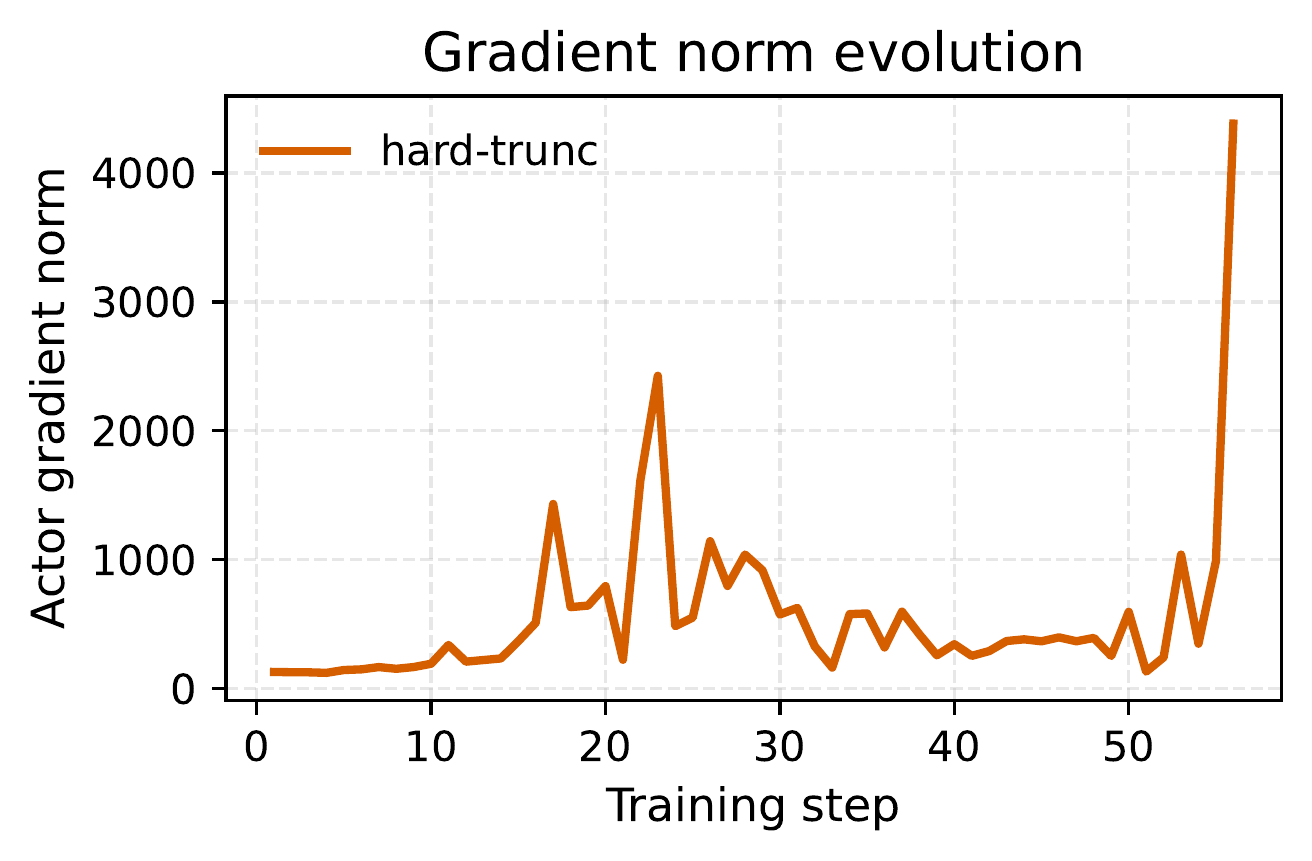

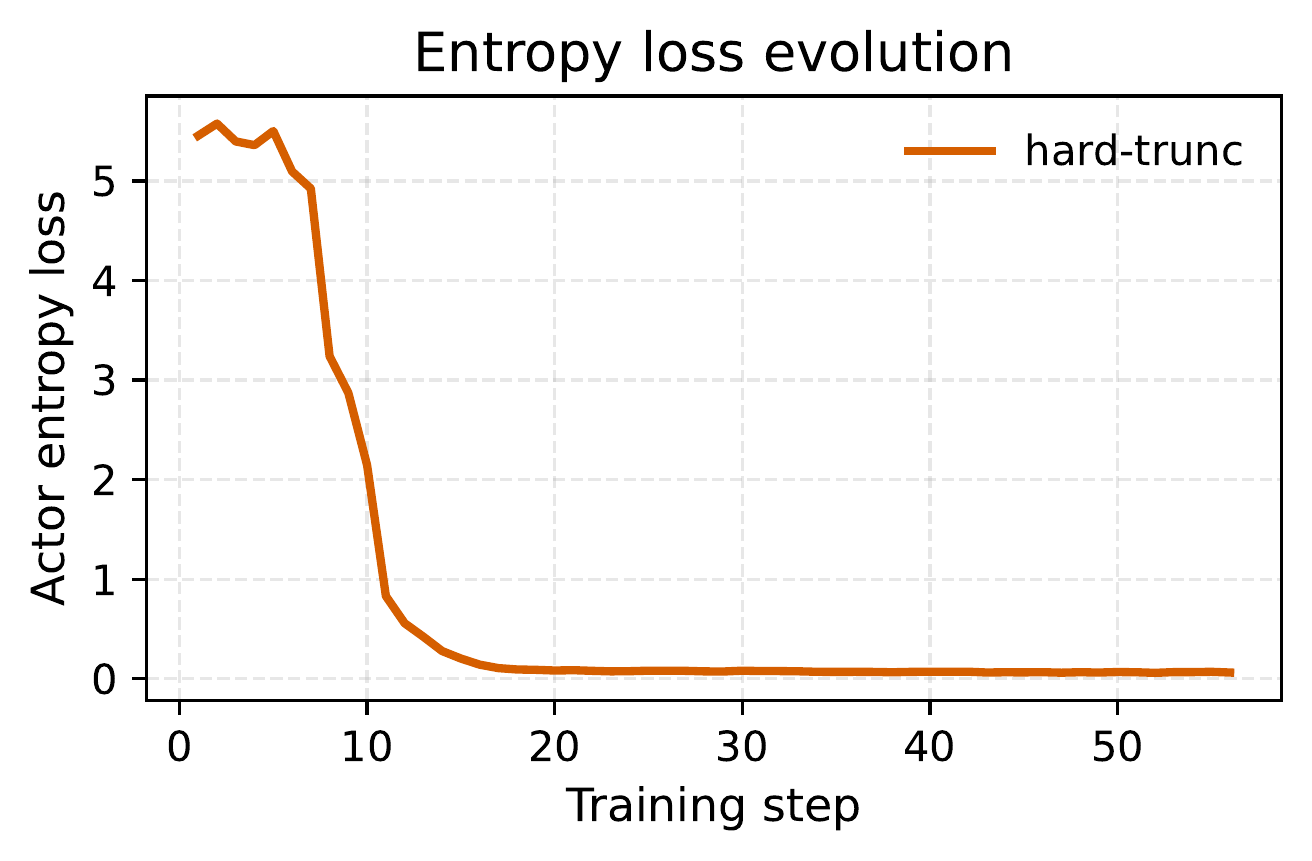

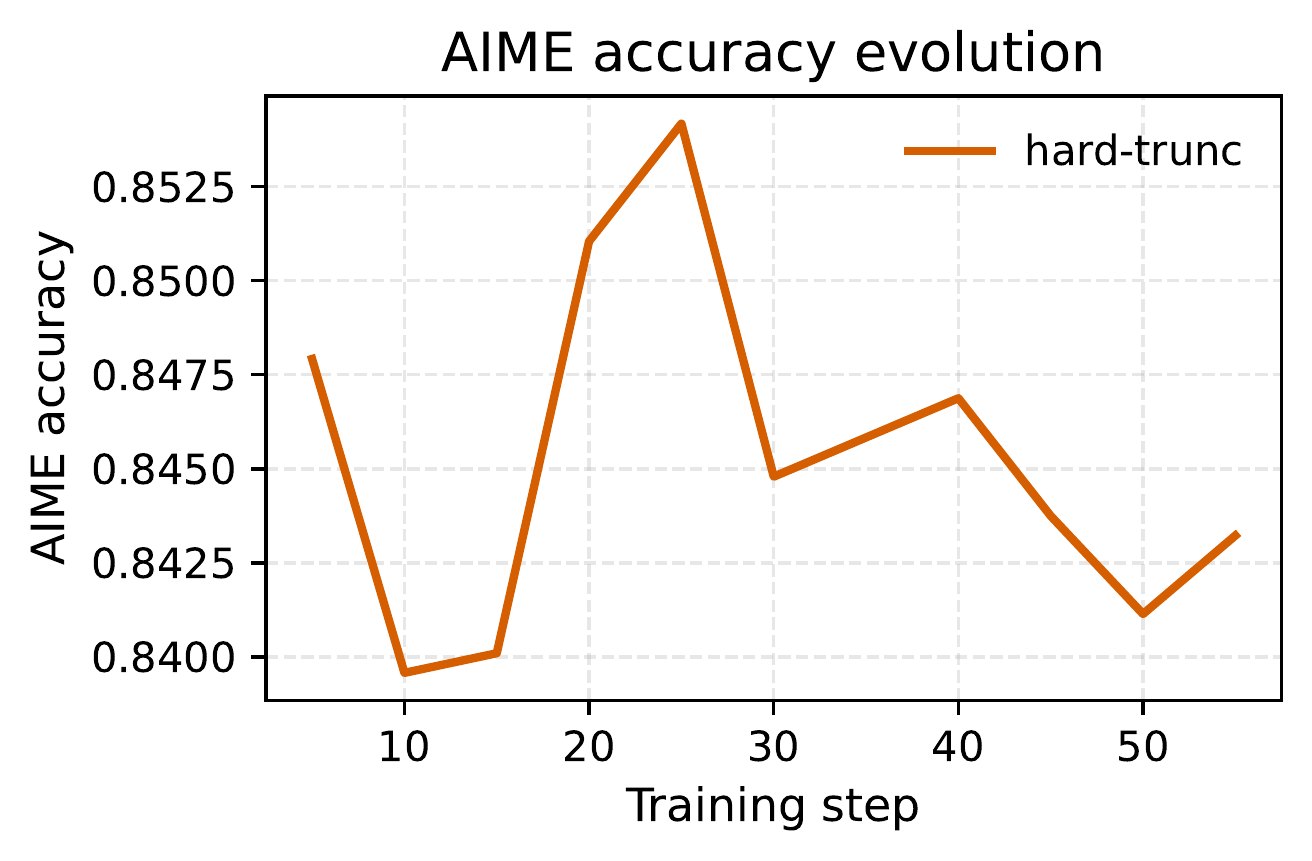

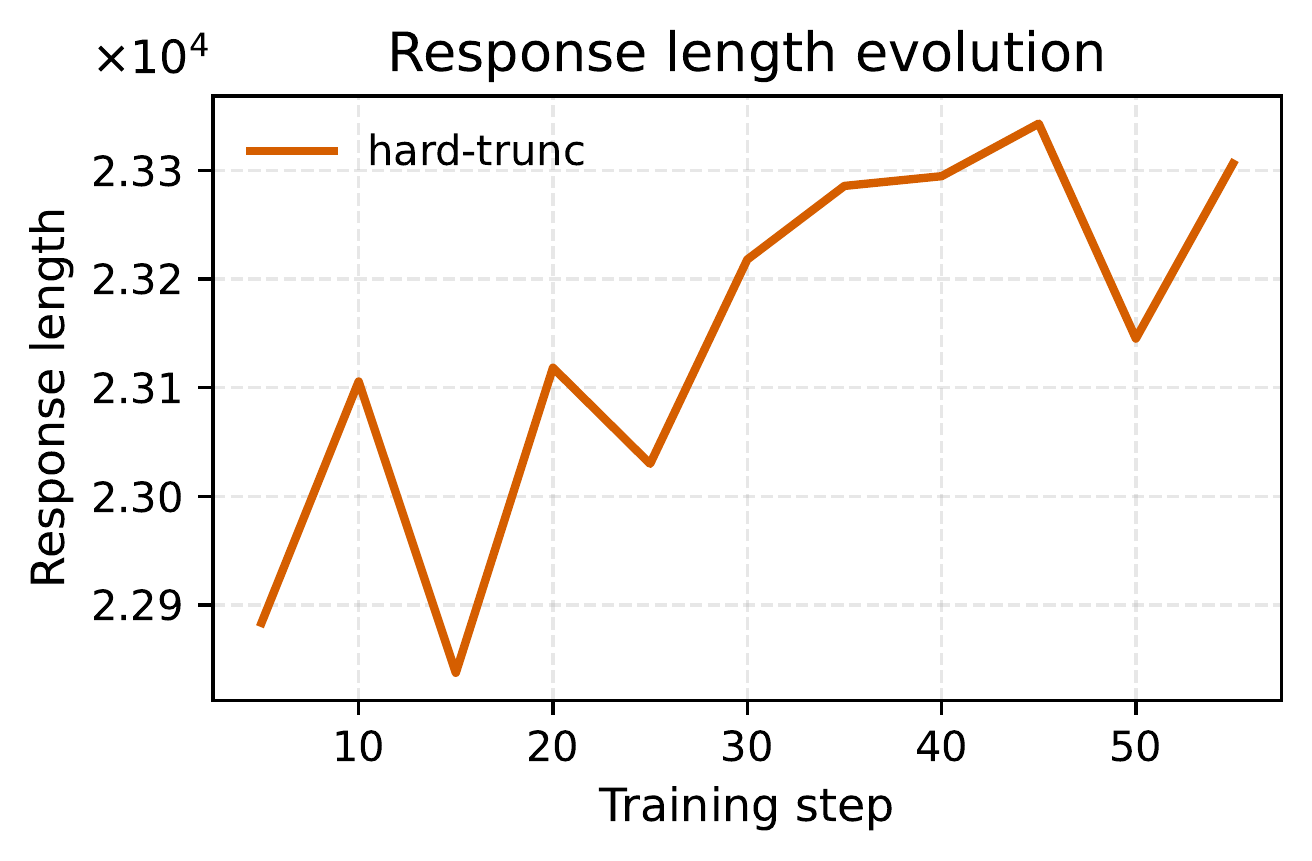

其次,硬截断基线灾难性失败。强制模型截断响应,即使在已掌握样本上,导致梯度爆炸、熵损失崩溃,从而训练过程极不稳定。甚至平均产生更长响应,并识别出许多输出末尾或中间的无意义重复模式。这为本文方法的设计原则提供强有力证据:压缩必须为软的(惩罚而非截断)。

图 3(左上):样本级硬截断基线的训练动态——演员梯度范数。截断导致梯度爆炸,表明优化极不稳定。

:::

图 3(右上):样本级硬截断基线的训练动态——熵损失。截断导致熵崩溃,表明高度不稳定的优化。

:::

图 3(左下):样本级硬截断基线的训练动态——AIME 准确性(AIME24 和 AIME25 平均)。硬截断快速破坏性能而无法提供可控的长度-准确性权衡。

:::

图 3(右下):样本级硬截断基线的训练动态——验证响应长度(token 数)。硬截断导致不稳定且甚至产生更长响应。

:::

第三,观察到单压缩阶段的准确性-效率权衡:

| Step | 170 | 260 | 330 | 385 |

|---|---|---|---|---|

| 平均长度减少 | 18.8% | 28.4% | 34.2% | 37.5% |

| 准确性下降(点) | 0.3 | 1.5 | 2.5 | 2.7 |

表 1:本文方法单压缩阶段的准确性-效率权衡。报告代表性停止点的平均响应长度相对减少和相应的准确性下降(点)。

5 Detailed Analysis

本节进行详细分析,调查训练动态、泛化能力和失败模式。执行几个关键实验验证方法:

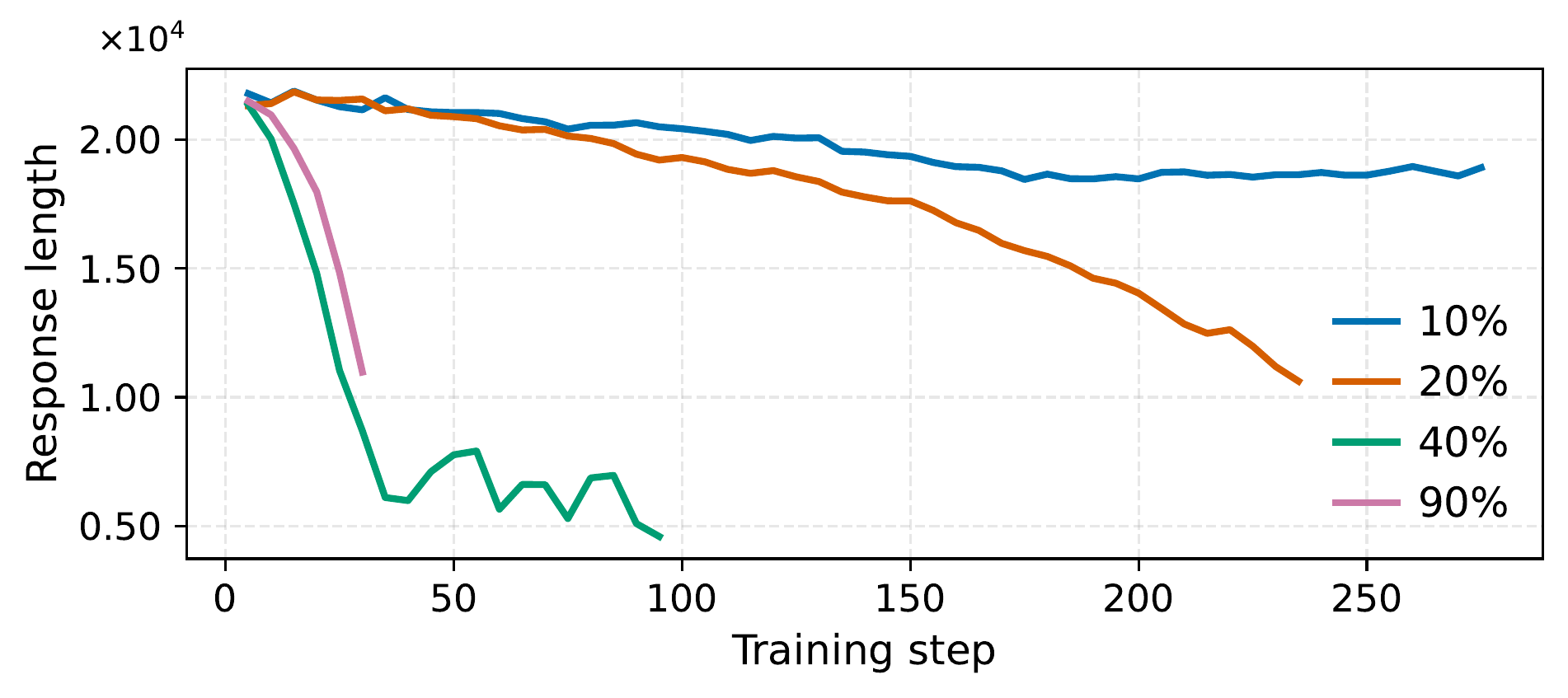

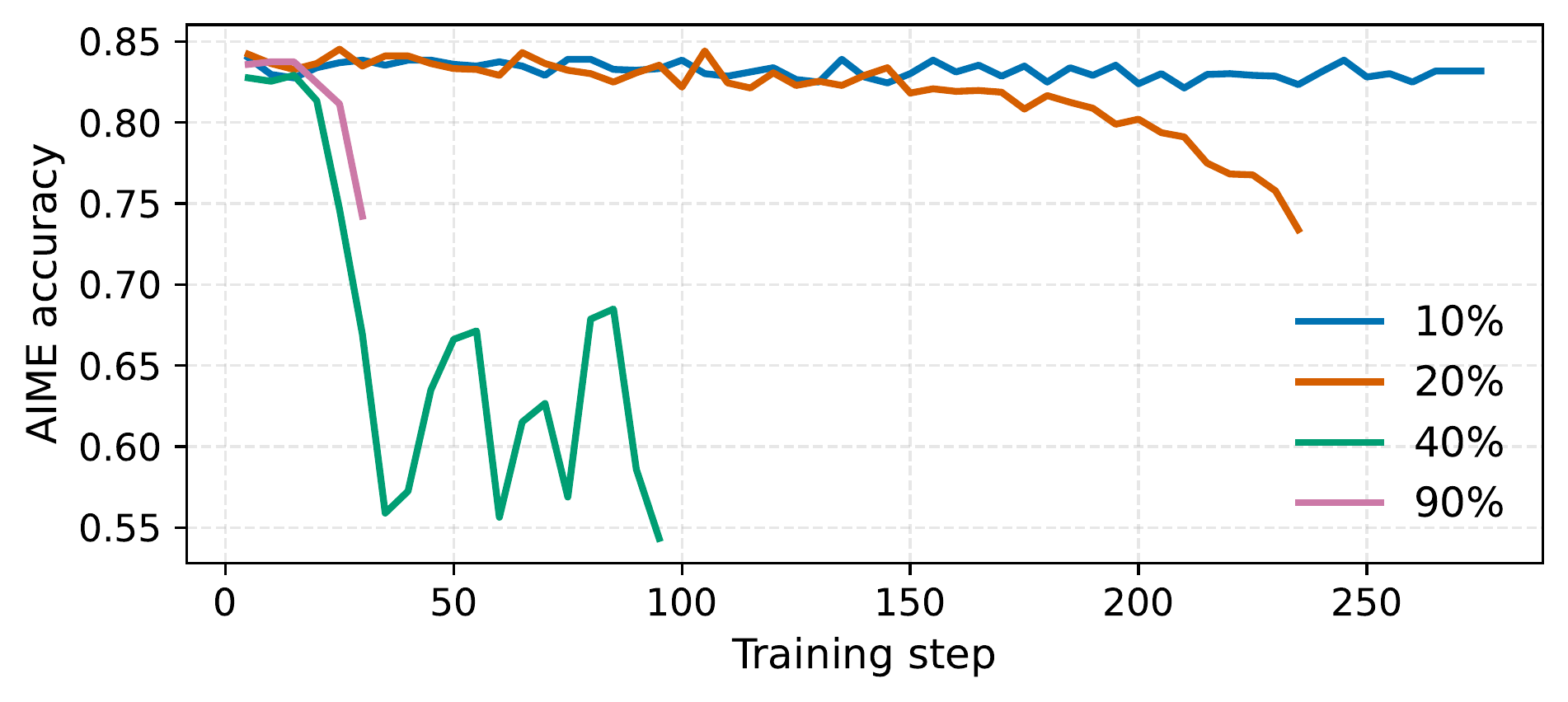

- 使用 MiMo-7B-SFT 模型,用 Dr.GPRO 应用压缩训练,在压缩阶段混合不同比例(10%、20%、40%、90%)的已掌握样本($\hat{p}(x)=1.0$)和剩余样本 $\hat{p}(x)\in(0.0,1.0)$

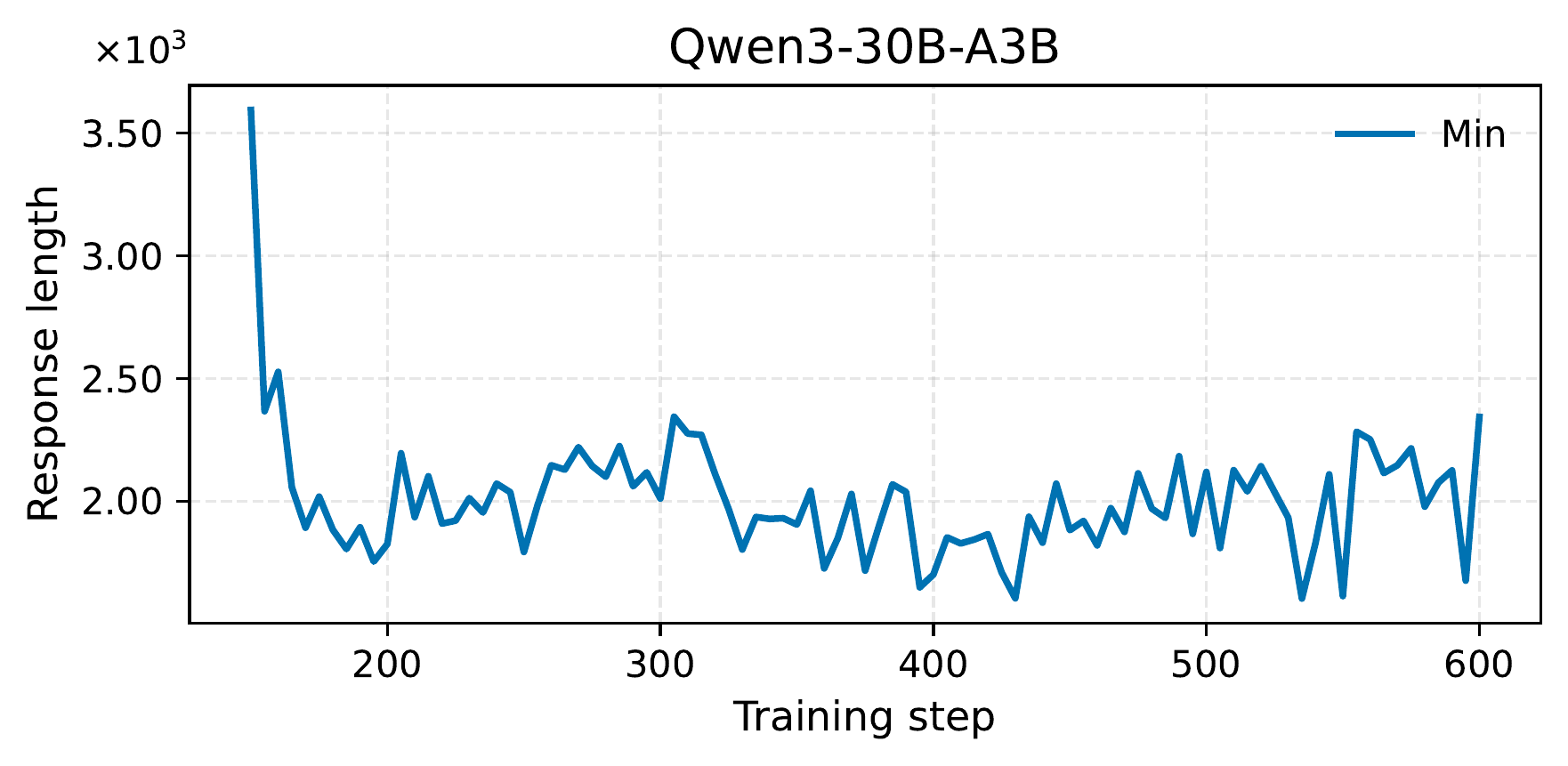

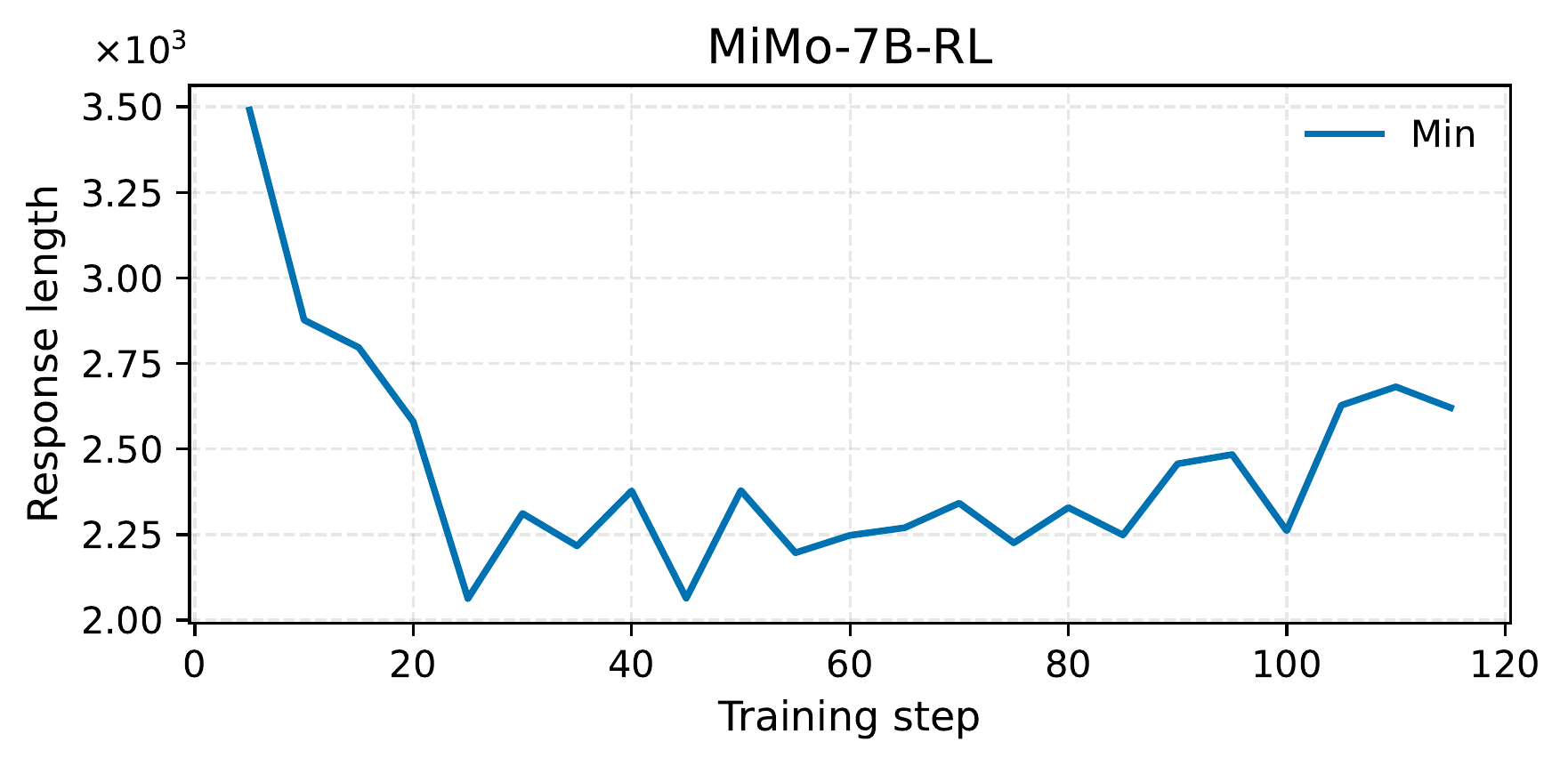

- 为评估架构泛化,实验 Qwen3-30B-A3B,一个专家混合(MoE)模型。先对开源 CoT 数据监督微调注入推理模式,然后用带推理路径路由回放机制的 Dr.GRPO 训练 150 步准确性聚焦阶段。然后进行两完整循环的准确性→压缩课程,同样使用 40% 压缩混合

- 在 MiMo-7B-RL 模型上用 Dr.GPRO 训练单准确性→压缩循环,压缩阶段使用 40% 混合

5.1 训练循环动态

首先分析提出的准确性→压缩→准确性训练循环动态,展示课程可同时减少长度和提高准确性,超越连续 RLVR 训练的性能上限。此循环结构即使重复也证明稳定。

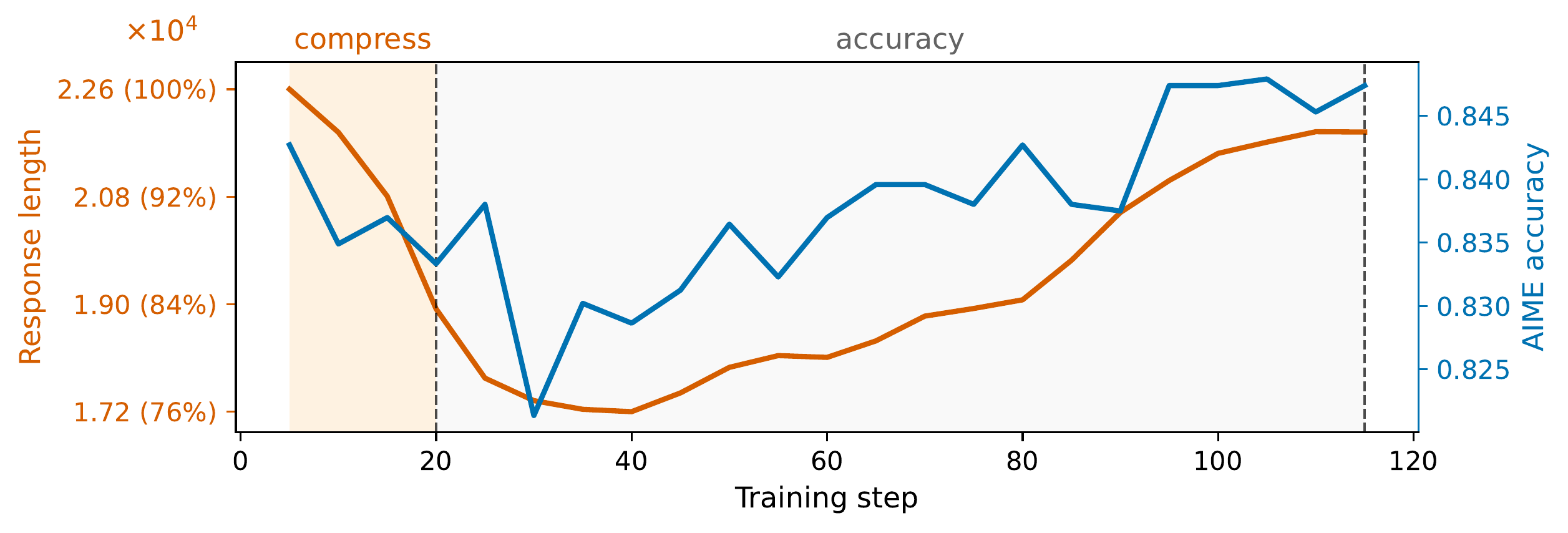

图 4:Qwen3-30B-A3B 上两轮准确性→压缩→准确性循环的长度-准确性动态。橙色曲线和左轴显示验证响应长度(token 数,科学记数法形式,相对于初始长度的百分比),蓝色曲线和右轴显示平均 AIME 准确性(AIME24 和 AIME25 平均)。第一循环(150 准确性步、15 压缩步、145 准确性步)实现大长度减少且几乎无准确性损失,第二循环(10 压缩步、280 准确性步)进一步提升准确性同时保持净长度减少。

:::

图 5:MiMo-7B-RL 上单准确性→压缩→准确性循环的长度-准确性动态。橙色曲线和左轴显示验证响应长度(token 数,科学记数法单位和相对百分比),蓝色曲线和右轴显示平均 AIME 准确性(AIME24 和 AIME25 平均)。约 20 压缩步产生大长度减少且准确性稳定后,约 90 后续准确性步恢复并略微提高准确性,而长度稳定在相对于原始的适度减少。

:::

对于 Qwen3-30B-A3B 模型,初始 150 步准确性阶段后接 15 步压缩,将平均响应长度减少 21% 且准确性下降微不足道(少于 1 点)。后续 145 步准确性阶段不仅恢复准确性,还稳定在 10% 净长度减少。第二循环(10 压缩步、280 准确性步)达到最高准确性——从开始增加超过 1 点——同时保持相对于原始的 3% 最终长度减少。类似地,MiMo-7B-RL 模型在 20 压缩步(16% 长度减少,稳定准确性)和 90 步准确性训练后,获得约 1 点准确性并稳定在其原始长度的 97%。

跨模型的关键观察是优化器效应。从压缩切换回准确性后,模型短暂继续缩短响应并可能看到暂时准确性下降,然后优化目标稳定。例如,MiMo-7B 模型需要压缩后 15 步准确性开始恢复,25 步后长度开始增加。

5.2 跨领域泛化

重要发现是压缩技能的强跨领域泛化。虽然压缩训练仅在数学问题上进行,模型自发减少各种未见任务的响应长度,通常无性能损失。某些情况下,准确性提高,归因于缓解过度长度截断的分数惩罚。

评估主实验中在 AIME 上因压缩下降 3 点准确性的检查点。其跨领域行为汇总:

| Benchmark | Category | Accuracy change (points) | Length change (%) |

|---|---|---|---|

| AIME25 | Math | -1.7 | -31.7 |

| MATH500 | Math | -0.8 | -41.6 |

| GPQA Diamond | QA | -0.4 | -34.8 |

| MMLU_Redux | General Knowledge | +1.1 | -33.4 |

| IFEval | Instruction Following | +0.9 | -22.8 |

| LiveCodeBench v6 | Code | +3.7 | -31.8 |

| ZebraLogic | Logic | -1.3 | -22.1 |

表 2:压缩在 AIME 准确性下降 3 点检查点的跨领域效应汇总。报告每个基准测试的类别、核心指标变化(百分比点或原始分数点)和平均响应长度相对变化。

两个现象突出:

- 在数学基准测试上,MATH500 比 AIME25 容易得多,看到更强长度减少(-41.6% vs -31.7%)且准确性相似,显示样本级策略自然更激进压缩更简单数据

- 在 LiveCodeBench v6 上,准确性仍上升约 3.7 点尽管约 32% 长度减少,因为约 18% 之前过长截断的代码生成现在落在预算内并获得完全信用

5.3 压缩跨算法和架构的鲁棒性

各种实验确认压缩方法行为的鲁棒性。观测动态——长度压缩后性能恢复——在不同 GRPO 家族算法(包括 Dr.GPRO、DAPO 和推理路径路由回放+Dr.GPRO)和多样模型架构及大小(包括 MiMo-7B 密集模型和 Qwen3-30B-A3B MoE 模型)保持一致。

5.4 过度压缩的失败模式

还表征过度压缩的失败模式,建立早停必要性。所有实验中,无论模型或数据混合,持续压缩训练不可避免导致性能崩溃。观察到更高压缩数据混合比例加速此崩溃。崩溃状态特征非重复或无意义输出;相反,模型学会立即输出错误最终答案,无前置推理。

图 6(左):MiMo-7B-SFT 在不同压缩混合比例(10%、20%、40%、90%)下的过度压缩动态——验证响应长度(token 数,科学记数法 y 轴)。压缩训练持续时稳定下降,更高混合更激进压缩。

:::

图 6(右):MiMo-7B-SFT 在不同压缩混合比例下的过度压缩动态——AIME 准确性。初始稳定或略微提高但最终所有混合崩溃,更大混合更早失败,展示过度压缩失败模式的普遍但混合依赖性质。

:::

分析此现象为一种优势黑客。GRPO 风格算法从在策略推理路径计算优势基线,应用压缩奖励时不固有区分 $\hat{p}(x)=0$ 和 $\hat{p}(x)=1.0$ 样本。模型发现简单黑客:故意失败问题($\hat{p}(x)=0$)同时最小化长度产生比正确解决($\hat{p}(x)=1.0$)并承受长度惩罚更好的奖励。因为压缩技能泛化如此强,此黑客行为一旦学会快速传播。标准 GRPO 机制恶化此问题,因为 $\hat{p}(x)=0$ 样本不贡献正梯度信号,对此失败模式无惩罚。

5.5 案例研究

最后,进行模型输出的案例研究揭示训练循环的定性影响。

首先,模型学会区分必要和不必要冗长。训练循环各检查点间,最短响应长度(容易解决的问题上)在压缩期间快速下降并在后续准确性阶段保持低,表明模型内化新的更高效"必要路径"。相反,最长响应长度(通常在未解决问题上)保持长并总被截断,表明模型面对困难仍进行扩展推理。

图 7(左):Qwen3-30B-A3B 准确性→压缩→准确性循环上的最小验证响应长度(token 数,科学记数法 y 轴)。最小长度在容易问题上在压缩期间急剧下降并在之后保持低。

:::

图 7(右):MiMo-7B-RL 准确性→压缩→准确性循环上的最小验证响应长度。最小长度在容易问题上在压缩期间急剧下降并在之后保持低,而最大长度在困难问题上(未显示)保持接近截断限制。

:::

其次,语言风格也转变:压缩阶段引发"电报"风格,完整句子被压缩(如"cosine even, sine odd")且数学公式与自然语言片段流畅混合(如"So $r_2^{13} = \dots$ = same as before $\dots$")。此压缩风格在后续准确性阶段主要恢复为更人性化语言。在 Qwen3-30B-A3B 模型上跨两完整循环观察到此模式。

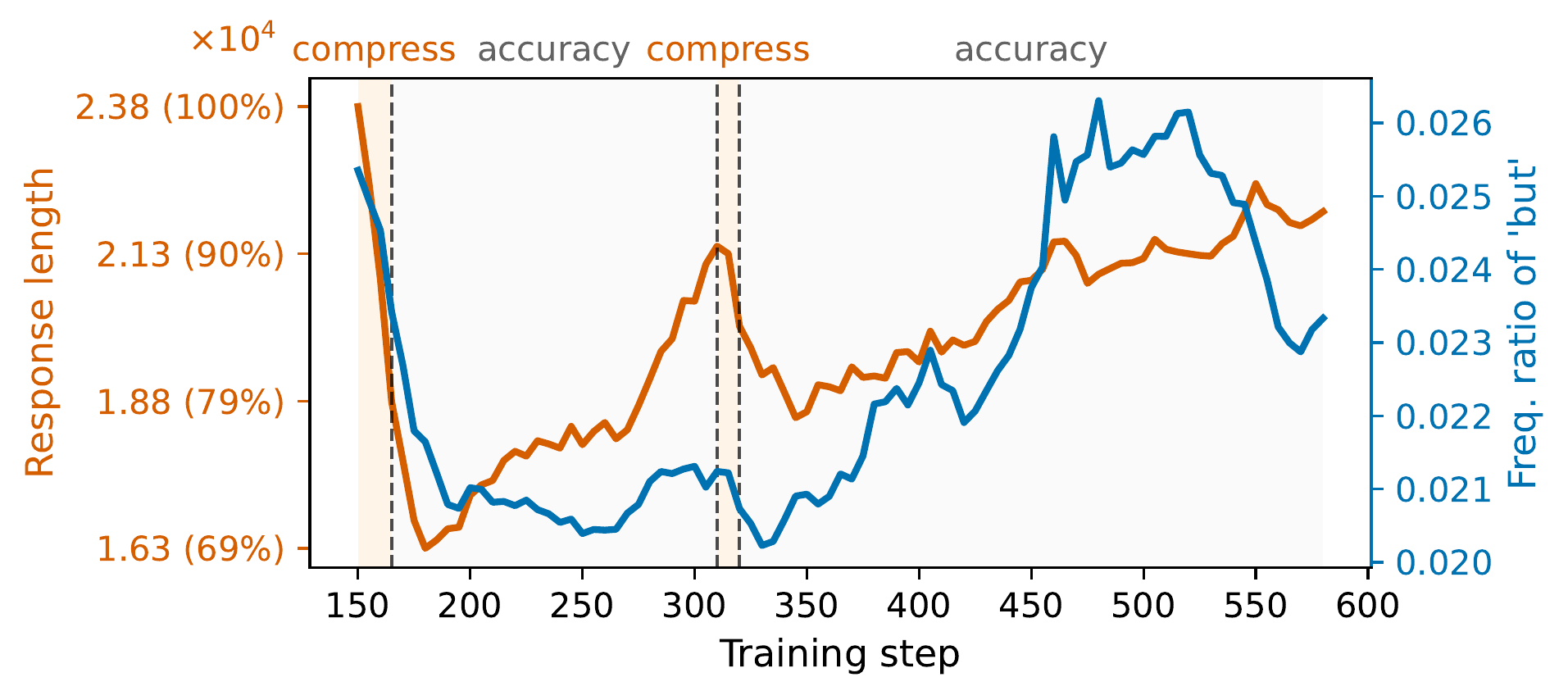

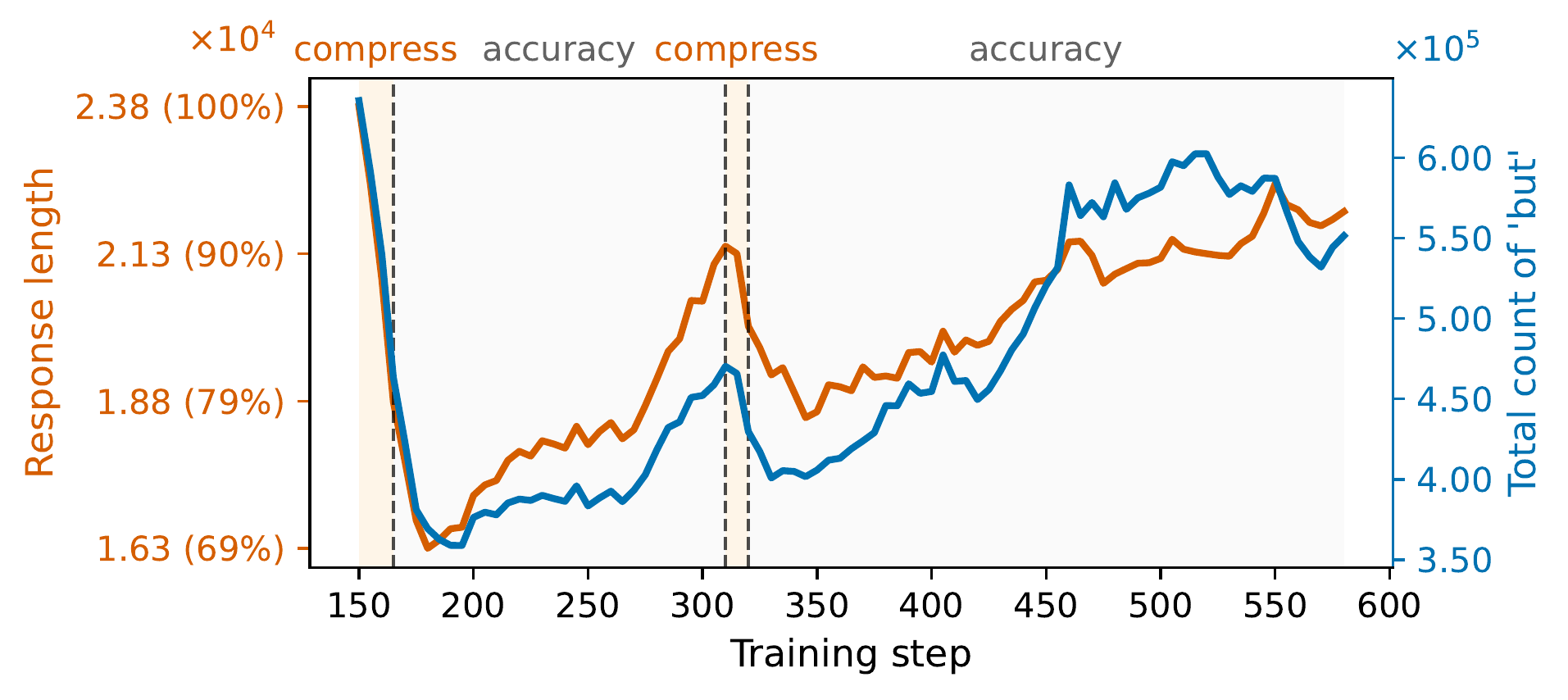

最后,推理模式也演变。过渡词(如"but"、"however")频率在压缩期间显著下降并在准确性期间再次上升,镜像整体长度轨迹。

图 8(左):Qwen3-30B-A3B 准确性→压缩→准确性循环上的响应长度和"but"使用。相对响应长度(token,左轴)和"but"在生成 token 中的频率比(右轴)。

:::

图 8(右):Qwen3-30B-A3B 循环上的响应长度和"but"使用。相对响应长度和"but"总数,显示压缩压缩链式思维时过渡标记变得不频繁然后在准确性恢复阶段反弹,紧密跟踪长度轨迹。

:::

6 From CoT Compression to Agent Compression

本文方法动机为压缩链式思维(CoT)而不牺牲正确性。此框架非特定于单次 CoT。本节展示相同配方直接扩展到智能体设置,其中模型必须交错推理与工具使用(如编辑-测试循环),且压缩在非智能体和智能体模型间展现强双向泛化。

6.1 Setup

使用 MiMo-V2-Flash 作为基础模型(309B 总参数,15B 活跃参数),运行两压缩实验:

- 非智能体压缩:在非智能体数学、代码和逻辑任务上训练压缩阶段 80 步

- 智能体压缩:从通过 SFT 和 RLVR 优化的思维模式代码智能体模型开始,在思维代码智能体任务上训练压缩阶段 100 步且启用工具使用

两种情况下,应用相同掌握门控 RL 目标,惩罚响应长度(非工具调用或轮次)。在三个非智能体基准测试(AIME25、LiveCodeBench-v6、GPQA-Diamond)和一个智能体基准测试(SWE-Bench Verified)上评估。

6.2 Results

观察到非智能体和智能体压缩间的强双向泛化。

非智能体到智能体(轮次减少无需智能体训练): 在 SWE-Bench Verified 非思维模式评估,即使仅在非智能体任务上训练的压缩也引发更简洁智能体行为:非思维 SWE 智能体平均轮次从 110 减至 96($\Delta R=-13\%$)且仅小准确性变化(73.4 → 72.3)。表明学习到的压缩行为非限于单次 CoT 格式化,但可改变智能体交互策略。

智能体压缩(更短轨迹和跨领域迁移): 直接压缩思维模式智能体时,在 SWE-Bench Verified 上获得轨迹长度和轮次的大减少:长度从 105k 减至 34.2k token($\Delta L=-67\%$),轮次从 96 减至 46($\Delta R=-52\%$),且准确性适度下降(72.1 → 70.3)。除 SWE 外,同一压缩智能体还在多样非智能体基准测试上产生更短响应,表明学习到的计算压缩行为强迁移:

| Benchmark | base | step-100 |

|---|---|---|

| AIME25 | 86.5/29.3k | 85.3/21.9k ($\Delta L=-25\%$) |

| LiveCodeBench-AA | 76.2/23.3k | 76.0/17.7k ($\Delta L=-24\%$) |

| GPQA-Diamond | 83.3/24.9k | 84.5/14.0k ($\Delta L=-44\%$) |

| SWE-Bench Verified | 72.1/105.0k/96 | 70.3/34.2k/46 ($\Delta L=-67\%$, $\Delta R=-52\%$) |

表 3:智能体压缩。非智能体基准测试的准确性/响应长度和 SWE-Bench Verified 思维模式的准确性/响应长度/轮次。相对变化($\Delta L$、$\Delta R$)相对于基础检查点计算。

最后回到开头声称:智能表现为压缩。博尔赫斯在《博闻强记的富内斯》中写道:"思考即遗忘差异,即概括,即抽象。"在掌握门控目标中,模型首先学会在需要的地方花费计算,然后遗忘不重要的:不仅压缩已掌握问题的链式思维,但压缩整个推理过程——token、轮次和工具使用轨迹——为更锐利的行动策略。在此观点下,压缩非表面的解释缩短;它是学习到的注意力和努力分配。泛化是同一行为,跨任务提升:保留不变量,丢弃偶然,遗忘正确的差异。

四、论文简评

创新点

- 掌握门控机制:提出仅在模型掌握样本($\hat{p}(x)=1.0$)后才激活压缩的机制,有效避免奖励黑客问题,确保压缩不影响未掌握问题的学习

- 样本级动态策略:区别于全局静态截断,使用样本特定的安全长度和惩罚上限,自适应不同难度样本的压缩强度

- 软惩罚而非硬截断:采用分段线性软惩罚而非强制截断,避免梯度爆炸和熵崩溃,保证优化稳定性

- 跨领域泛化发现:仅在数学上训练压缩可自发迁移到代码、指令遵循、常识问答等未见领域,揭示压缩作为通用效率技能

- 双向智能体-非智能体迁移:证明压缩技能可双向迁移:非智能体训练减少智能体轮次,智能体压缩也缩短非智能体输出

局限性

- 过度压缩风险:持续压缩训练不可避免导致性能崩溃,需谨慎早停,但对早停点的精确检测仍依赖经验观察

- 优势黑客现象:GRPO 机制本身不区分正确和失败样本,模型可能学会故意失败以规避长度惩罚

- 领域依赖性:跨领域泛化效果在不同基准测试上有差异,某些领域(如 ZebraLogic)准确性仍有下降

- 计算成本:需维护在策略统计量(通过率、长度分布),增加训练开销

应用场景

- 推理模型后训练:作为标准后训练流程的压缩阶段,减少推理延迟和成本

- 智能体效率优化:减少工具使用智能体的轨迹长度和交互轮次,降低 API 调用成本

- 多任务部署:单一领域压缩训练后可部署到多任务场景,无需针对每个任务单独优化

- 边缘设备推理:减少输出长度便于在资源受限设备上运行大模型

可改进方向

- 早停机制自动化:开发更精确的早停检测算法,如基于梯度变化或分布偏移的自动监测

- 优势计算改进:修改 GRPO 机制显式区分正确和失败样本,消除优势黑客激励

- 自适应混合比例:动态调整压缩数据混合比例 $\rho$,而非固定值

- 多轮压缩优化:探索多次压缩-恢复循环的最优次数和停止条件

- 理论分析:建立压缩的理论框架,解释为何压缩技能跨领域泛化及何时崩溃

内容完整性检查

- 所有数学公式(行间 $$...$$ 和行内 $...$)

- 所有图片(引用原始文件路径)

- 所有图片放在对应章节末尾

- 所有表格(转换为 HTML 表格)

- 章节编号(1, 2, 3, 4, 5, 6)

- 英文摘要的中文翻译(放在开头)

- 论文简评(放在结尾)

- 删除所有引用格式(如 [AuthorYear])