LIFT: 通过长输入微调增强大语言模型长上下文理解能力的新框架

一、论文摘要

长上下文理解对大语言模型仍然具有挑战性,这主要由于其有限的上下文窗口限制。本文提出了 LIFT(Long Input Fine-Tuning,长输入微调),这是一种用于长上下文建模的新框架,可以通过动态调整模型参数来适应给定的长输入,从而增强任意短上下文大语言模型的长上下文性能。

重要的是,LIFT 不是通过不断扩展上下文窗口大小来容纳越来越长的输入(即 在上下文中存储),而是将长输入存储并吸收 在参数中。通过对长输入进行微调,将其融入模型参数,LIFT 使得短上下文大语言模型能够在推理过程中即使没有提供所需信息的上下文也能回答问题,避免了常规长上下文模型相对于输入长度的二次计算复杂度。

此外,LIFT 并非简单地在新长上下文上进行持续预训练,而是利用精心设计的大语言模型生成的合成任务来增强对长上下文的理解,超越了单纯的记忆化。为了应对微调的额外成本,我们设计了一个高度优化的流水线,将 8k 上下文的首 token 时间(TTFT)减少到不到 10 秒。

我们进一步对 LIFT 在长上下文理解中的优势和局限性进行了全面分析,讨论了其大规模实际部署的可行性,并强调了未来研究的重要方向。实现代码已开源。

二、基本信息

**论文 ID**: 2502.14644

**标题**: LIFT: A Novel Framework for Enhancing Long-Context Understanding of LLMs via Long Input Fine-Tuning

**作者**: Yansheng Mao*, Yufei Xu*, Jiaqi Li, Fanxu Meng, Haotong Yang, Zilong Zheng, Xiyuan Wang, Muhan Zhang

**单位**:

- Institute for Artificial Intelligence, Peking University

- State Key Laboratory of General Artificial Intelligence, BIGAI

**会议/期刊**: ICML 2026

**原文保存位置**: ~/.openclaw/workspace/papers/20260403_LIFT/source/

**报告生成日期**: 2026-04-03

三、论文主体分析

1 引言

大语言模型的最新进展,如 Gemini 3 和 DeepSeek-R1,重塑了自然语言处理领域,在文本生成、翻译、摘要等任务上实现了最先进的性能,同时显著提升了在挑战性推理任务上的表现。然而,尽管取得了这些进展,长上下文推理仍然是大语言模型的基本挑战。长序列可以长达数百万个 token,在实际应用中十分常见,包括长篇书籍、会计文档、工具使用、高分辨率视频和音频信号等。

受位置嵌入的限制,大语言模型往往难以泛化到训练时未见过的序列长度,导致其可处理的输入长度存在上限,即所谓的 上下文窗口大小。扩展上下文窗口允许大语言模型在更大的文本跨度上捕获依赖关系,并提高需要跨长输入推理的任务的连贯性、理解能力和准确性。然而,随着上下文长度增加,自注意力机制的 计算复杂度呈二次增长,这对现代大语言模型处理真正长的输入带来了巨大挑战。例如,存储大量中间状态(如 KV cache)对硬件资源造成了沉重负担。此外,在整个长输入中分散的信息片段之间捕获长依赖关系并进行进一步理解和推理也是具有挑战性的。由于上下文窗口的限制,大语言模型几乎无法捕获用户查询历史或任务输入的整体信息,导致性能不佳。

为了解决这些挑战,研究人员开发了各种技术来改进大语言模型的长上下文能力:

长上下文后训练:主要范式是在大量长格式语料库上微调预训练的大语言模型。虽然这种方法有效地扩展了上下文窗口,但无法缓解在长上下文上计算注意力的基本二次复杂度。因此,在训练和推理阶段都会产生高昂的计算和内存开销。此外,尽管进行了扩展,这些大语言模型的上下文窗口仍然是有限的,无法泛化到无限长度的输入。

检索增强生成(RAG)和提示压缩:通过预处理长输入来生成短上下文。然而,这些方法的有效性取决于在上下文窗口中提供的上下文信息的精确性和相关性。当提供嘈杂、模糊或冲突的信息时,会导致进一步的幻觉问题。

为了克服这些限制并实现对长输入的高效推理,本文提出了 LIFT(Long Input Fine-Tuning,长输入微调),这是一种新颖的框架,旨在通过直接调整模型参数以适应长输入来增强任意短上下文模型的长上下文能力。

$$ \text{LIFT 的核心思想:将长输入存储在参数中,而非在上下文中} $$

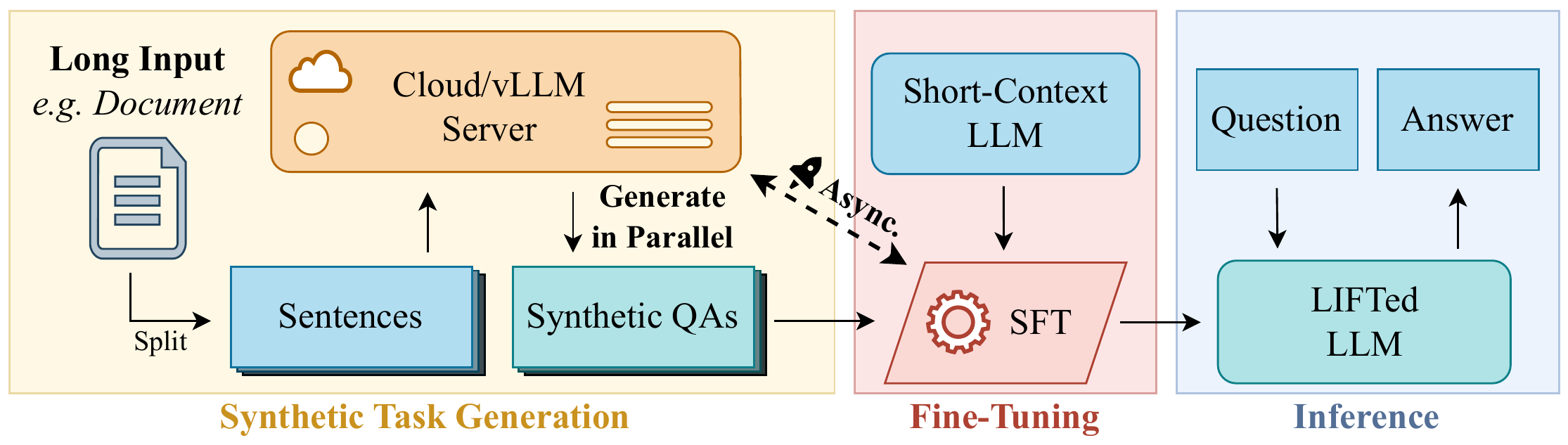

图 1:LIFT 流程概览。过程始于将长输入(如文档)分割成句子,然后发送到本地/远程大语言模型服务器并行生成合成任务。这些任务用于微调短上下文大语言模型,产生一个 LIFTed 大语言模型,可以在不直接访问原始输入的情况下回答问题。

:::

LIFT 的优势:

高效微调和解码:LIFT 通过调整参数将大语言模型动态适应新的长输入作为新知识。为了增强对长输入的理解,我们根据其句子生成合成问答,并使用数据并行化在问答批次上进行监督微调(SFT)以实现高效适应。与长上下文模型相比,LIFT 不需要在上下文窗口中存储长上下文,避免了相对于上下文长度的二次复杂度,保持了短上下文大语言模型的推理速度。

在流行的长上下文任务上的巨大改进:在公认的长上下文基准上的评估显示,LIFT 在多样的下游任务(如长/短依赖问答和摘要)上持续获益。例如,在 LooGLE 的挑战性长依赖问答任务上,"LIFTed" 的 Llama-3-8B-Instruct 模型实现了 27.25% 的准确率,显著优于其纯 ICL 对应模型的 15.44% 准确率。

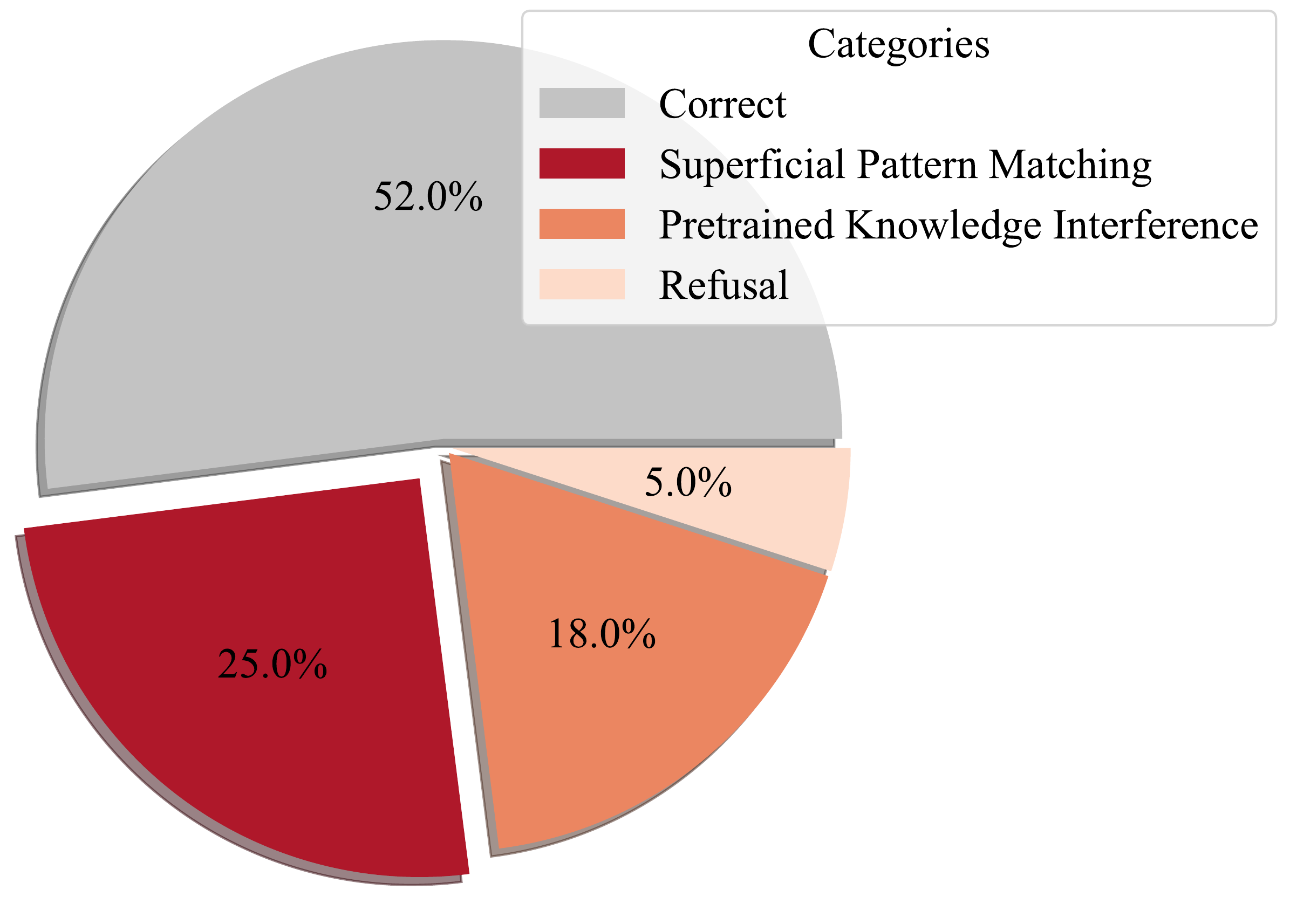

图 2:对 Finetune-Raw 在前 100 个 SQuAD 样本上失败模式的手动定性分析。

:::

2 相关工作

2.1 长上下文后训练和注意力变体

现有大语言模型主要依赖纯上下文学习(ICL)进行长上下文理解。然而,短上下文模型难以处理超过其上下文窗口大小的输入,因为预训练时未见过的位置嵌入,导致下游任务性能极差。因此,常见的做法是在大量长文本语料库上进一步后训练大语言模型。尽管有效,长上下文后训练通常需要巨大的计算成本。

为了解决这些问题,开发了许多工作来加速长上下文训练过程:

稀疏注意力:通过使用局部窗口或跨步注意力减少内存和计算成本,允许专注于给定任务的最相关输入。

线性注意力:通过核函数或低秩表示近似自注意力,将二次计算降低到线性。

然而,这些高效架构尚未被广泛采用,主要是因为与标准 Transformer 相比性能下降,以及与现有硬件加速器不兼容。因此,本文专注于当前大语言模型中最广泛使用的常规自注意力架构,以验证 LIFT 的有效性。

2.2 检索增强生成(RAG)

RAG 通过将大语言模型与外部数据源集成进行检索来改进长上下文理解性能,从而避免需要输入整个长输入。其性能严重依赖于检索内容的质量,这些内容必须足够相关和简洁以适应模型的短上下文窗口。当检索的上下文不准确或不匹配时,RAG 可能会出现显著的性能下降或幻觉问题。

2.3 记忆增强大语言模型

一系列工作探索为大语言模型增加记忆模块。与构建离线数据库并在推理期间从中检索的 RAG 相比,记忆增强大语言模型强调记忆模块的持续更新,使它们能够顺序处理长输入。虽然大多数记忆增强大语言模型使用外部模块记忆隐藏状态,本文探索直接将传入知识存储在模型参数中。

2.4 测试时训练和现代 RNN

测试时训练(TTT)已成为一种有前途的方法,通过在推理时微调参数来适应未见数据分布。最近的工作应用类似概念开发高效架构——通常称为现代 RNN——旨在替代 Transformer,但通常需要从头预训练。相比之下,本文通过以自监督方式在长输入上微调来增强任意预训练模型的长上下文能力,这个过程不限于特定架构或层。

2.5 合成数据生成

合成数据在现代大语言模型预训练中越来越常见。现有方法利用基于规则的方法或大语言模型通过通用重写或任务导向生成来增强原始训练文本。具体来说,Genie 探索使用合成任务来增强大语言模型的基于上下文的问答能力。然而,它主要改进模型的 ICL 能力而不是帮助其内化上下文;因此,上下文应在测试时提供,导致显著开销。相比之下,SEAL 利用大语言模型合成训练数据并在测试时微调自身,而 InfiniteICL 将上下文感知的教师模型蒸馏到无上下文的学生模型。然而,SEAL 的训练数据主要由重写的上下文组成,这些内容仍然是描述性的,难以被大语言模型内化。同时,尽管 InfiniteICL 探索更多样化的数据格式,但它依赖于能够处理长输入的强大教师模型;具体来说,InfiniteICL 通过迭代内化上下文块来构建这个教师模型,这引入了显著的延迟。

3 方法

本节介绍 LIFT,一个通过长输入微调增强大语言模型长上下文理解的框架。我们从建立微调合成任务而非原始上下文的动机开始,然后详细说明生成这些任务的方法,最后讨论流水线设计,该设计针对实际部署进行了优化以加速过程。

$$ \mathcal{L}_{\mathrm{syn}}((\mathbf{q}_{i},\mathbf{a}_{i})_{i=1}^{m};\theta)=-\sum_{i=1}^{m}\log f_{\theta}(\mathbf{a}_{i}\mid\mathbf{q}_{i}) $$

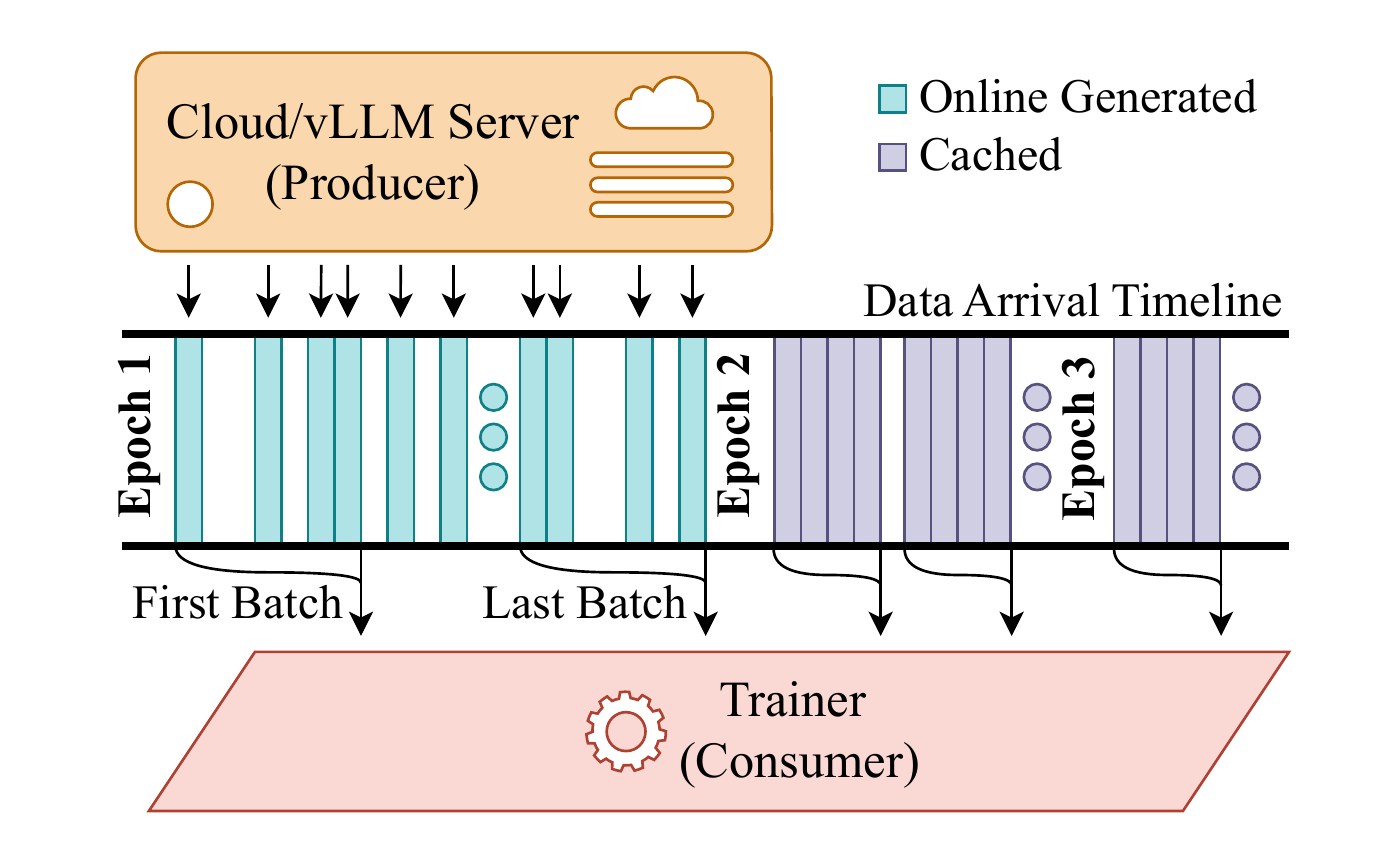

图 3:异步生产者-消费者流水线工作流程。在第一轮期间,流水线是生产者受限的,因为合成数据通过云端/vLLM 服务器在线生成。在后续轮次中,系统转变为消费者受限状态;任务从本地缓存检索,显著减少数据到达延迟。

:::

3.1 动机

虽然现有方法如 TempLoRA 和 TTT-E2E 专注于测试时训练以更好地理解上下文,但它们主要局限于在原始文本上训练。我们观察到,在原始文本上微调会导致 死记硬背 而非 真正的理解。具体来说,这种记忆化将模型限制在简单的模式匹配上,这对于灵活推理来说是不够的,并且经常导致幻觉。相比之下,在从原始文本派生的问答对上微调模型可以实现对底层知识的更深入理解。

直观地说,虽然原始文本通常以描述性、隐性和紧凑的形式表达知识,问答对将知识转换为从问题到答案的显式映射,这更加显式且更容易被模型内化。此外,我们的观察得到了关于主动阅读的经典研究的支持,这些研究表明,在阅读时提出问题是增强人类理解的有效策略。最近的工作将这一直觉扩展到大语言模型,证明模型在内部化文本时也会从问答任务中受益。

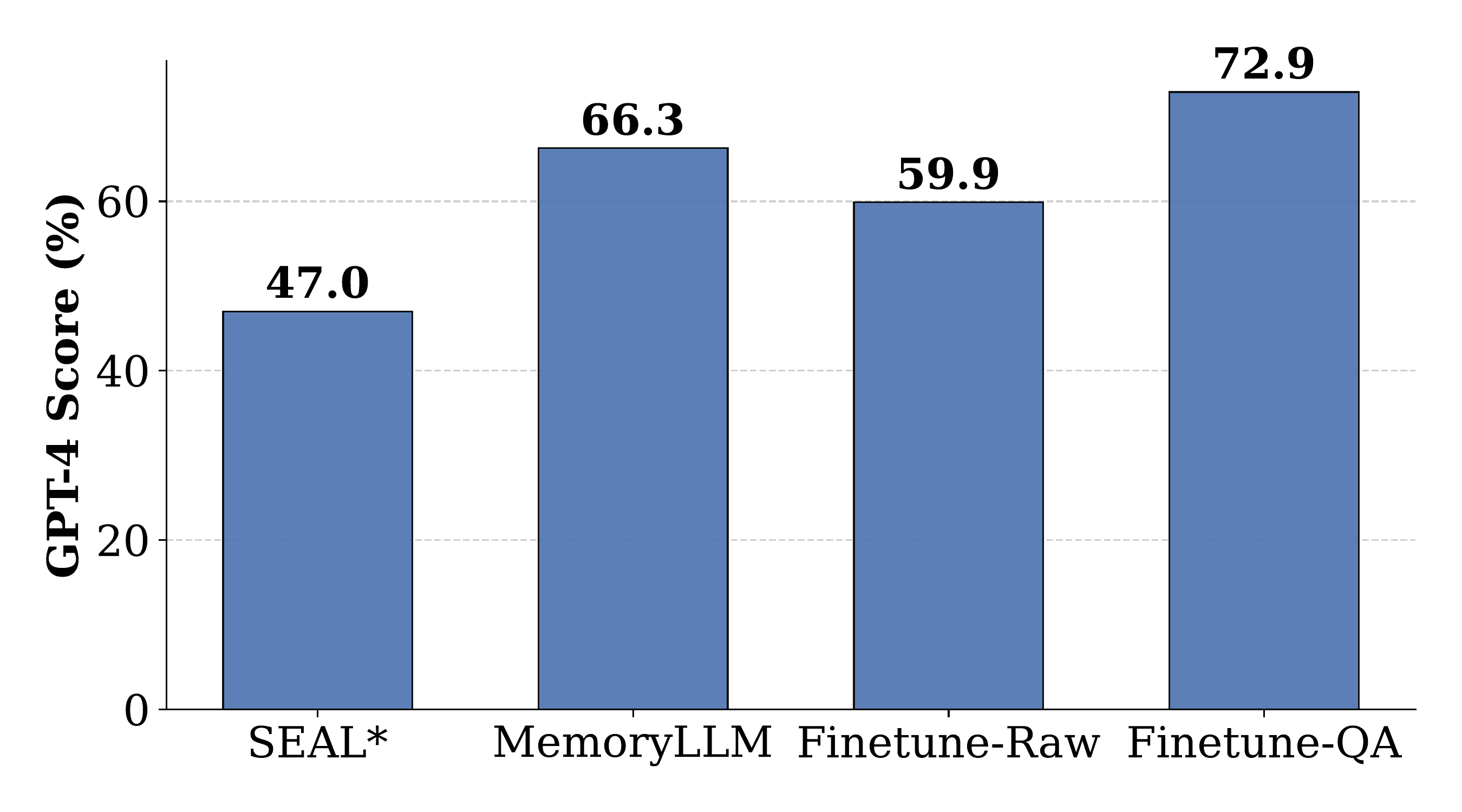

为了实证验证我们在合成问答对上微调优于在原始上下文上微调的直觉,我们使用 SQuAD 基准进行了一个试点实验。我们比较了两种设置:

- Finetune-Raw:在原始上下文上微调

- Finetune-QA:在由强大大语言模型 Qwen-2.5-72B-Instruct 从相同上下文生成的合成问答对上微调

我们观察到,Finetune-QA 在 Finetune-Raw 失败的许多情况下成功。通过对 Finetune-Raw 失败模式的手动分析,我们发现 表层模式匹配 在错误响应中占主导地位。我们定义"表层模式匹配"为模型的响应在词汇上与上下文重叠,尽管根本误解了上下文含义的情况。其他失败模式包括 预训练知识干扰(响应不受上下文支持,可能来自模型的先前知识)和 拒绝(模型无法从其先验或新学习的上下文知识中检索相关信息)。两者都表明 Finetune-Raw 未能充分教授模型上下文知识。相比之下,表层模式匹配在 Finetune-QA 中很少发生,其中的失败归因于上下文信息的覆盖不足——这是一个可以通过改进提示或增加合成问答数量来缓解的限制。

3.2 合成任务生成

正式地,给定一个长输入 $\mathbf{x}$,我们提示一个大语言模型(此后称为生成器,以区别于 LIFT 训练的目标大语言模型)根据 $\mathbf{x}$ 生成问答对 $(\mathbf{q}_{i},\mathbf{a}_{i})_{i=1}^{m}$。这些问答可以是简单的细节,如特定人物、时间、事件地点,或更一般的阅读理解问题。

在实践中,为了避免处理长序列,我们将 $\mathbf{x}$ 分割成句子,并提示生成器为每个句子合成问答对。代表性的示例见附录。我们采用 Qwen2.5-72B-Instruct 作为生成器,合成任务根据相应句子生成。

我们通过监督微调在合成任务上训练目标大语言模型 $f_{\theta}$,使用以下目标:

$$ \mathcal{L}_{\mathrm{syn}}((\mathbf{q}_{i},\mathbf{a}_{i})_{i=1}^{m};\theta)=-\sum_{i=1}^{m}\log f_{\theta}(\mathbf{a}_{i}\mid\mathbf{q}_{i}) $$对于如何从 $\mathbf{x}$ 合成 $(\mathbf{q}_{i},\mathbf{a}_{i})_{i=1}^{m}$ 没有严格限制。在实践中,可以设计定制的提示或流水线来生成与特定下游应用对齐的合成任务。例如,在小说理解中,可以提示生成器专注于时间线、主要人物和其他显著元素。在我们的案例中,由于我们针对一般长上下文任务,我们故意避免在合成任务生成中引入归纳偏置。

为了确保合成任务包含句子内的所有相关信息,我们提示生成器为每个句子生成多个(例如 5 或 10)问答对。此外,我们定制生成流水线和提示,以确保上下文一致性同时促进合成任务的多样性。

3.3 高效开发设计

LIFT 流水线主要由两个组件组成:合成任务生成和微调。为了增强其效率,特别是减少首 token 时间(TTFT),我们引入了几项设计,共同加速合成任务生成和微调。

首先,给定每个句子的固定 token 预算,我们为每个句子生成多个短问答对而不是单个长问答对。从计算角度来看,在几个短问答对上训练比在一个长问答对上训练更不复杂且更高效,同时仍然捕获原始句子传达的基本信息。具体来说,假设我们生成 $m$ 个问答对,每个长度为 $l$。在这些问答对上训练的复杂度为 $\mathcal{O}(ml^2)$。相比之下,假设我们生成单个长度为 $ml$ 的问答对。在其上训练的复杂度为 $\mathcal{O}(m^2l^2)$。因此,将长问答分成多个较短的问答显著减少了训练开销。

最后,我们设计了一个 异步生产者-消费者流水线,共同加速生成-训练工作流程。在这个流水线中,生成器作为持续输出问答对的生产者,而训练器作为检索生成的问答对以构建微调小批量的消费者。如果可用任务不足以填充批量,训练器阻塞直到新任务到达,而生成器独立于训练器的进度运行。通过上述并行化生成优化,我们允许生产率匹配消费率,从而减少流水线中的空闲时间。

重要的是,训练器仅在第一轮体验阻塞。一旦所有合成任务生成并缓存,后续轮次可以直接从缓存获取数据而无延迟。实证上,生成合成任务所需的时间大致相当于单个微调轮次的持续时间。由于生成和训练过程在我们的流水线中并发发生,合成任务生成的开销被训练时间有效掩盖。因此,生成这些任务的成本变得可以忽略不计。

这些设计共同 显著加速 LIFT 流水线,将合成任务生成和微调的开销减少到中等长输入的 秒级,从而大大减少 TTFT。

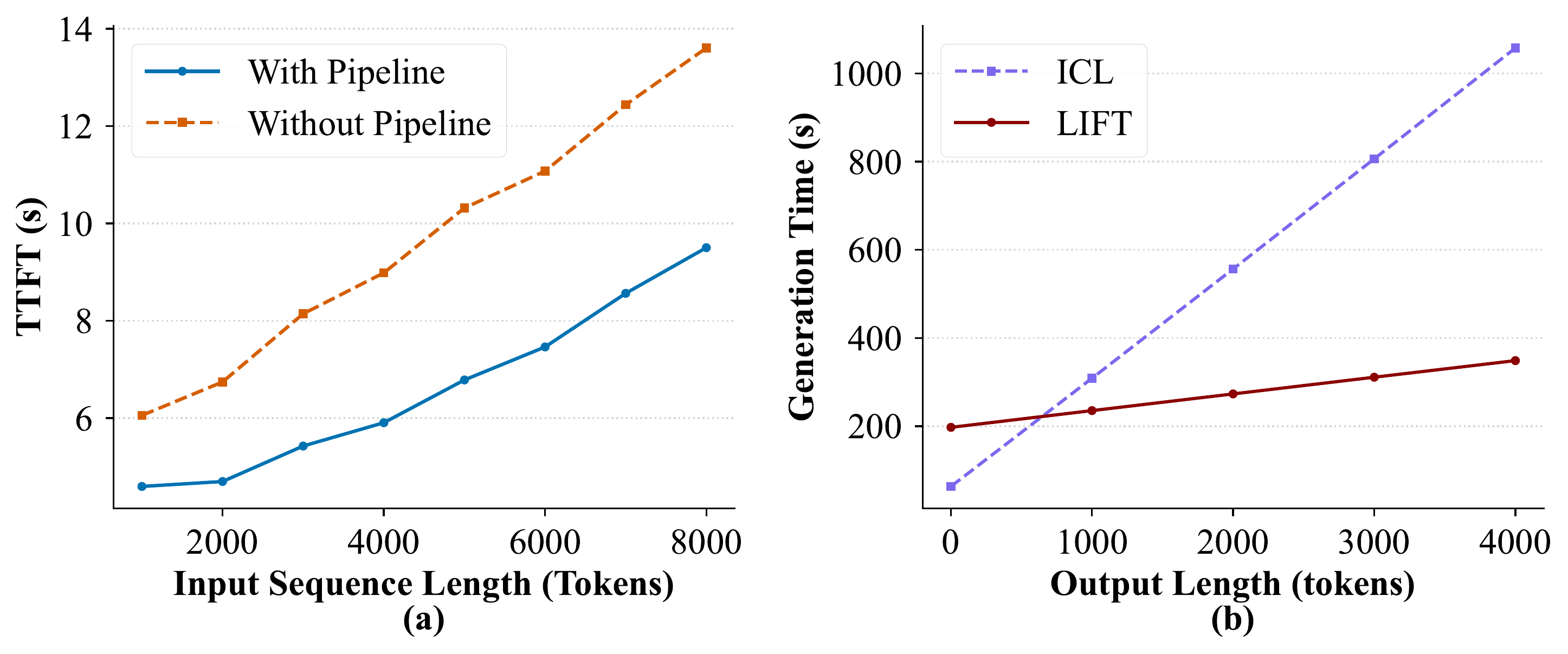

图 4:效率基准测试结果。(a) 不同输入长度下的首 token 时间(TTFT),比较有无 LIFT 异步流水线的性能;"无流水线"表示所有合成任务生成完成后才开始 SFT。(b) 固定输入长度 128K 时,总生成时间(秒)相对于输出 token 长度的关系;对于 LIFT,总时间包括一次性训练开销和后续推理成本。

:::

4 实验

4.1 设置

数据集和指标:

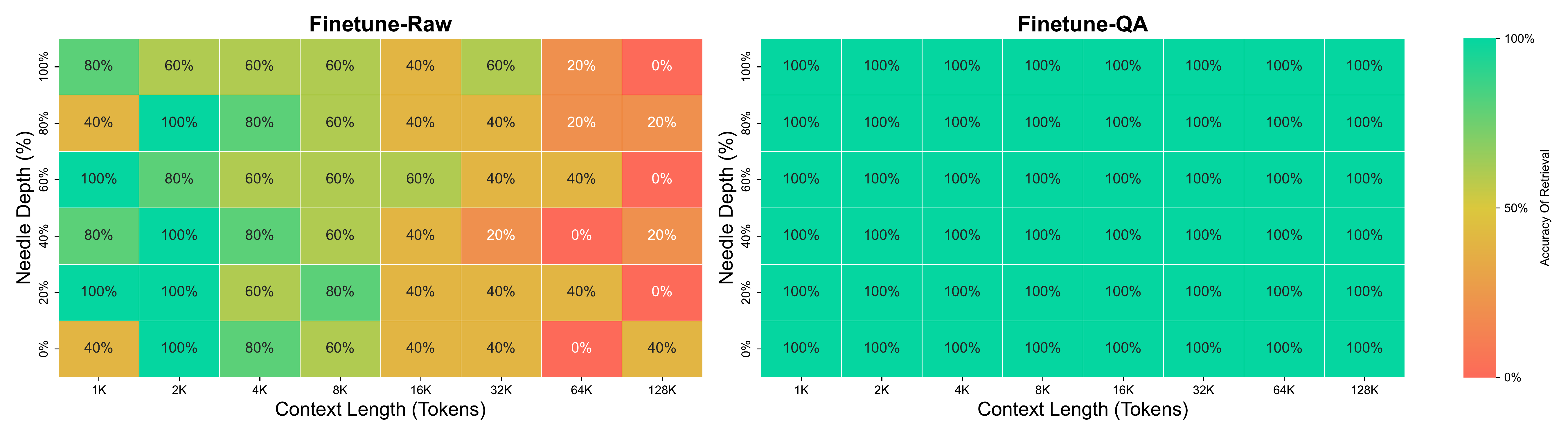

除了动机部分提供的示例,我们在 SQuAD 基准和 Needle-In-A-Haystack (NIAH) 上进一步验证 LIFT。

SQuAD:基于上下文的问答基准,旨在评估模型对给定文本的理解能力。这是 LIFT 的基本评估,因为其上下文仅限于几个句子,任务对现代大语言模型相对简单。

NIAH:用两个属性表征每个测试案例:文档长度 $L$ 和插入深度 $D$(以百分比表示)。具体来说,它将针句子插入长度为 $L$ 的文档的位置 $D$,并使用该文档作为上下文。然后模型需要根据提供的上下文回答问题。随着 $L$ 增加,测试变得更困难,而变化 $D$ 评估模型是否遭受 lost-in-the-middle 问题。

对于更具挑战性的长上下文任务,我们在 LooGLE 上评估 LIFT,这是一个挑战性基准,提供对 LIFT 能力的全面评估。LooGLE 基准包含两个子任务:ShortQA 和 LongQA。在两个子任务中,测试案例向模型提供长文档并要求模型根据文档回答几个问题。ShortQA 中的任务要求模型从特定句子提取信息,而 LongQA 中的任务要求模型在整个文档中收集信息。总体而言,LongQA 比 ShortQA 更难。

评估指标与基线使用的指标一致。对于 SQuAD,我们采用 LLM-as-a-judge 指标。具体来说,我们使用 GPT-4 判断模型响应和真实答案是否语义等效,记为 GPT4-score。对于 NIAH,每个测试案例由 5 个具有不同干扰上下文的测试实例组成。只有当所有关键词出现在响应中时,响应才被视为正确。

LIFT 设置:

在 标准 LIFT 设置中,基础大语言模型仅使用 LoRA 适配器在合成任务上微调。我们采用 Qwen-2.5-72B-Instruct 作为生成器,提示它为每个句子合成 $m$ 个问答对。我们实验 $m=5$(LIFT with 5QA)和 $m=10$(LIFT with 10QA)。在推理期间,问题提供给 LIFTed 大语言模型,不提供上下文。值得注意的是,对于基准中的每个实例,我们独立微调一个基础大语言模型。

为了实证验证在合成任务上微调增强上下文理解,我们引入 Finetune-Raw,其中基础模型仅在原始上下文块上微调。对于 SQuAD 和 NIAH 基准,我们将标准 LIFT 设置(10 QA)记为 Finetune-QA。

基线:

我们将 LIFT 与截断 ICL、RAG、记忆增强大语言模型和提示压缩方法进行比较。

截断 ICL:骨干模型在给定上下文的情况下回答问题,上下文被截断以适应 8K 上下文窗口。

LlamaIndex:广泛采用的 RAG 框架,使用 bge-small-en-v1.5 作为嵌入模型。

MemoryLLM 和 LLMLingua:作为记忆增强大语言模型和提示压缩方法的代表。

4.2 SQuAD 上的结果

如图所示,标准 LIFT (Finetune-QA) 显著优于 Finetune-Raw,甚至超过了 MemoryLLM(短上下文基准的强基线)。如表中示例所示,Finetune-Raw 将模型限制在模式匹配。此外,Finetune-Raw 仅依赖给定上下文。相比之下,MemoryLLM 在大规模语料库上预训练其记忆模块,允许它更好地捕获上下文中的知识。然而,这种潜在知识表示仍然难以被骨干模型利用。

同样,虽然 SEAL 中的重写上下文提供高词汇多样性,它们仍然是描述性的,以隐性和过度压缩的方式表示知识。相比之下,Finetune-QA(标准 LIFT)通过显式问答对表示知识。我们的结果表明,这种显式格式是四种方法中最有效的表示。值得注意的是,尽管 SEAL 采用更强的基础模型(Qwen-2.5-7B),它仍然不如 LIFT,进一步验证了我们方法的有效性。

图 5:SQuAD 上的性能比较(GPT-4 Score)。

:::

4.3 NIAH 上的结果

如图所示,LIFT (Finetune-QA) 在 NIAH 基准上实现了完美准确率。作为示例,表中展示了 LIFT 中为针生成的合成任务。我们观察到,虽然合成问题在词汇上与测试问题不同,但模型展示了跨问题格式泛化的强大能力。

相反,Finetune-Raw 的性能高度不稳定,并随着上下文长度增加表现出普遍退化。它容易被无关上下文干扰,其性能严重依赖逐字记忆化。它迫使模型记忆原始上下文的全部 token——大多数表现出低语义密度但需要显著记忆化努力——而 LIFT 将信息表示为问答对,导致对上下文更高效和有效的内化。

图 6:Finetune-QA 和 Finetune-Raw 在 NIAH 上的比较。

:::

此外,随着上下文长度增加,过度拟合整个上下文变得困难;因此,模型无法使用 Finetune-Raw 记忆针。

4.4 LooGLE 上的结果

整体性能:

如表所示,LIFT 在 LooGLE 基准上持续优于所有基线方法。在 ShortQA 子任务上,LIFT with 10QA 是唯一达到 50% 以上准确率的方法,以大幅领先所有基线。在更具挑战性的 LongQA 子任务上,LIFT with 5QA 和 LIFT with 10QA 都优于所有基线,验证了 LIFT 对长上下文推理的有效性。

总体而言,这些结果展示了 LIFT在信息提取能力和推理能力方面的有效性。

具体来说,我们观察到增加合成任务数量提高 ShortQA 性能,但将其从每个句子 5 增加到 10 对 LongQA 无进一步收益。这种差异可以通过两个子任务的差异解释。ShortQA 主要评估信息提取,生成更多合成任务增加句子级细节覆盖,从而提升性能。相比之下,LongQA 要求模型在整个文档中整合信息并进行推理。由于额外的合成任务主要增强局部信息覆盖而非信息关联能力,它们对 LongQA 提供很少益处。

LongQA 四个类别的性能:

为了提供更细粒度的评估,LongQA 子任务进一步分为四个类别:理解与推理、多信息检索、计算和时间线重排序,每个设计评估长上下文能力的不同方面。

LIFT 在多信息检索和时间线重排序类别上产生最大改进,因为合成任务主要帮助模型更好地理解和保留文档中提供的信息。相比之下,解决计算和理解与推理类别的任务要求模型结合从合成任务蒸馏的外部知识与自身内部推理能力以得出正确答案。

4.5 对其他骨干模型的泛化性

为了评估 LIFT 的泛化性,我们将其应用于 Gemma 2 和 Qwen 3,在 LooGLE 上与截断 ICL 基线比较其性能。我们采用 LIFT 的标准设置,为每个句子生成 10 个问答对,在推理期间不向 LIFTed 模型提供原始文档。

如表所示,LIFT 持续改进所有骨干模型的长上下文理解。这表明合成任务策略对不同骨干模型具有泛化性。

4.6 效率分析

我们进一步进行实验评估 LIFT 的效率。通过实现异步流水线,我们促进快速适应并显著减少延迟。

如图 4(a) 所示,LIFT 将 8K 上下文长度的 TTFT 保持在 10 秒以下;没有异步设计,训练器必须等待生成器,引入显著延迟。

此外,通过将输入 token 转换到大语言模型参数,LIFT 消除了在生成 token 时在整个输入序列上计算注意力的需要。因此,LIFT 的解码速度远高于需要在整个长输入上进行昂贵注意力计算的长上下文 ICL。

我们测量总时间成本——考虑 LIFT 中初始微调阶段——与 ICL 对于最多 4K token 的输出序列。如图 4(b) 所示,当输出超过 1K token 时,LIFT 开始在总时间上优于 ICL,这是一个在现实应用中经常达到的阈值。

此外,一旦微调,模型可以回答多个上下文相关问题而不提供原始上下文,而 ICL 每次回答问题时必须读取 KV cache。这些优势源于 LIFT 仅需要对长输入进行一次性微调;在微调阶段后,它 成为短上下文模型,每个 token 的解码时间非常短。相比之下,ICL 在其 KV cache 中维护整个输入,要求模型对于每个新 token 关注所有先前 token,这产生显著延迟。

5 结论

本文提出了 LIFT(Long-Input Fine-Tuning,长输入微调),这是一个旨在增强大语言模型长上下文理解的新框架。LIFT 动态调整模型参数以适应长输入,并利用由此产生的参数内知识来改进长上下文任务的性能。我们的实验显示,LIFT 在 NIAH 基准上实现完美准确率,并在更具挑战性的 LooGLE 基准上产生显著改进。

除了实证有效性,LIFT 在概念上也具有吸引力:就像人类将短期记忆整合为长期记忆,LIFT 将上下文知识转换为参数内知识。然而,LIFT 在 LongQA 上表现出有限的性能增益,这可能源于合成任务主要改进提取局部信息的能力,但并未显著增强跨文档关联信息的能力。解决这一限制——通过设计更直接针对推理和信息整合的合成任务或训练策略——仍然是未来工作的重要方向。

四、论文简评

创新点

参数存储范式:提出将长输入存储在模型参数而非上下文窗口中,这是对传统长上下文处理的根本性范式转变。避免了自注意力的二次复杂度,保持了推理效率。

合成任务策略:利用 LLM 生成的问答对而非原始文本进行微调,超越了简单的记忆化,实现了对长上下文的深度理解。实验证明这比直接在原始文本上微调更有效。

异步流水线设计:高度优化的生产者-消费者流水线,将 8K 上下文的 TTFT 减少到不到 10 秒,具备实际部署可行性。

通用性强:适用于任意短上下文模型(Llama、Gemma、Qwen),不依赖特定架构或层。

局限性

信息关联能力有限:合成任务主要增强局部信息提取,但对跨文档的信息整合和推理改进有限。LongQA 性能增益不如 ShortQA 显著。

一次性成本:虽然推理高效,但每个长输入需要一次性微调成本。对于极短任务或单次查询场景,可能不如传统 ICL 经济。

依赖生成器质量:合成任务质量依赖于生成器 LLM(Qwen-2.5-72B),生成器的错误或偏差可能传递给目标模型。

任务特异性:合成任务设计需要针对特定下游应用优化,通用性设置可能不覆盖所有关键信息。

应用场景

- 长文档问答:法律文档、学术论文、财务报表的深度问答系统

- 知识库构建:将大量文档快速内化为模型知识

- 多轮对话系统:用户历史会话的长期记忆存储

- 书籍/小说理解:长篇内容的情节分析、人物关系提取

可改进方向

增强跨段落信息关联:设计跨句子、跨段落的合成任务,如"段落A和段落B的关系"、"时间线推理"等。

分层合成任务:从细节提取(句子级)、段落理解(段落级)到文档级推理的多层次任务设计。

自适应任务生成:根据文档结构和内容自动调整合成任务的类型和数量。

增量式微调:支持对已 LIFTed 模型的增量更新,避免对整个长输入重新微调。

与其他技术结合:与 RAG、记忆增强模块等技术结合,形成混合解决方案。

附录:关键表格对比

:::table 表 1:传统长上下文理解方法与 LIFT 的比较

| 方法 | 知识存储 | 输入长度 | 推理成本 | 大语言模型上下文集成 |

|---|---|---|---|---|

| ICL | 上下文窗口 | 有限 | 高 | ✓ 完全 |

| RAG | 外部数据库 | ✓ 无界 | ✓ 低 | ✗ 部分 |

| LIFT | 参数 | ✓ 无界 | ✓ 低 | ✓ 完全 |

:::

:::table 表 2:LooGLE 基准性能(基于 Llama-3-8B-Instruct)

| 方法 | ShortQA | LongQA | 理解推理 | 多信息检索 | 计算 | 时间线重排 |

|---|---|---|---|---|---|---|

| MemoryLLM | 33.06 | 20.44 | 29.31 | 15.53 | 8.00 | 18.14 |

| LlamaIndex | 41.93 | 21.07 | 33.00 | 17.11 | 12.00 | 9.77 |

| TempLoRA | 29.67 | 25.97 | 32.02 | 19.47 | 12.00 | 32.56 |

| 截断 ICL | 44.49 | 15.44 | 25.37 | 15.26 | 5.00 | 1.86 |

| Finetune-Raw | 33.93 | 25.16 | 30.05 | 20.53 | 18.00 | 27.44 |

| LIFT (5QA) | 45.67 | 26.79 | 29.80 | 21.58 | 14.00 | 36.28 |

| LIFT (10QA) | 52.69 | 27.25 | 27.83 | 22.63 | 16.00 | 39.53 |

:::

:::table 表 3:Finetune-QA vs Finetune-Raw 模型行为比较

| 相关上下文 | The university is the major seat of the Congregation of Holy Cross (albeit not its official headquarters, which are in Rome). Its main seminary, Moreau Seminary, is located on the campus across St. Joseph lake from the Main Building. | | 问题 | Where is the headquarters of the Congregation of the Holy Cross? | | Finetune-Raw | The headquarters of the Congregation of Holy Cross (albeit not its official seat) is located at the Main Building on the campus... ❌ | | Finetune-QA | Rome. ✓ | :::

关键观察:Finetune-Raw 失败于表层模式匹配(黄色高亮部分),而 Finetune-QA 展示了稳健的理解能力。