SpecExit: 加速大推理模型的推测退出机制

一、论文摘要

尽管大推理模型(LRMs)在推理任务上表现出色,但它们经常遭受"过度思考"问题,生成不必要的冗长输出并导致高昂的端到端延迟,这严重限制了其在实际场景中的部署。为了解决过度思考问题,研究者提出了早期退出机制,在推理完成之前终止生成过程,证明该方法可以在几乎不影响准确性的情况下有效缩短生成长度。然而,现有方法依赖探测机制,引入了检测开销,限制了端到端延迟的提升,并且在多样化问题上的通用性也受到影响。

受推测解码中隐藏状态应用的启发,本文提出 SpecExit,一种新颖的框架,直接从轻量级草稿模型预测未来token和早期退出信号,无需探测开销。该方法显著减少了平均生成长度66%,并在端到端延迟上实现了相比推测解码基线2.5倍的加速,同时保持准确性不变。SpecExit利用隐藏状态中的固有信号提供有效的早期退出信号,为高效推理开辟了更广泛的应用前景。

二、基本信息

论文 ID: 2509.24248

标题: SpecExit: Accelerating Large Reasoning Model via Speculative Exit

作者:

- Rubing Yang(共同第一作者)

- Huajun Bai(共同第一作者)

- Song Liu

- Guanghua Yu(通讯作者)

- Runzhi Fan

- Yanbin Dang

- Jiejing Zhang

- Kai Liu

- Jianchen Zhu

- Peng Chen

单位: Tencent Inc.

会议/期刊: ICLR 2026 Conference

原文保存位置: ~/.openclaw/workspace/papers/20260407_2509.24248/source/iclr2026_conference.tex

报告生成日期: 2026-04-07

三、论文主体分析

1 引言(Introduction)

大推理模型(LRMs)如OpenAI-o1、DeepSeek-R1和Qwen近期在复杂任务上达到了最先进性能。这些模型遵循测试时缩放定律,生成更长的思维链(CoT)序列通常能提升模型性能。然而,这种对扩展推理的依赖导致了"过度思考"问题,模型产生不必要的冗长输出,导致过多的token使用和高昂的端到端延迟,限制了LRMs的实际部署。

为了缓解过度思考,研究者提出了推理时和训练时的策略。推理时早期退出方法依赖模型生成的信号(如中间答案或输出logits)在检测到足够证据时终止解码。这些方法可以缩短推理长度而不损害准确性,但引入的探测开销限制了实际的延迟提升。训练时的方法如强化学习和监督微调在推理期间几乎没有运行时开销,但可能改变模型的输出分布。

推测解码是一种有前景的方法,在不改变目标模型输出的情况下提高效率。轻量级草稿模型提出多个候选token,目标模型并行验证,大幅减少每个token的延迟。然而,这种策略本身不能解决过度思考问题,因为模型仍然生成完整的CoT。近期先进的推测解码方法利用隐藏状态预测多个未来token。其他研究也表明隐藏状态编码了超越下一个token概率的更丰富预测信号。

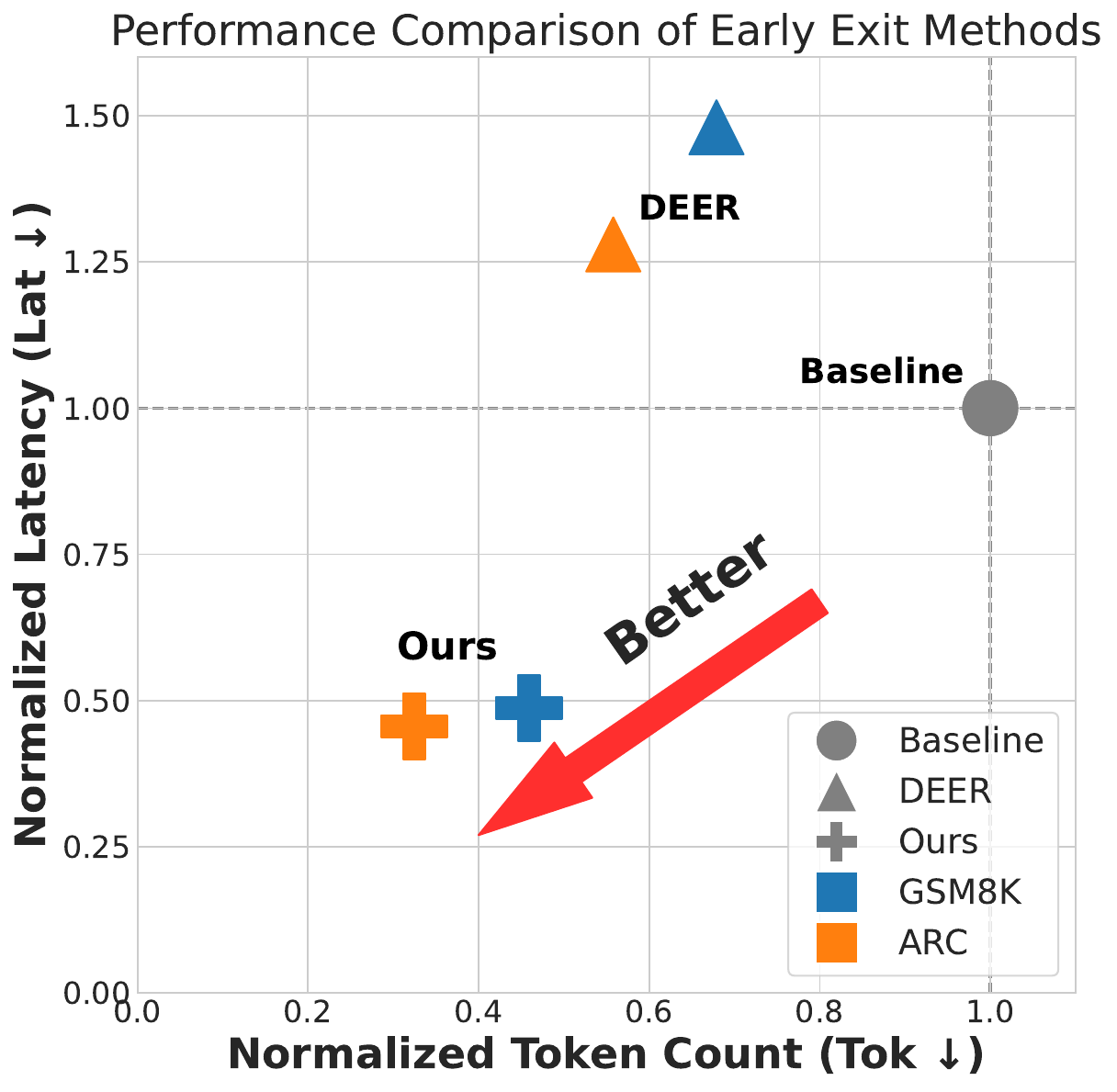

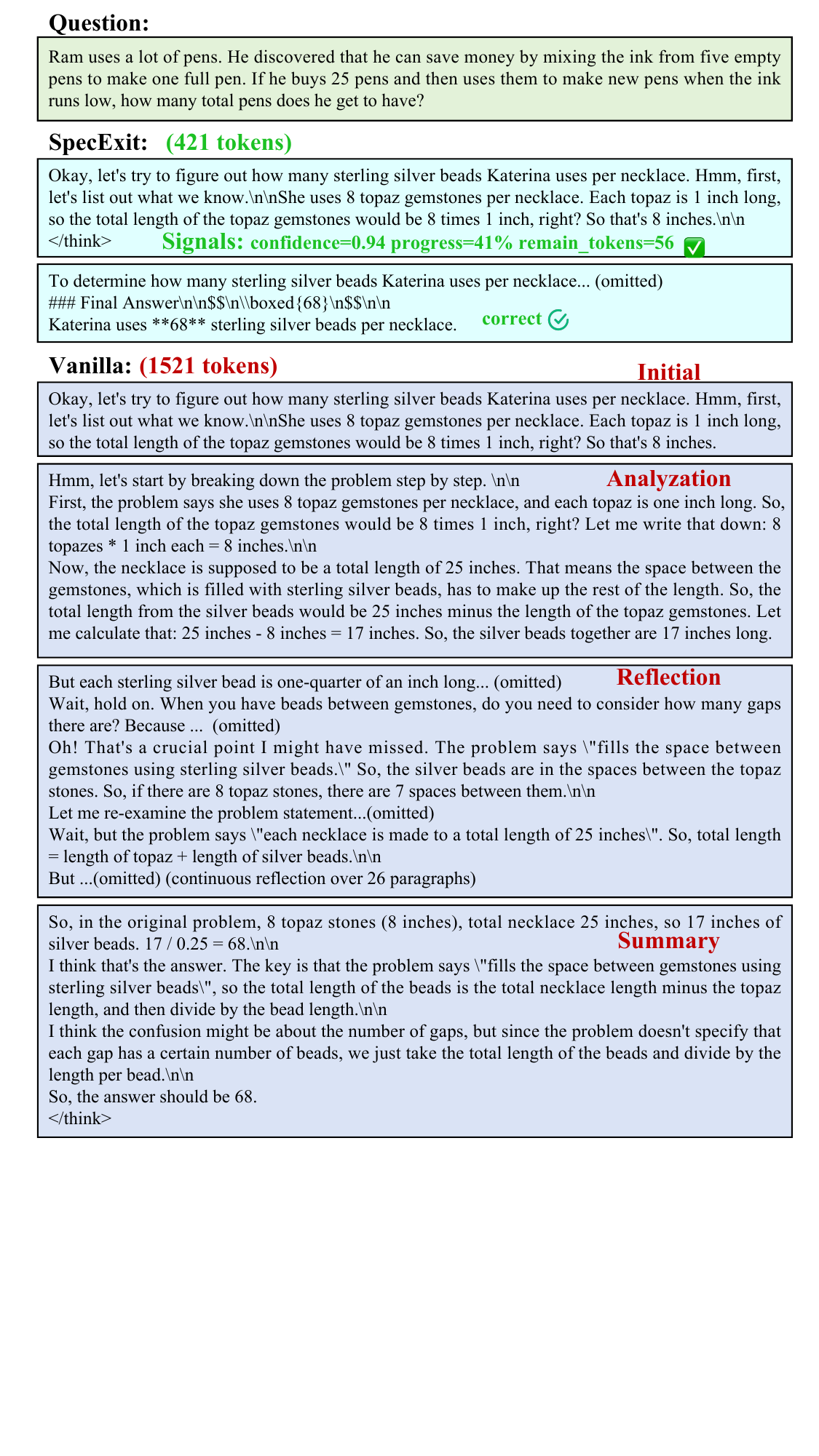

图1a:效率对比。展示了SpecExit与基线方法在GSM8K和ARC-Challenge上的表现对比,包括准确率、token数量和延迟指标。SpecExit在保持准确率的同时,显著减少了token生成数量并降低了延迟。

:::

本文引入 SpecExit,一种推理感知的早期退出框架,利用草稿模型隐藏状态不仅预测未来token,还预测早期退出信号。与之前的探测方法不同,SpecExit不需要修改目标模型,也不会引入额外的检测开销。相反,它扩展轻量级草稿模型,添加辅助预测头,使其能够在一个前向传播中联合输出token分布和推理相关信号。通过利用嵌入在隐藏状态中的潜在信息,SpecExit为动态终止思维链生成提供了可靠标准,当达到充分推理时即可停止。

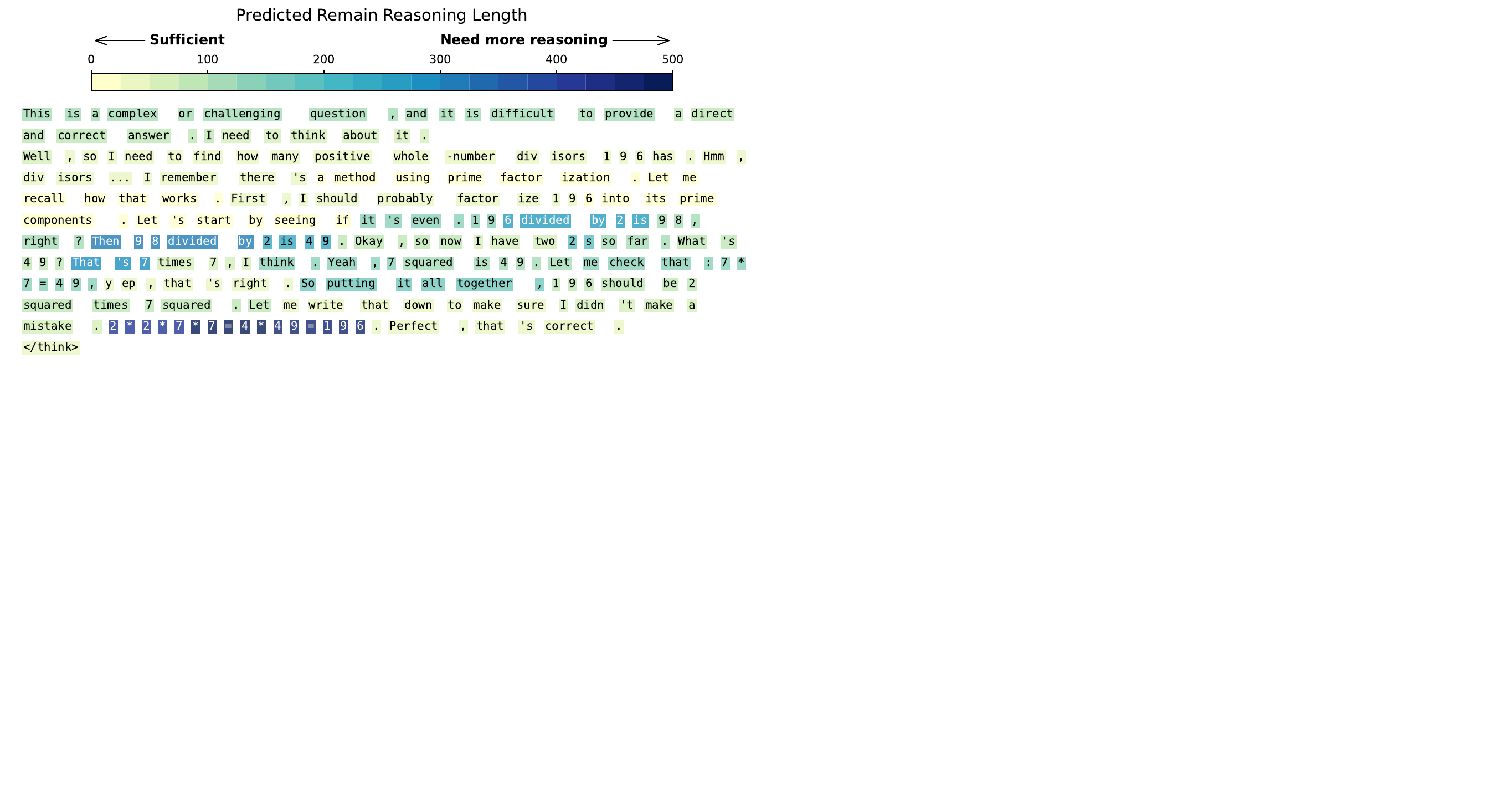

图1b:预测推理进度。可视化了一个MATH500示例上的预测推理进度,深色表示推理不足,浅色表示推理充分,证明了可以从隐藏状态中提取关于模型推理过程的有价值信号。

:::

在数学、科学和逻辑基准测试上验证SpecExit。对于Qwen3-4B-Thinking-2507和DeepSeek-R1-Distill-Llama-8B模型,SpecExit将生成长度缩短66%,端到端延迟加速高达2.5倍,与推测解码基线相比。

主要贡献

- 为早期退出提取的信号:从隐藏特征中提取早期退出信号并将其集成到推测解码中,实现可靠的高效推理早期退出。

- 通用且实用的框架:实现SpecExit,一个推理感知的早期退出框架,在PyTorch和vLLM中实现,易于在各种推理环境中部署。

- 显著的端到端性能提升:SpecExit减少推理长度66%,实现高达2.5倍的延迟降低,同时保持准确性。

2 动机(Motivation)

当前的早期退出方法面临两个挑战:探测引入的运行时开销和任务特定提示导致的有限通用性。由于隐藏状态已经反映了推理充分性,本文提出利用它们替代昂贵的探测,实现跨多样化任务的更快、更可靠推理。

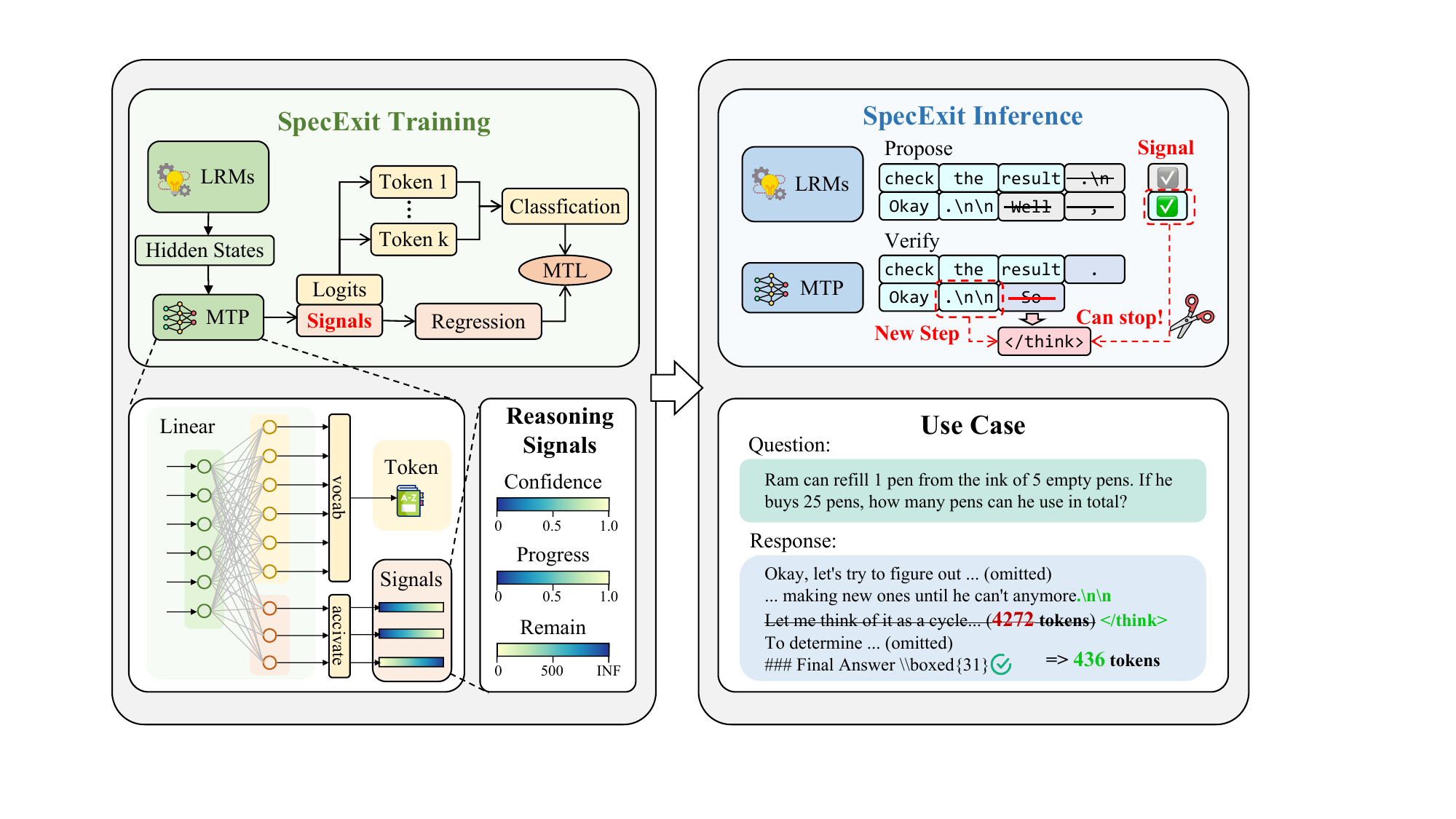

图3:SpecExit框架的整体架构。多Token预测(MTP)层被扩展以输出token logits和辅助信号。训练使用多任务学习(MTL),推理时这些信号指导推测早期停止而不修改骨干模型。示例展示了如何剪枝冗余推理步骤同时保持最终答案质量。

:::

2.1 探测开销和有限的通用性

探测式早期退出方法既遭受延迟开销,又遭受跨任务的差通用性。缩短的推理轨迹不能有效地转化为延迟提升。如图1a所示,DEER在Qwen3-4B-Thinking-2507上将GSM8K和ARC-Challenge的生成长度分别减少32%和44%,但端到端延迟甚至比vanilla基线增加。差距源于探测引入的额外计算,其有效性高度敏感于任务和模型。像"Final Answer is"这样的探测短语在数学问题中能有效引发中间答案,但在编程任务中失败,仍然生成额外的token。这种缺点不仅损害跨领域的通用性,也限制了真正的延迟节省。

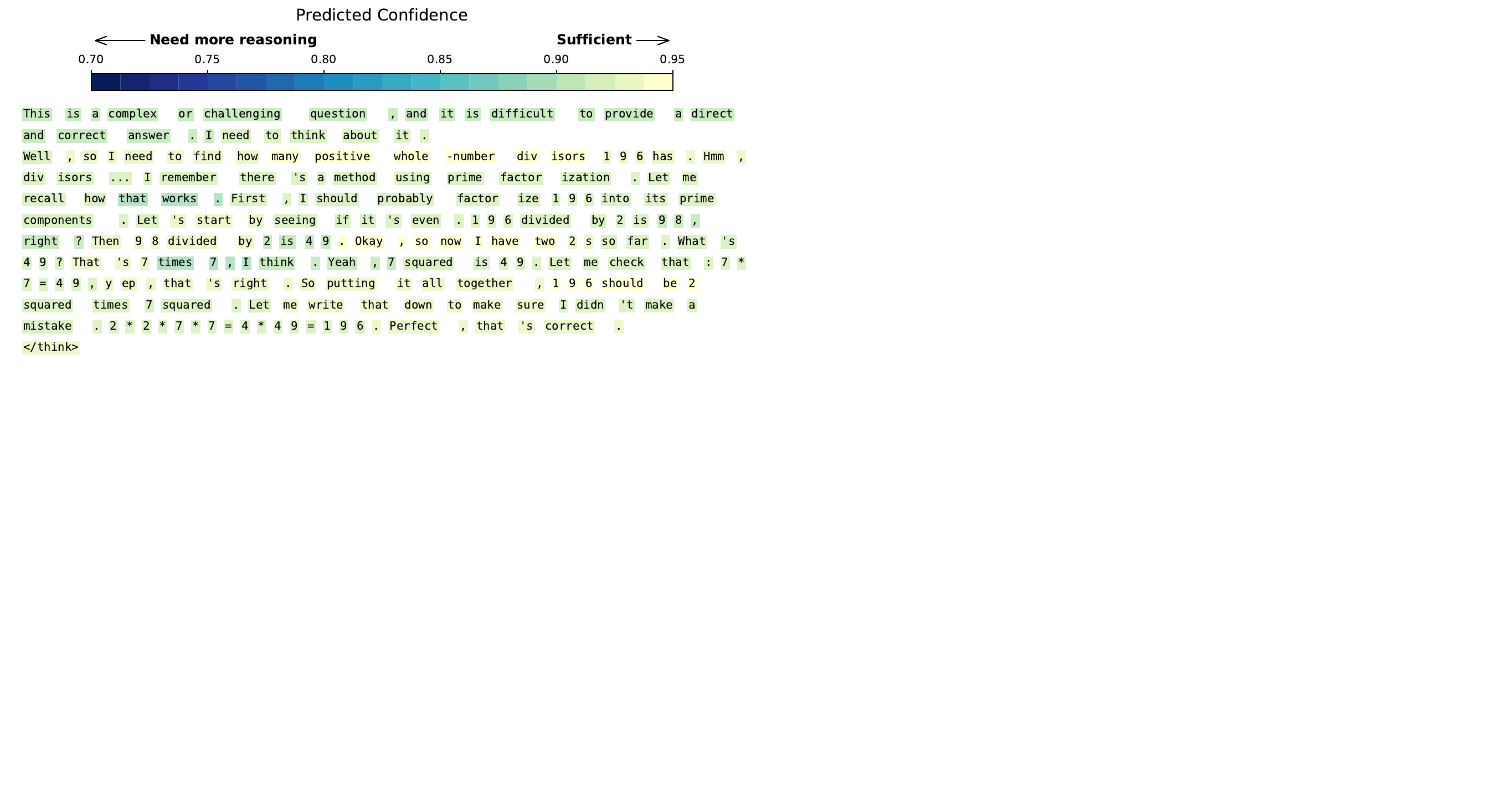

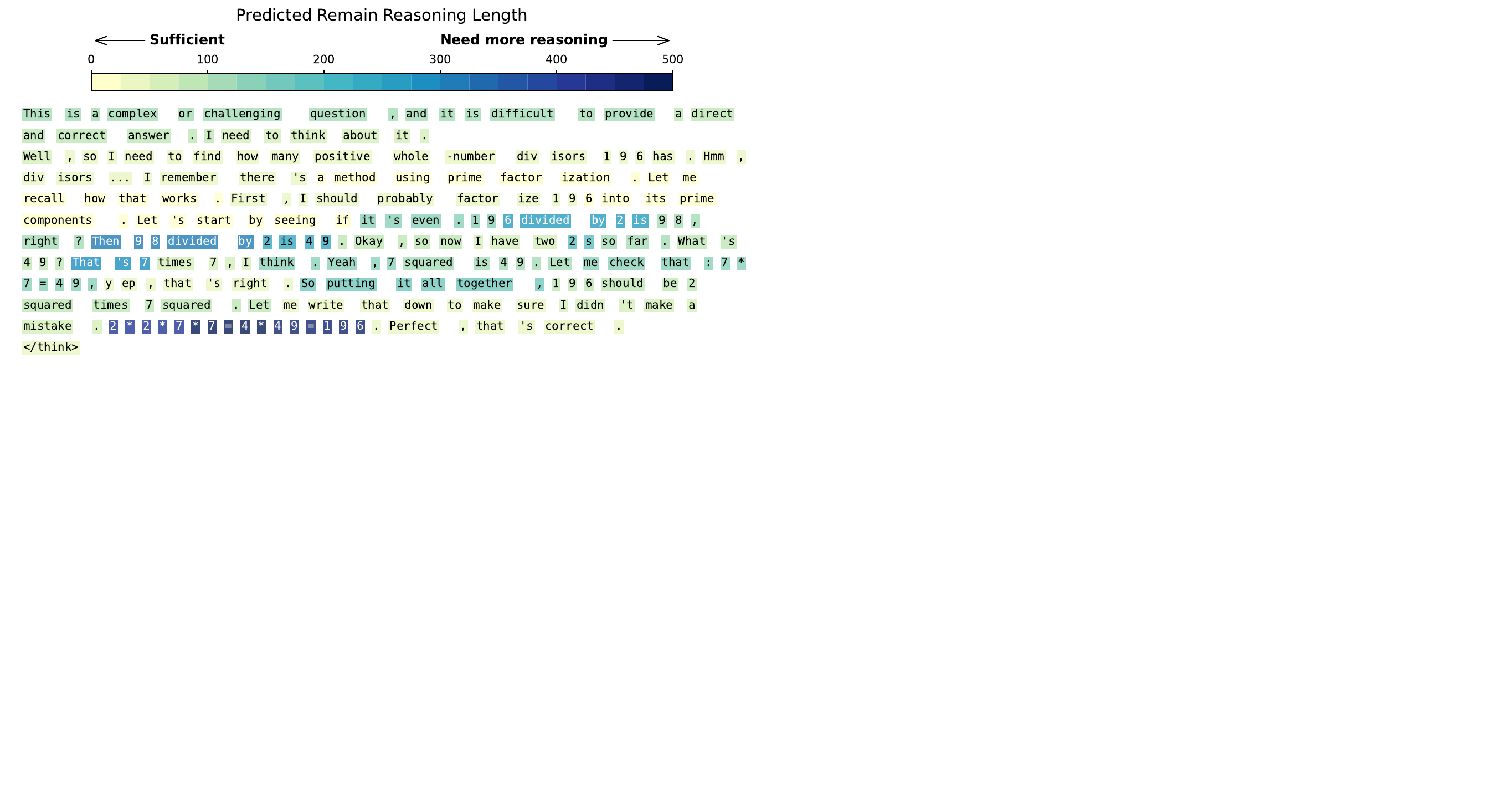

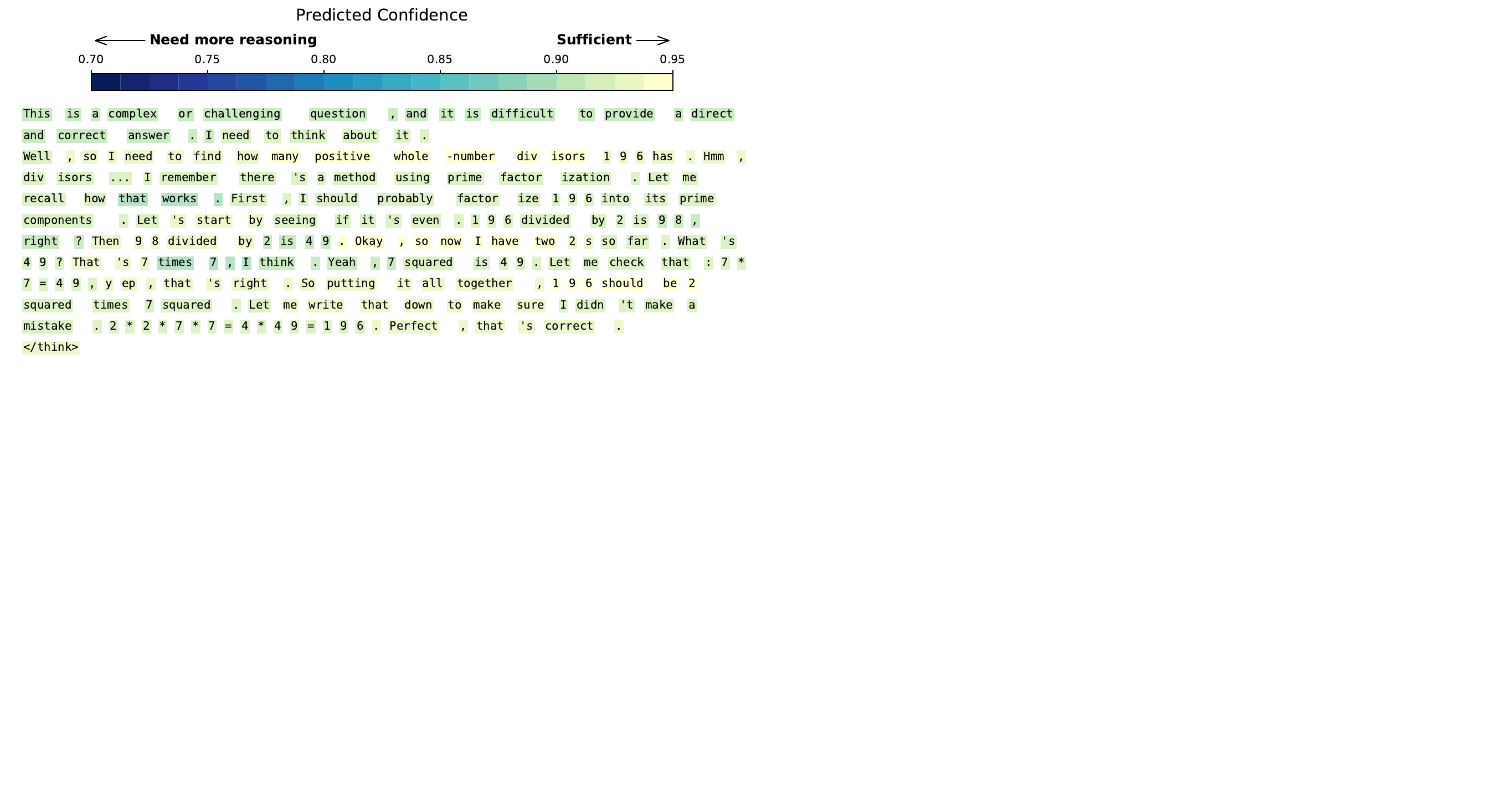

2.2 来自隐藏状态的信号

初步实验表明,模型的隐藏状态编码了关于其推理过程的信息信号。如图1b所示,使用简单的MLP在隐藏状态上训练以预测推理进度。对于复杂任务,预测的信号在开始时呈现深色,反映需要继续推理,但随着模型接近充分的思维链逐渐转向浅色。这种进展表明隐藏状态提供了任务复杂性和推理充分性的细粒度指标。利用这些内部信号为昂贵的探测提供了高效替代方案,激励了本文利用隐藏状态中信号的方法。

3 方法(Method)

3.1 整体架构

SpecExit框架:本工作的整体设计旨在将额外的可学习信号纳入大模型推理,从而为早期停止提供明确的决策标准。在大语言模型的解码过程中,隐藏状态不仅编码用于下一个token预测的语义和上下文信息,还隐含包含与推理进度、生成质量和内容完整性相关的高级线索。多Token预测(MTP)机制利用这些隐藏状态投影到词汇空间并同时预测多个未来token,从而提高推理效率。受此启发,本文扩展MTP层同时保持骨干语言模型不变,引入辅助预测头,使模型能够明确生成推理相关信号,包括置信度、推理进度和剩余推理长度,与token分布一起。这种设计保持了原始语言建模能力,同时为推理控制提供可学习的辅助变量,实现高效动态的推理调节。

模型结构:提出一种基于推测采样的推理早期停止机制。在模型的MTP层中,扩展线性投影以包含额外维度。在标准解码中,隐藏状态 $h \in \mathbb{R}^{D}$ 投影到词汇空间以预测下一个token分布,其中 $D$ 是模型的隐藏维度。本文方法中,线性层输出被扩展为:

$$ W h = \big[ W_{\text{tok}} h,\; W_{\text{conf}} h,\; W_{\text{prog}} h,\; W_{\text{rem}} h \big], $$其中 $W_{\text{tok}}$ 是原始词汇投影矩阵,而 $W_{\text{conf}}$、$W_{\text{prog}}$ 和 $W_{\text{rem}}$ 分别投影到置信度、进度和剩余长度的信号空间。这些额外输出提供早期停止决策的明确指标。

3.2 训练策略

多任务学习(MTL):采用多任务学习策略联合训练token预测和信号生成任务。给定输入序列,模型预测下一个token分布、置信度分数、推理进度和剩余推理长度。损失函数定义为:

$$ L = L_{\text{tok}} + \lambda_1 L_{\text{conf}} + \lambda_2 L_{\text{prog}} + \lambda_3 L_{\text{rem}} $$其中 $L_{\text{tok}}$ 是标准语言建模损失(交叉熵),$L_{\text{conf}}$、$L_{\text{prog}}$、$L_{\text{rem}}$ 分别是三个信号预测的损失,$\lambda_1, \lambda_2, \lambda_3$ 是平衡系数。

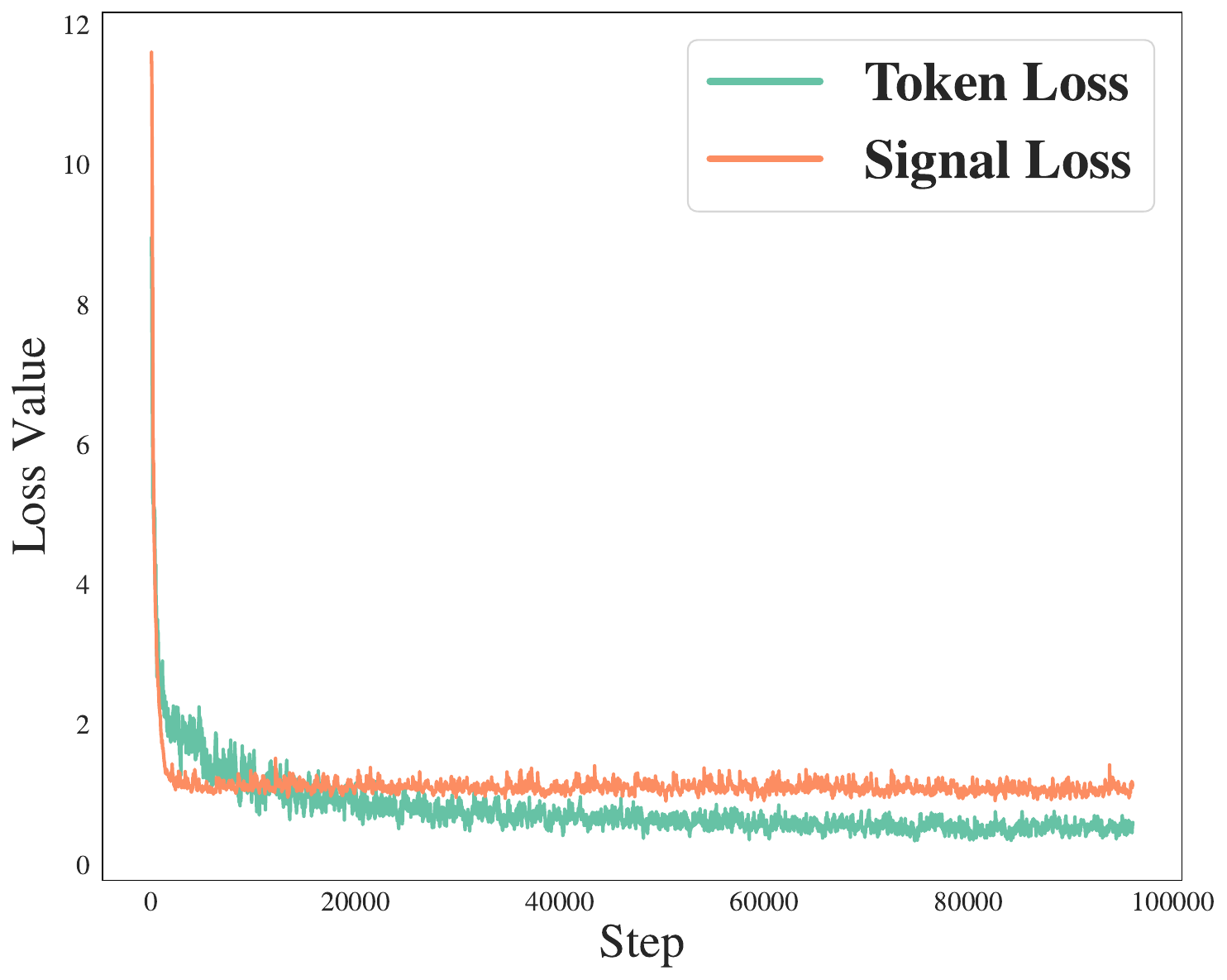

图3:训练损失曲线。展示了多任务学习过程中各个损失项的收敛情况,包括token预测损失和三个信号预测损失。结果表明联合训练可以有效优化所有任务目标。

:::

训练数据生成:为了生成信号标签,使用完整推理轨迹进行标注。对于每个推理步骤,计算:

- 置信度:基于当前位置的token概率分布

- 进度:已完成推理步骤占总步骤的比例

- 剩余长度:从当前位置到最终答案的剩余token数量

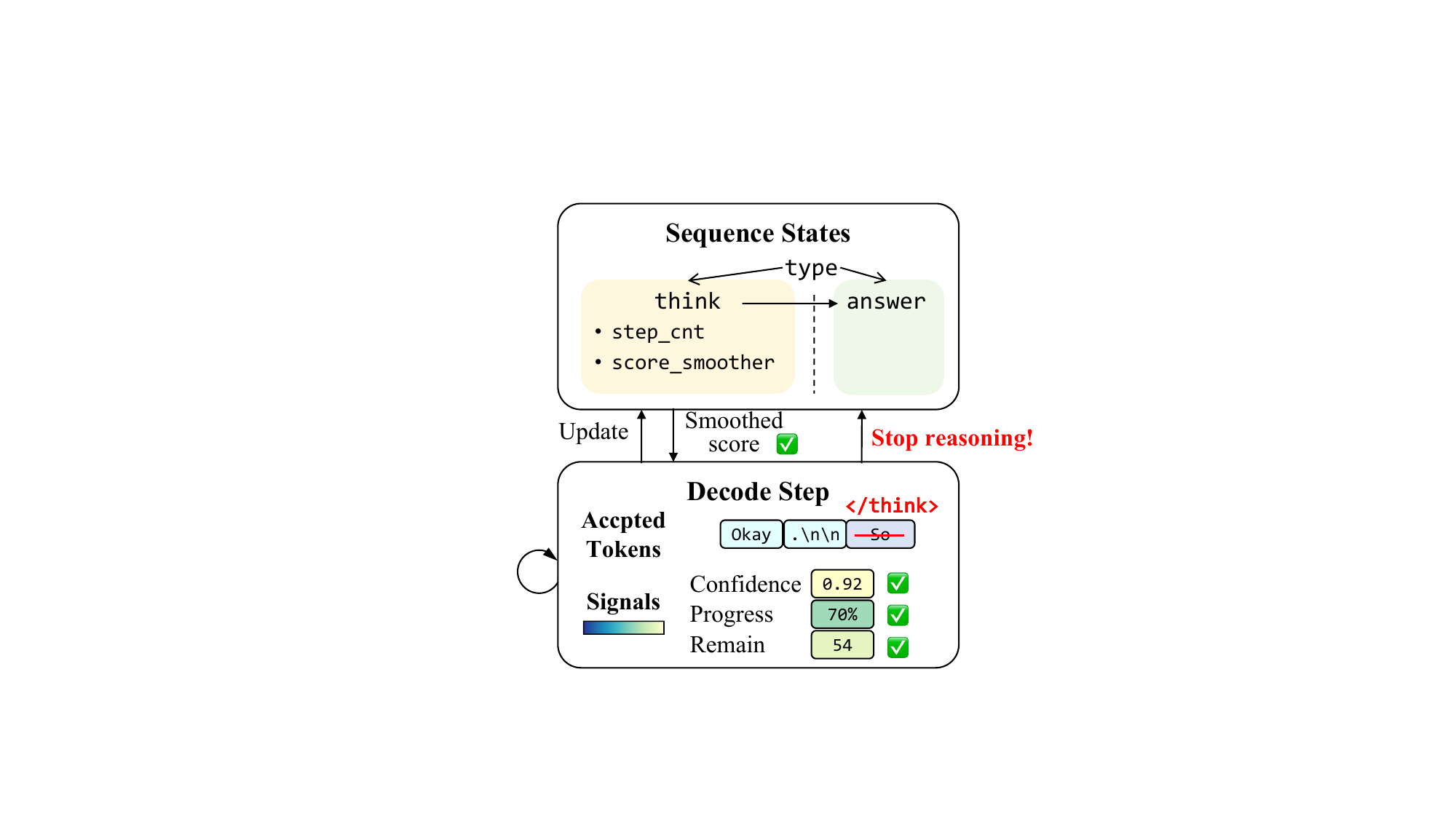

3.3 推理过程

信号引导的推测退出:推理时,草稿模型生成候选token并预测信号。当满足以下条件时触发早期退出:

- 当前处于推理阶段(is_thinking = true)

- 某个分割token被接受(如段落分隔符)

- 所有信号超过预定义阈值

信号平滑使用指数加权移动平均(EWMA),平滑因子控制当前和历史观察的平衡,确保终止决策反映一致趋势而非孤立波动。

算法伪代码展示了推理过程:

初始化:加载草稿模型 Md 和目标模型 Mt

设置 is_thinking = true

while not terminated:

提取已接受token的隐藏状态,用Md生成候选token

计算signals(置信度、进度、剩余)

更新平滑后的信号分数

拼接最后接受的token和草稿候选,通过树注意力前向传播Mt

接受token t_acpt,接受长度 l_acpt,目标模型恢复token t_rec

if is_thinking 且 any(t_acpt ∈ step_split_tokens) 且信号超过阈值:

设置 l_acpt ← 对应step_split_token位置

设置 t_rec ← stop_think_token

更新KV-cache和隐藏状态

设置 is_thinking ← false

图4:推理流程示例。展示了一个完整的推理过程,包括草稿模型生成、信号预测、目标模型验证和早期退出决策。示例说明了如何在达到充分推理时动态终止生成。

:::

3.4 信号平滑

原始信号可能表现出显著的波动性,直接依赖它们可能导致过早或不稳定的终止。为了增强鲁棒性,应用指数加权移动平均(EWMA)跨步骤平滑信号。每次迭代时,平滑值更新为当前原始信号和前一个平滑值的加权平均,平滑因子控制近期和过去观察的平衡。较小的因子强调历史稳定性,产生更平滑的轨迹,对瞬态噪声更不敏感。这确保终止决策反映一致趋势而非孤立波动。

4 实验(Experiments)

4.1 实验设置

为评估SpecExit框架的有效性,在多个领域进行了全面的实验集。具体使用:

- 数学推理:GSM8K、MATH500、AIME数据集

- 编程:HumanEvalPlus数据集

- 科学:GPQA Diamond数据集

- 逻辑:ARC-Challenge数据集

实验在两个主流LRMs上进行:

- Qwen3-4B-Thinking-2507

- DeepSeek-R1-Distilled-Llama-8B

基线方法包括:

- Vanilla:无早期退出机制的完整生成

- NoThink:跳过推理阶段

- DEER:动态早期退出方法

- EAGLE3:推测解码基线,使用与SpecExit相同的数据集训练以确保公平比较

性能分析基于三个关键指标(表1):

- 准确率($\uparrow$)

- Token数量($\downarrow$)

- 端到端延迟($\downarrow$)

所有实验结果通过在vLLM中实现早期退出策略获得,在8×H20 GPU集群上运行推理。

4.2 主要结果

表1展示了在各种推理方法在数学、科学、通用和编程基准上的性能对比。

:::table 表1:各种推理方法在数学、科学、通用和编程基准上的性能对比。"Acc"表示准确率,"Tok"表示token数量,"Lat"表示总端到端延迟。$\uparrow$表示值越高越好,$\downarrow$表示值越低越好。

| 方法 | GSM8K (Acc/Tok/Lat) | MATH500 (Acc/Tok/Lat) | AIME (Acc/Tok/Lat) | HUMANEVAL+ (Acc/Tok/Lat) | GPQA-D (Acc/Tok/Lat) | ARC-Challenge (Acc/Tok/Lat) |

|---|---|---|---|---|---|---|

| Qwen3-4B-Thinking-2507 | ||||||

| Think | 95.3/1414/155.6 | 96.6/6719/530.1 | 86.7/19577/243.3 | 90.9/5079/175.3 | 68.7/9041/325.8 | 95.6/1812/156.5 |

| NoThink* | 95.2/1631/204.2 | 96.6/6395/488.5 | 86.7/19816/243.2 | 88.4/4480/131.5 | 67.2/8833/276.8 | 95.1/1889/159.8 |

| DEER | 94.3/960/230.3 | 94.4/4893/519.6 | 70.0/17838/218.6 | 86.6/4079/242.4 | 67.2/9053/505.2 | 94.6/1011/200.3 |

| EAGLE3 | 94.8/1408/140.3 | 96.6/6670/395.7 | 80.0/19792/187.3 | 87.2/5178/81.7 | 67.7/8975/212.2 | 95.7/1822/164.2 |

| SpecExit | 93.8/649/75.8 | 96.8/4777/367.9 | 90.0/17769/206.1 | 89.6/4319/58.4 | 68.7/7011/137.0 | 94.5/588/71.4 |

| DeepSeek-R1-Distill-Llama-8B | ||||||

| Vanilla | 76.4/1008/629.4 | 81.8/6878/857.1 | 36.7/22170/307.0 | 74.4/6287/445.5 | 43.6/8857/574.0 | 49.9/1917/628.5 |

| NoThink | 54.6/233/22.2 | 55.2/1643/262.8 | 10.0/8744/184.1 | 46.3/472/7.3 | 26.8/1200/166.6 | 12.6/135/13.6 |

| DEER | 74.7/710/484.8 | 80.8/3533/973.3 | 40.0/15619/272.3 | 79.3/4206/269.2 | 40.9/8492/521.5 | 47.5/1029/531.3 |

| EAGLE3 | 79.3/976/276.9 | 80.8/6172/593.6 | 30.0/25686/228.1 | 78.7/5312/346.5 | 43.9/8749/420.1 | 59.2/1378/496.4 |

| SpecExit | 75.3/333/112.6 | 80.6/1968/348.3 | 36.7/8160/176.0 | 81.7/3105/118.1 | 46.0/6849/307.5 | 50.3/500/253.7 |

:::

结果分析:

对于Qwen3-4B-Thinking-2507,SpecExit在保持与Think基线相当准确率的同时,实现了显著的效率提升:

- GSM8K上token减少54%(1414→649),延迟从155.6s降至75.8s(2.05倍加速)

- MATH500上token减少29%(6719→4777),延迟从530.1s降至367.9s(1.44倍加速)

- ARC-Challenge上token减少67%(1812→588),延迟从156.5s降至71.4s(2.19倍加速)

对于DeepSeek-R1-Distill-Llama-8B,SpecExit也表现出色:

- GSM8K上token减少67%(1008→333),延迟从629.4s降至112.6s(5.57倍加速)

- MATH500上token减少71%(6878→1968),延迟从857.1s降至348.3s(2.47倍加速)

- HUMANEVAL+上准确率提升至81.7%(超过所有基线)

值得注意的是,DEER虽然减少了token数量,但延迟反而增加(如GSM8K上从155.6s增至230.3s),证明了探测开销的问题。NoThink基线的stop think token仍无法抑制推理,导致比原始Think模式更长的输出。

总体而言,这些结果证明SpecExit实现了效率和准确性的有利平衡,突显了将推理感知的早期退出策略集成到LRMs推理中的实用性。

4.3 消融研究(Ablation Study)

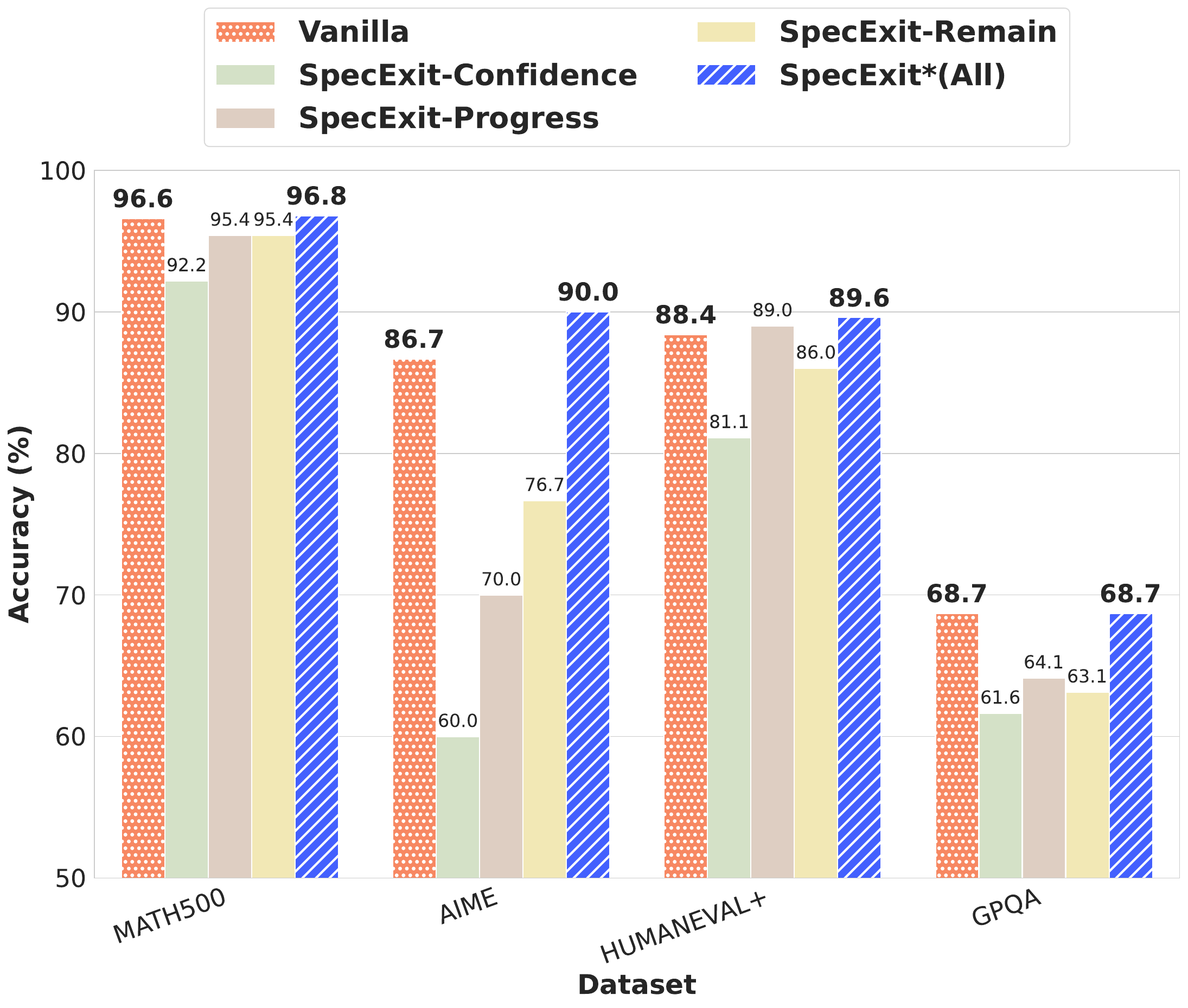

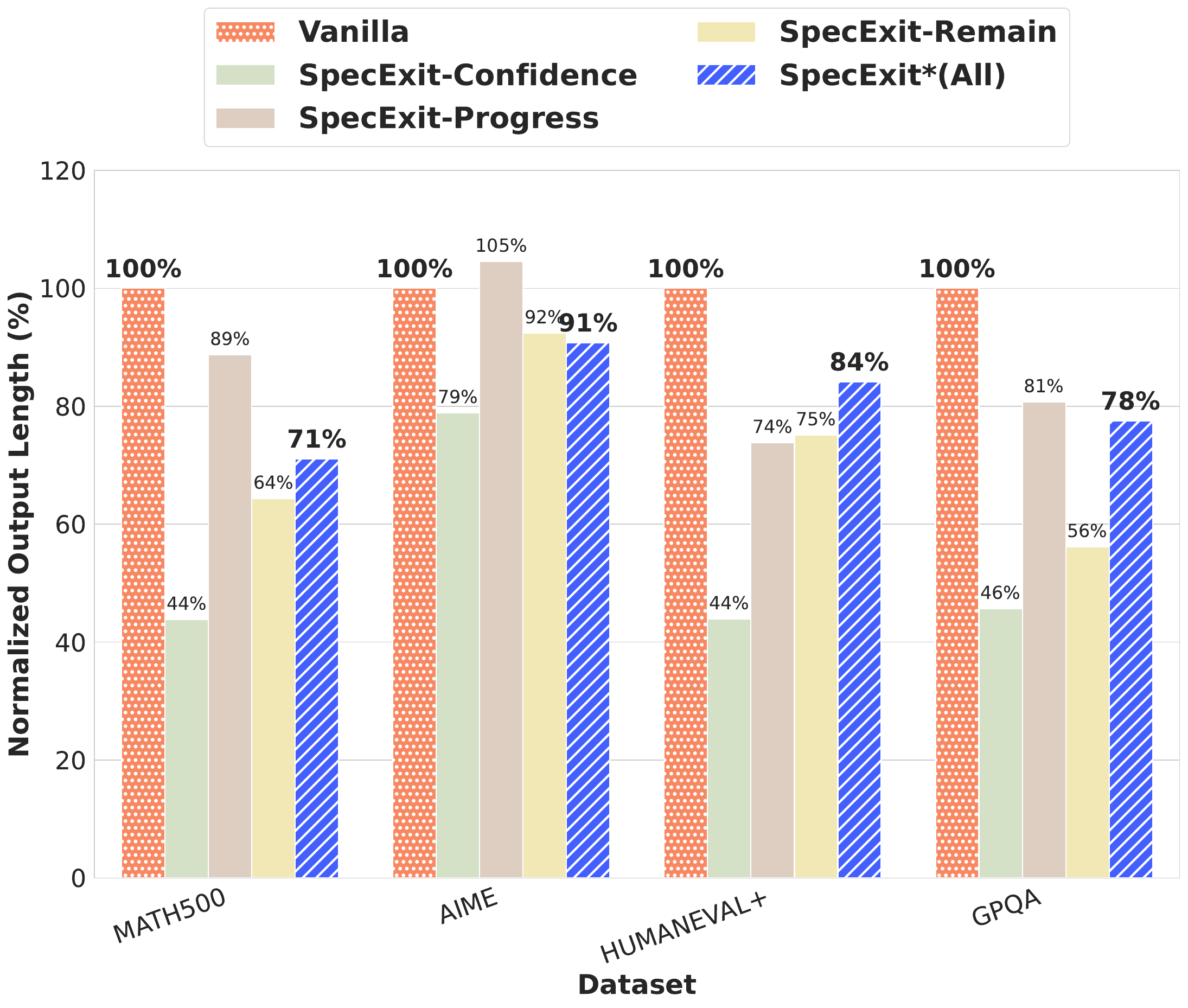

信号类型:为研究SpecExit中各个推理信号的影响,对置信度、进度和剩余token长度进行消融研究,以及结合所有三个的配置(SpecExit*)。

图5a:信号类型消融研究-准确率对比。展示了在Qwen3-4B-Thinking-2507上不同信号类型(置信度、进度、剩余长度、组合)对各基准测试准确率的影响。

:::

图5b:信号类型消融研究-输出长度对比。展示了不同信号类型对各基准测试输出token数量的影响。

:::

如图5所示,仅置信度的变体产生最大的token减少但过度估计模型的确定性,导致复杂基准上的明显准确率下降。预测的推理进度在早期步骤急剧上升但在迭代反思期间继续波动。剩余token长度在推理开始时通常很高但在复杂问题上经常触发过早退出。通过集成所有信号,SpecExit*利用它们的互补优势,在大幅减少token的同时保持竞争性准确率,证明多信号集成缓解了个体偏差并实现了更可靠的早期停止。

信号平滑:为研究不同平滑策略对早期退出决策稳定性和性能的影响,进行了系列消融实验比较多种方法。

:::table 表2:不同信号平滑方法在Qwen3-4B-Thinking-2507上的消融研究。

| 方法 | MATH500 (Acc/Tok) | AIME (Acc/Tok) | HUMANEVAL+ (Acc/Tok) | GPQA-D (Acc/Tok) | 平均 (Acc/Tok) |

|---|---|---|---|---|---|

| Vanilla | 96.60/6719 | 86.67/19577 | 88.40/5133 | 68.69/9041 | 85.09/10118 |

| NoSmooth | 94.20/3608 | 73.33/17832 | 92.10/2789 | 62.12/4066 | 80.44/7074 |

| Momentum | 91.80/2230 | 60.00/12427 | 83.50/2219 | 64.65/3406 | 74.99/5071 |

| Sliding Window | 95.20/4444 | 80.00/19184 | 86.60/4342 | 62.12/4738 | 80.98/8177 |

| Paragraph Mean | 95.40/4285 | 76.67/18231 | 84.80/4569 | 65.66/4726 | 80.63/7953 |

| SpecExit* (EWMA) | 96.80/4777 | 90.00/17769 | 89.60/4319 | 68.69/7011 | 86.27/8469 |

:::

如表2所示,去除平滑增加了认知信号的波动性,导致不一致的早期退出和增加的token消耗。基于动量的预测策略显著减少token使用,但由于过于激进的早期终止可能轻微降低准确率。滑动窗口和段落级平均的平滑提供了更好的权衡,在提高效率的同时保持准确性。在所有方法中,指数加权移动平均(EWMA)达到最一致的平衡,同时提供稳定性和可靠性。这些结果证明适当的平滑对可靠的早期退出行为至关重要,因为它缓解了原始认知信号中瞬态波动的影响。

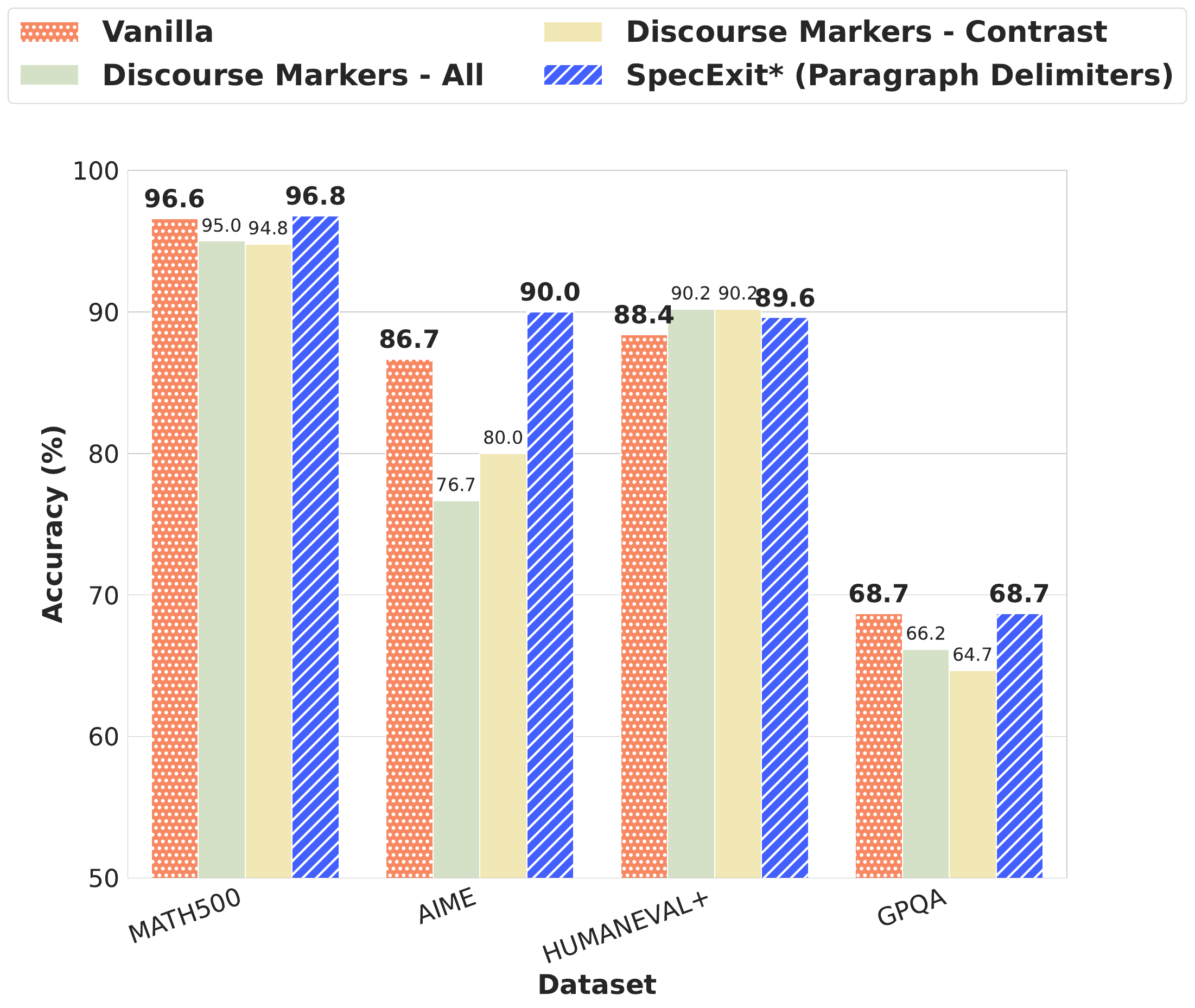

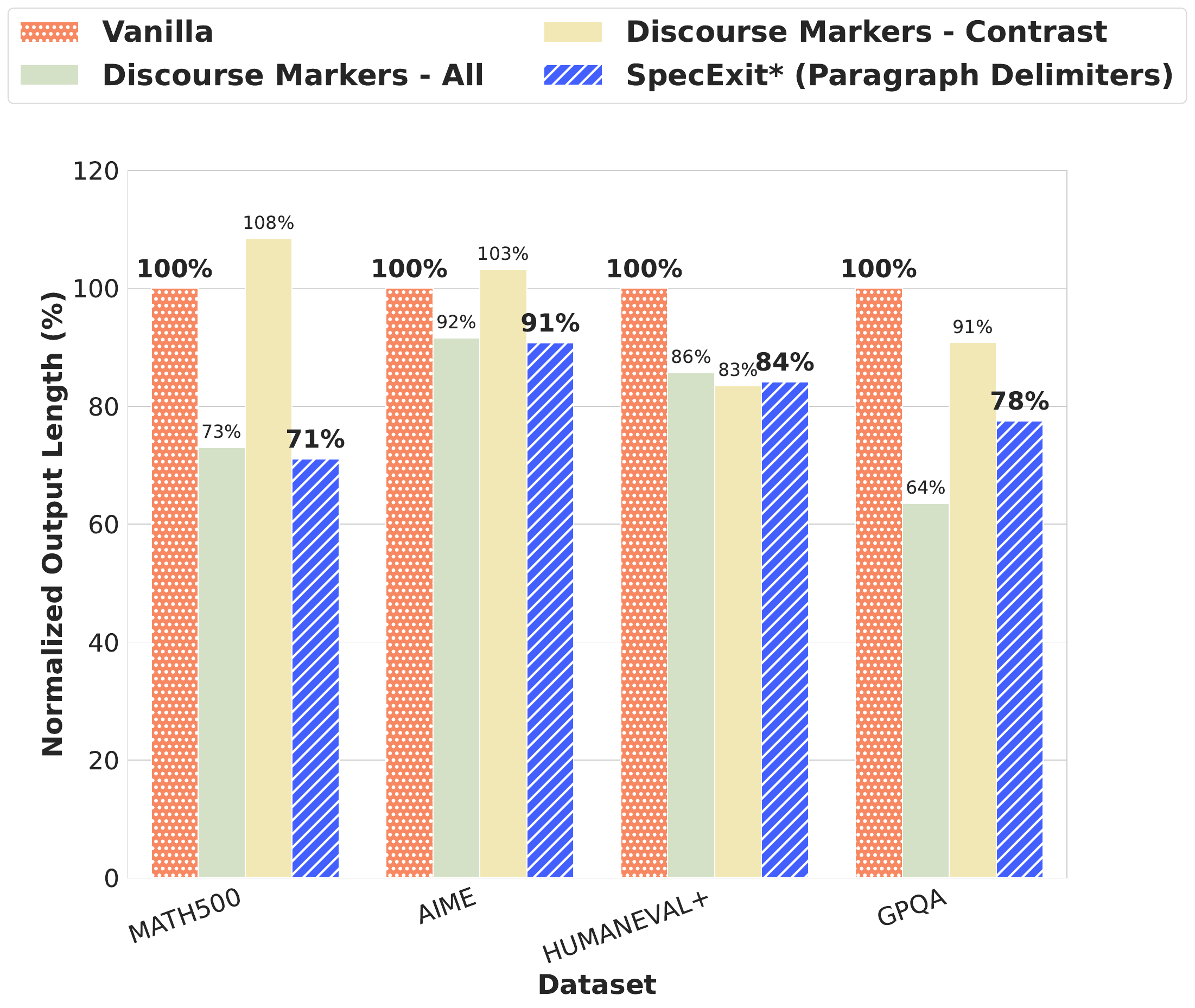

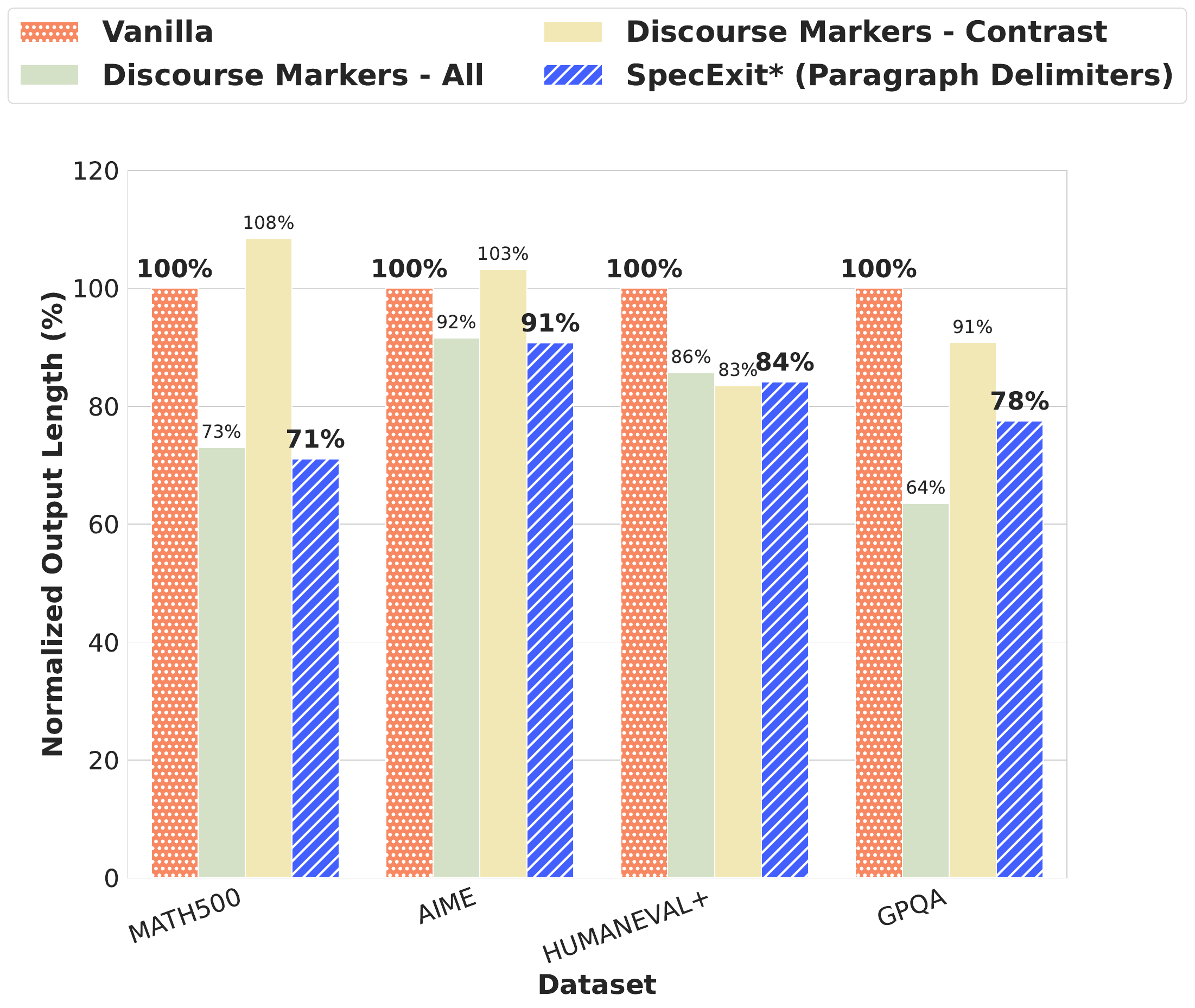

步骤分割Token:为评估不同步骤分割策略对早期退出性能的影响,进行了消融实验比较段落分隔符、一般话语标记和对比性话语标记子集。

图6a:步骤分割策略消融研究-准确率对比。展示了在Qwen3-4B-Thinking-2507上不同分割策略(话语标记-全部、话语标记-对比、段落分隔符)对各基准测试准确率的影响。

:::

图6b:步骤分割策略消融研究-输出长度对比。展示了不同分割策略对各基准测试输出token数量的影响。

:::

话语标记指示语义转换或推理转移,但依赖于底层数据和模型,限制了它们的通用性。在先前动态早期退出方法的工作中,对比性话语标记子集(如"Wait"、"But"、"Alternatively")常用于捕获推理相关的转换。相比之下,段落分隔符(\verb|\n\n|)提供更通用的分割,不依赖模型特定或数据集特定的模式。如图6所示,使用段落分隔符达到竞争性准确率和token减少,证明通用分割策略可以有效地用于早期退出决策,同时在推理轨迹中保持连贯性。

总之,关于信号类型、平滑策略和步骤分割方法的消融研究为改进早期退出决策提供了关键洞察。多信号集成在准确性和token效率之间达到最佳平衡,而适当的平滑方法稳定认知信号并增强早期退出的一致性。此外,使用通用分割策略如段落分隔符提高了早期退出系统在不同数据集上的通用性。这些发现强调了整体方法的重要性,其中互补策略联合提高效率和可靠性。

5 相关工作(Related Work)

高效推理:为缓解LRMs中不必要的CoT生成,先前工作探索了基于训练和推理时的策略。基于训练的方法通常通过强化学习使用长度敏感目标或监督微调在不同长度的推理轨迹上修改模型行为。虽然有效缩短输出,这些方法需要大量重训练成本,并可能扭曲模型的输出分布,引发关于可靠性和对未见任务的泛化担忧。推理时方法避免重训练,而是通过监控模型信号如logits或中间答案尝试动态停止推理。虽然这些方法证明早期停止可以在不降低准确率的情况下减少推理长度,但它们对探测的依赖引入了额外计算,通常强调token数量减少而非真正的端到端延迟提升。

推测解码和隐藏状态:推测解码是加速解码速度的广泛采用技术,其中轻量级草稿模型提出候选token,大型目标模型在单次传递中验证。近期方法利用隐藏状态预测多个未来token。除了推测解码,多项研究揭示了隐藏状态包含关于未来输出的更广泛信息,包括正确性、响应长度和推理路径。基于这一洞察,本文方法扩展推测解码,训练隐藏状态不仅预测未来token,还产生早期退出信号。

6 结论(Conclusion)

本文提出 SpecExit,一种推理感知的早期退出框架,利用模型隐藏状态的潜在信号动态终止LRMs中的推理过程。通过将辅助预测头连接到轻量级草稿模型,SpecExit在单次前向传播中同时预测未来token和早期退出信号,消除了先前方法所需的探测开销。跨多样化任务和模型的实验证明,SpecExit大幅减少推理长度66%,并在不损害准确率的情况下实现高达2.5倍的端到端延迟提升。该方法突显了隐藏状态作为高效推理信息信号的潜力,并为在实际场景中部署LRMs建立了实用路径。

四、论文简评

创新点

零探测开销的早期退出:首次将早期退出机制集成到推测解码框架中,利用隐藏状态预测早期退出信号,完全避免了传统方法需要的额外探测计算,实现了真正的端到端延迟降低。

多信号集成策略:提出从隐藏状态提取置信度、推理进度和剩余长度三种互补信号,通过多任务学习联合训练,多信号集成缓解了单一信号的偏差,实现了更可靠的早期停止决策。

信号平滑机制:引入EWMA平滑策略处理原始信号的波动性,确保终止决策基于一致趋势而非瞬态波动,显著提升了早期退出的稳定性和鲁棒性。

通用分割策略:采用段落分隔符而非任务特定的提示设计,避免了探测方法的通用性问题,使方法能够跨多样化任务和模型有效工作。

实用工程实现:在PyTorch和vLLM两个主流推理框架中实现,证明了方法的工程可行性和部署便利性,为实际应用提供了完整的解决方案。

局限性

信号阈值依赖经验设置:实验中使用的信号阈值(如置信度>0.8、进度>0.3等)需要经验调优,缺乏自适应的阈值确定机制,可能需要针对不同模型和数据集进行调整。

草稿模型训练成本:虽然避免了运行时探测开销,但训练草稿模型的额外预测头仍需要监督数据和多任务学习,增加了训练阶段的复杂度。

复杂问题上的表现差异:从信号可视化可以看出,在复杂问题(如AIME)上,推理进度信号在反思阶段波动较大,可能导致早期退出决策的不稳定性。

信号标签生成策略简单:当前使用的置信度、进度和剩余长度的标签生成策略较为简单(如进度基于已完成比例),可能未充分捕捉推理过程的深层语义特征。

对比性准确率下降:在某些基准上(如GSM8K,95.3→93.8),SpecExit的准确率略低于完整推理,虽然差异较小,但说明早期退出仍有潜在的准确性风险。

应用场景

实时推理服务部署:SpecExit的显著延迟降低(高达2.5倍加速)使其特别适合需要快速响应的在线推理服务,如智能客服、实时决策支持系统等。

边缘设备推理:通过大幅减少生成的token数量(66%),降低了计算资源消耗,适合在GPU资源有限的边缘设备上部署大推理模型。

大规模推理任务处理:对于需要处理海量推理请求的场景(如大规模考试批改、数据分析),端到端效率的提升可以显著降低整体成本和时间。

复杂问题解答系统:在数学、科学、编程等复杂领域,SpecExit能够在保持准确率的同时优化推理过程,适合构建高效的智能问题解答平台。

流式推理应用:方法支持动态的推理终止,可以集成到流式输出系统中,在达到充分推理时及时给出答案,提升用户体验。

可改进方向

自适应阈值学习:可以研究基于强化学习或自适应策略的阈值确定方法,使早期退出阈值能够根据问题难度和推理进度动态调整,避免手动调优。

更丰富的信号设计:除当前的三个信号外,可以探索提取更多推理相关的特征(如问题难度估计、推理路径质量评估等),提供更全面的早期退出决策依据。

强化学习优化:可以将早期退出决策建模为强化学习问题,通过奖励函数平衡准确率和效率,使模型自主学习最优的退出策略。

跨模型泛化研究:研究训练的信号预测头能否跨不同模型迁移,减少针对每个新模型重新训练草稿模型的需求,提升方法的可扩展性。

结合其他加速技术:SpecExit可以与量化、稀疏化等其他加速技术结合,进一步降低推理成本,探索多维度的效率优化。

信号可视化与解释性:开发信号的可视化工具,帮助理解模型推理过程中的决策依据,提升方法的解释性,便于调试和优化。

论文代码开源地址:https://github.com/Tencent/AngelSlim

附录图:话语标记分布。展示了Qwen3-4B-Thinking-2507在MATH500数据集响应中的话语标记分布,包括高频出现的转换词如"Wait"、"But"等。

:::

附录图1:简单问题的预测置信度信号可视化。展示了在MATH500示例上,预测置信度信号随推理步骤的变化,深色表示置信度低,浅色表示置信度高。

:::

附录图2:简单问题的预测进度信号可视化。展示了预测推理进度随推理步骤的变化。

:::

附录图3:简单问题的预测剩余长度信号可视化。展示了预测的剩余推理token数量随推理步骤的变化。

:::

附录图4:复杂问题的预测置信度信号可视化。展示了在AIME示例上,预测置信度信号随推理步骤的变化,可以观察到在反思阶段的波动。

:::

附录图5:复杂问题的预测进度信号可视化。展示了在复杂推理过程中进度信号的波动性。

:::

附录图6:复杂问题的预测剩余长度信号可视化。展示了复杂问题推理过程中剩余长度估计的变化。

:::

附录图7:案例研究。展示了一个GSM8K数据集的完整示例,说明SpecExit如何在完成第一个段落分析后插入退出决策,防止继续生成冗余推理token,在保持正确答案的同时实现更高效的推理。

:::