L-MTP: Leap Multi-Token Prediction Beyond Adjacent Context for Large Language Models

一、论文摘要

大型语言模型(LLMs)取得了显著进展。尽管取得了成功,但下一个词元预测(NTP)作为LLM训练和推理的主流方法,由于其固有的顺序处理特性,在上下文覆盖和推理效率方面都受到限制。为了克服这些挑战,我们提出了跳跃多词元预测(L-MTP),这是一种创新的词元预测方法,通过引入基于跳跃的机制来扩展多词元预测(MTP)的能力。与传统的MTP在不同位置生成多个词元不同,L-MTP战略性地跳过中间词元,在单次前向传播中预测非顺序的词元。这种结构化的跳跃不仅增强了模型捕获长距离依赖关系的能力,还实现了一种专门针对非顺序跳跃词元生成优化的解码策略,有效加速了推理过程。我们从理论上证明了L-MTP在提高推理效率方面的优势。在各种基准测试上的实验验证了其在提升LLM性能和推理速度方面的优越性。源代码可在 https://github.com/Xiaohao-Liu/L-MTP 获取。

二、基本信息

论文 ID: 2505.17505

标题: L-MTP: Leap Multi-Token Prediction Beyond Adjacent Context for Large Language Models

作者: Xiaohao Liu, Xiaobo Xia, Weixiang Zhao, Manyi Zhang, Xianzhi Yu, Xiu Su, Shuo Yang, See-Kiong Ng, Tat-Seng Chua

单位:

- 新加坡国立大学 (National University of Singapore)

- 哈尔滨工业大学 (Harbin Institute of Technology)

- 清华大学 (Tsinghua University)

- 中国科学院 (Chinese Academy of Sciences)

- 中南大学 (Central South University)

会议/期刊: NeurIPS 2025

原文保存位置: ~/.openclaw/workspace/papers/20260319_LMTP/source/

报告生成日期: 2025-03-19

三、论文主体分析

1. 引言 (Introduction)

大型语言模型(LLMs)在数据、计算和架构创新的推动下取得了快速而显著的进展。它们在获取世界知识方面展现出强大的能力,并在广泛的研究领域取得了突破,包括化学、生物学、医学和个性化等领域。

下一个词元预测(NTP)仍然是LLM训练和推理的主流策略。它以自回归方式生成词元,每个词元仅基于前面的上下文进行预测。然而,尽管NTP概念简单,但它导致了低效的生成,并限制模型处于聚焦但短的上下文视野中,同时忽略了"困难"的决策。有趣的是,LLM被验证具有内在的预规划能力,这表明将NTP扩展到同时预测多个词元是可行的。这促成了多词元预测(MTP)范式的出现。具体而言,通过加入额外的语言模型头,MTP使平行的连续词元序列预测成为可能,并带来两个关键好处。首先,它通过在每个步骤监督多个即将到来的词元提供了一个更广泛的训练信号,这可以增强需要长距离推理或规划的任务性能。其次,它通过在单次前向传播中生成多个词元来实现更快的推理,提高了在有效约束应用中的延迟和吞吐量。

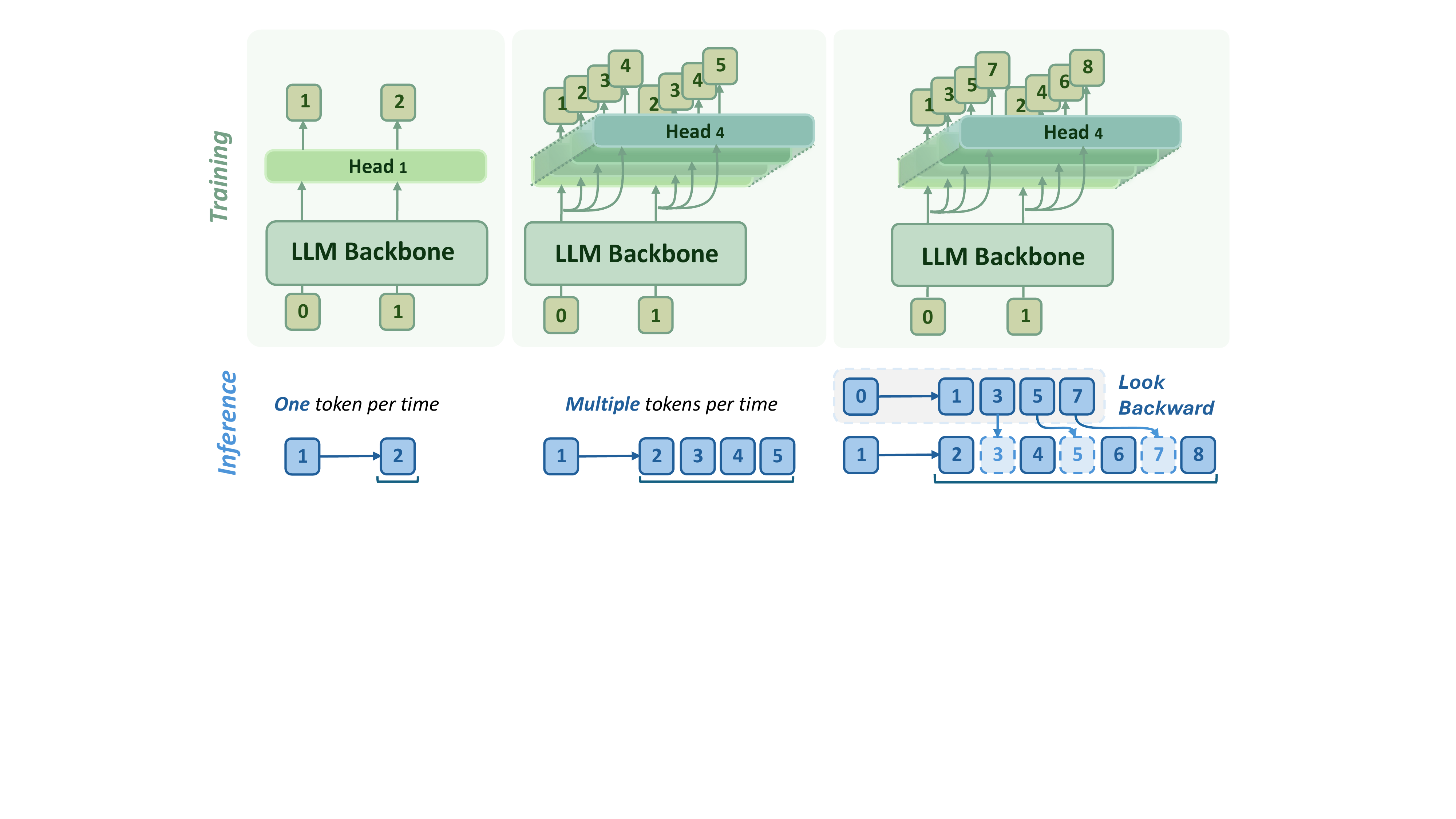

受更广更快的理念启发,我们扩展MTP范式并提出跳跃多词元预测(L-MTP),进一步放大LLM的上下文覆盖和推理效率。如图1所示,L-MTP引入了一种跳跃机制,跳过中间词元并直接预测非相邻的未来词元。在结构上,L-MTP保留了MTP的核心架构,多个预测头并行应用。然而,L-MTP不是针对连续位置,而是将每个头重新分配到跳跃间隔的位置(例如,位置1、3、5和7)。这提供了比MTP更广泛的训练信号,因为模型学习捕获超越相邻词元上下文的更长距离依赖关系。在推理过程中,L-MTP通过在解码步骤中重用重叠的上下文进一步提高了生成速度。通过联合预测多个战略性间隔的词元,L-MTP使每次前向传播每步生成更多词元,这有助于减少所需的解码迭代次数,从而实现比标准MTP更快的推理,同时保持生成输出的一致性。

图1(a):下一个词元预测(NTP)。NTP利用单个输出头进行顺序词元预测。

:::

图1(b):多词元预测(MTP)。MTP使用多个输出头进行相邻多词元预测。

:::

![图1(c):跳跃多词元预测(L-MTP)。作为比较,L-MTP将预测头重新分配到跳跃位置。例如,给定4个头,L-MTP预测位置[1,3,5,7]的词元,而不是MTP中步幅为2的相邻序列[1,2,3,4]。顶部展示了训练差异,而底部展示了推理过程。](images/Figure1_c.png)

图1(c):跳跃多词元预测(L-MTP)。作为比较,L-MTP将预测头重新分配到跳跃位置。例如,给定4个头,L-MTP预测位置[1,3,5,7]的词元,而不是MTP中步幅为2的相邻序列[1,2,3,4]。顶部展示了训练差异,而底部展示了推理过程。

:::

2. 预备知识 (Preliminaries)

本节详细阐述下一个词元预测(NTP)和多词元预测(MTP)的训练和推理程序。

NTP。 给定输入词元$\mathrm{x}_{\le t}$,下标$\le t$表示$\{1,2,\ldots,t\}$的缩写,具有参数$\theta$的LLM预测下一个词元$\mathrm{x}_{t+1}$,并通过以下目标进行优化:

$$\mathcal{L}_{\text{NTP}} = -\sum_{T}\log p(\mathrm{x}_{t+1}|\mathrm{x}_{\le t};\theta)$$其中$T$表示词元数量。推理中NTP的解码过程也遵循自回归方式,逐个生成词元。下一个词元从$p(\mathrm{x}_{t+1}|\mathrm{x}_{\le t};\theta)$中采样。

MTP。 NTP的自然扩展是MTP,它一次性预测多个词元。给定输入词元$\mathrm{x}_{\le t}$,具有参数$\bar{\theta}$的LLM通过涉及更多输出头(例如,总共4个输出头)来预测接下来的$n$个词元。因此,优化目标由公式推导为:

$$\mathcal{L}_{\text{MTP}} = -\sum_{T}\log p(\mathrm{x}_{[t+n, \dots, t+2, t+1]}|\mathrm{x}_{\le t};\bar{\theta})$$在这种情况下,LLM被要求预规划相邻上下文而不是单个下一个词元。对于MTP,在解码过程中,可以根据$p(\mathrm{x}_{t+i}|\mathrm{x}_{\le t};\bar{\theta}), i\in\{1,2,\dots, n\}$独立采样接下来的$n$个词元。最近的研究将LLM与LLM主干和输出头解耦,前者产生隐藏状态,后者将隐藏状态映射到词汇分布。因此,LLM主干可以配备多个头,根据共享隐藏状态独立预测词元。由此可得:

$$p(\mathrm{x}_{t+n,\dots, t+2, t+1}|\mathrm{x}_{\le t};\bar{\theta}) = \prod_{i=1}^n \Big(p(\mathrm{x}_{t+i}|\mathbf{z}_{\le t};{\theta^{i}})\cdot p(\mathbf{z}_{\le t}|\mathrm{x}_{\le t}; \theta')\Big)$$其中$\mathbf{z}$表示隐藏状态,$\theta'$表示LLM主干参数,$\theta^i$是第$i$个输出头的参数。词元预测后,MTP通常包含验证和接受子程序,以确定哪些词元有资格输出。验证子程序调用LLM并行评估预测,并记录它们的概率以确定接受。接受的词元将用于更新KV缓存,然后进入下一次迭代。这种解码被证明是一种无损的LLM加速技术,其中采样与 vanilla 自回归解码的分布一致。

图3:具有自推测解码的MTP,涉及三个子程序。

:::

3. L-MTP:跳跃多词元预测

概述。 尽管MTP具有潜力,我们用一个创新解决方案超越它,以实现更广泛的预测范围和更快的推理。与专注于连续词元的传统MTP不同,L-MTP引入了一种基于跳跃的策略,允许它在上下文窗口内预测非顺序位置。这种设计使模型能够有效地捕获长距离依赖关系,而无需密集的词元预测。在推理过程中,L-MTP在预测步骤之间重用部分重叠的上下文,最大限度地利用信息同时最小化冗余计算。给定输入词元$\mathrm{x}_{\le t}$,L-MTP旨在预测跳跃间隔的词元序列,具体为位置$\mathrm{x}_{[t+ k(n-1)+1, \dots,t+k+1, t+1]}$,其中$k$表示跳过的词元数量。例如,给定$t$个输入词元且$k=2$,模型预计预测位置$[t+1, t+3, t+5, \dots, t+2n-1]$的词元,在每个预测步骤中有效地跳过中间词元。

3.1 L-MTP训练方法

我们为LLM配备多个输出头以预测不同位置的词元。头是一个多层感知机(MLP),最后一层将隐藏状态转换为词汇(参见附录中的更多实现细节)。我们利用两个阶段来训练具有多个头的LLM:(1)头预热;(2)全模型调优。

头预热。 我们首先通过输入问题并收集未使用的LLM输出来构建自蒸馏数据。这些输出遵循LLM预测的原始分布。我们通过分配不同的监督来优化新头,遵循跳跃模式$\mathrm{x}_{t+k(n-1)+1}$。这个阶段的主要目的是使新头适应LLM。因此,原始头和LLM主干被冻结。训练目标公式为:

$$\mathcal{L}_{\text{L-MTP}}^{(1)} = -\sum_{T}\log p(\mathrm{x}_{[t+ k(n-1)+1, \dots,t+k+1]}|\mathbf{z}_{\le t}; \{\theta^i\}_{i>1})$$全模型调优。 之后,我们使用策划的数据继续训练模型。在这个阶段,我们专门化的LLM的所有组件,包括LLM主干和输出头,都被优化。优化目标定义为:

$$\mathcal{L}_{\text{L-MTP}}^{(2)} = -\sum_{T}\log p(\mathrm{x}_{t+1]}|\mathrm{x}_{\le t}; \theta',\theta^1) +\beta \cdot \log p(\mathrm{x}_{[t+ k(n-1)+1, \dots,t+k+1]}|\mathrm{x}_{\le t}; \theta',\{\theta^i\}_{i>1})$$其中$\beta$控制额外头的贡献。

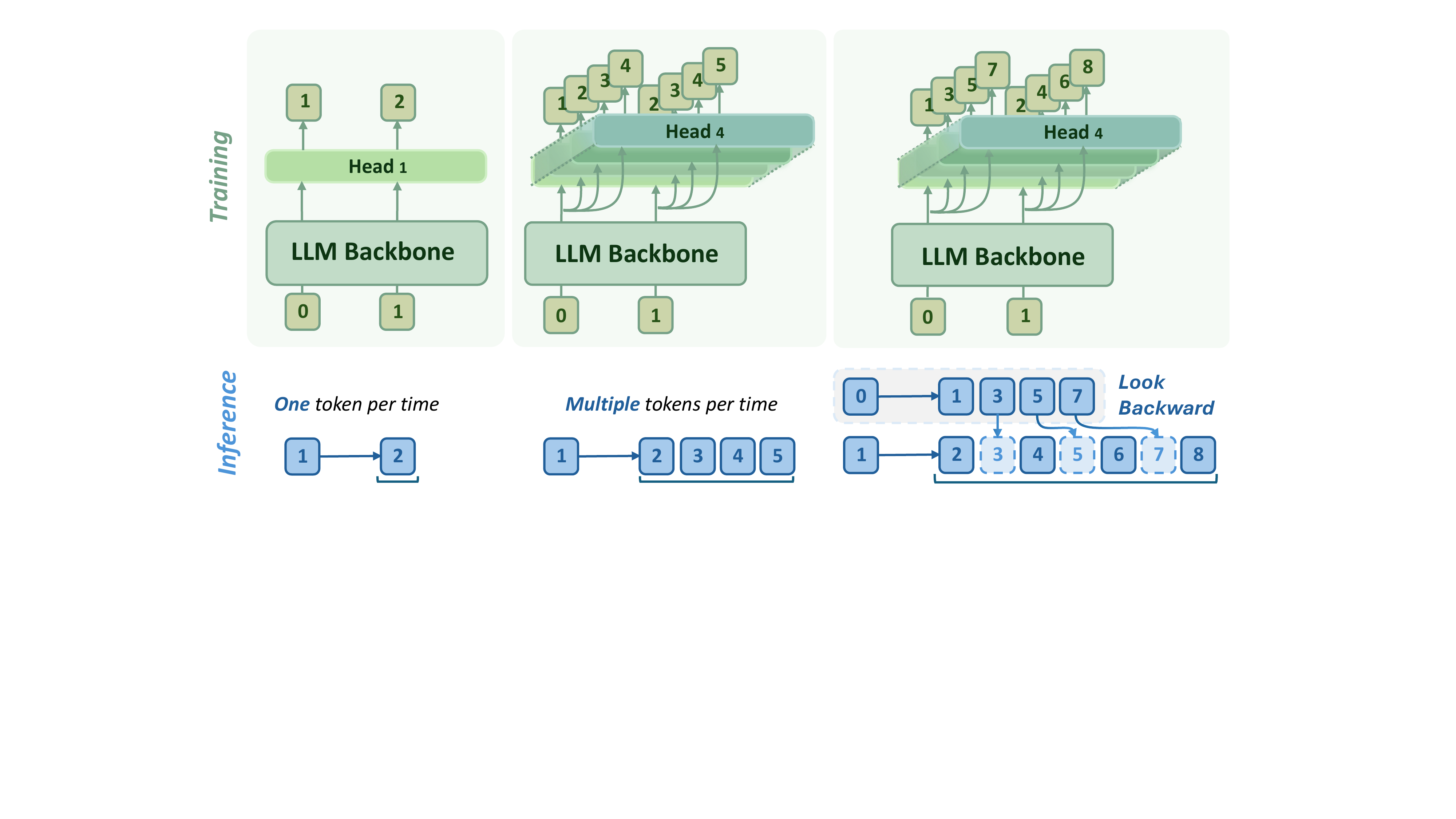

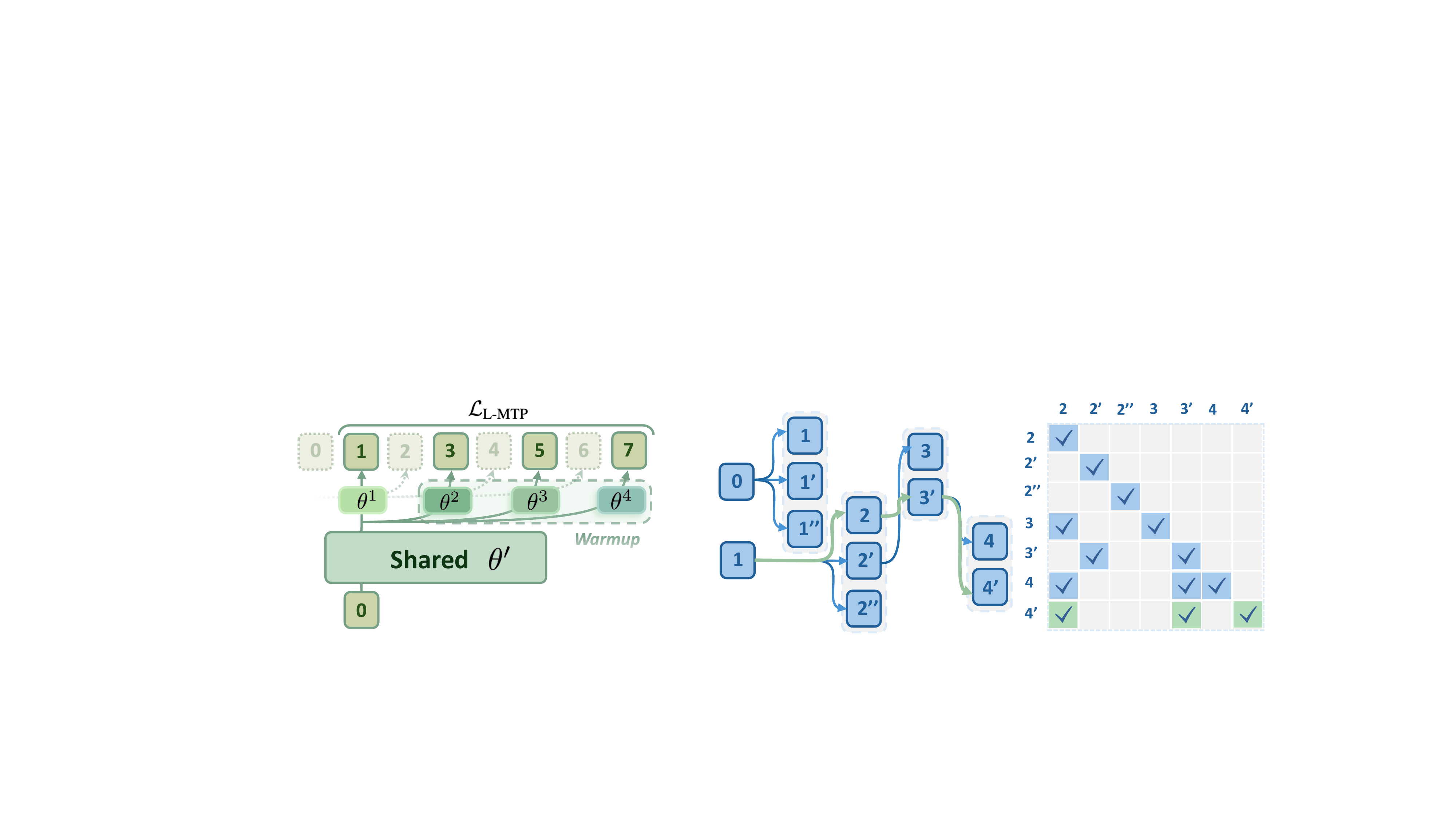

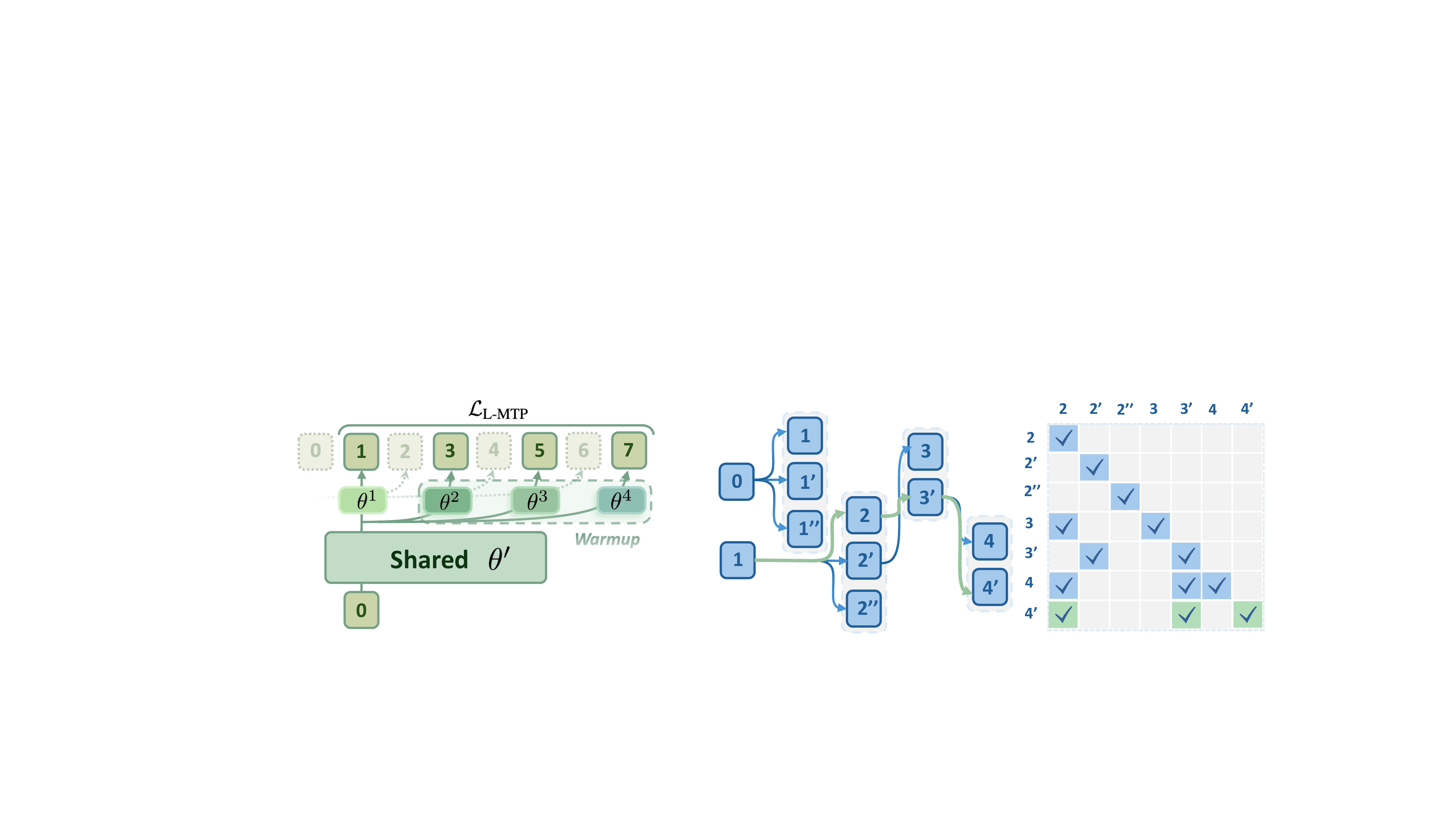

图2(a):L-MTP训练配方与目标$\mathcal{L}_{\text{L-MTP}}$。我们预热额外的头$\{\theta^i\}_{i>1}$,然后优化整个模型,以多个跳跃词元为监督。

:::

3.2 L-MTP推理程序

尽管L-MTP提供了更广泛的预测范围,但在每次传递中它只能预测一个不完整的序列。幸运的是,我们可以向后看以利用先前的预测,或者向前看以利用后验预测来弥补不完整性。此外,通过利用推测解码技术(即并行树解码),L-MTP可以实现更高的接受率,从而进一步加速推理。

向后看。 给定$\mathrm{x}_{\le t}$个词元,L-MTP预测词元$\{\mathrm{x}_{t+k(i-1)+1}\}_{i\in [n]}$,同时在它们之间留出空白(即,跳过$k-1$个词元)。然而,如果我们向后看,期望的词元已经被之前的步骤预测过了。例如,给定$\mathrm{x}_{\le t-1}$,词元$\{\mathrm{x}_{t+k(i-1)}\}_{i\in [n]}$已被预测。在这种情况下,我们有:

$$\Big\{\ p(\mathrm{x}_{t+i} | \mathrm{x}_{\le t - (i-1)\mod k}) | i\in \{1,2,\dots, k(n-1)+1\}\ \Big\}$$通过向后看(${\color{darkgreen}-}$)$k-1$步来采样连续的词元序列。这里的$\mod k$帮助切换条件。由于先验是事先生成(或并行生成),我们不需要再次推断,而是检索它们。

与树注意力结合。 L-MTP通过采样连续词元序列进行验证,无缝集成到推测解码中。受并行解码的启发,我们将L-MTP与树注意力结合以实现高效解码。我们构建一个分层树结构,其中第$i$层代表第$i$预测头生成的候选词元。树中的路径被探索以识别接受的词元。为了便于并行验证,我们设计了一个树注意力掩码,限制每个隐藏状态只关注其祖先。图2(b)展示了L-MTP解码与树注意力的实现。更多细节见附录。

图2(b):与树注意力的结合。我们同时取多个候选来构建树路径(左),从而探索接受的候选。我们的反向解码策略提供连续序列,可以通过精心设计的树注意力进行验证(右)。

:::

4. 理论分析

给定输入$\mathrm{x}_{\le t}$,LLM能够预测更远的未来词元,如$\mathrm{x}_{t+i}, i>1$。这促使了MTP的发展,其中未来词元可以从更远的先前词元预测,而不仅仅是最后一个词元。通过观察生成的多个词元的接受率,我们得出两个属性:

定义1(衰减)。 对于基于$\mathrm{x}_{\le t}$预测多个词元的语言模型,预测每个后续词元的边缘概率随着预测范围的增加而减小。形式上,$p(\mathrm{x}_{t+1} | \mathrm{x}_{\le t}) > p(\mathrm{x}_{t+2} | \mathrm{x}_{\le t}) > \cdots > p(\mathrm{x}_{t+n} | \mathrm{x}_{\le t}), \forall i \in \{1, 2, \ldots, n\}$,其中$n$是最大预测范围(头的数量),假设概率定义良好且非零。

备注。 衰减反映了语言模型在预测更远的未来词元时增加的不确定性。这种行为是因为$\mathrm{x}_{t+i}$的预测依赖于固定上下文$\mathrm{x}_{\le t}$,而这种影响随着$i$的增加而减弱。因此,模型以边缘概率$p(\mathrm{x}_{t+i} | \mathrm{x}_{\le t})$衡量的置信度单调下降。

假设1(一致性)。 预测$\mathrm{x}_{t+i}$的预期边缘概率在任意输入下是稳定的,并遵循预测范围$i$的可预测函数。形式上:$\mathbb{E}_{\mathrm{x}_{\le t} \sim \mathcal{D}} \left[ p(\mathrm{x}_{t+i} | \mathrm{x}_{\le t}) \right] = f(i), \forall i \in \{1, 2, \ldots, n\}$,其中$f(i)$是表征$\mathrm{x}_{t+i}$预期概率的函数。

备注。 一致性确保语言模型对未来词元$\mathrm{x}_{t+i}$的预测在期望中表现出稳定的统计行为,与输入序列$\mathrm{x}_{\le t}$的变化无关。函数$f(i)$封装了对第$i$个超前词元预测的预期置信度,根据衰减定义,$f(i)$可能随着$i$减小(即$f(i) > f(i+1)$)。

接受长度。 接受的词元的预期长度可以表示为$\mathbb{E}[L] = \sum_{m=1}^{n} p(L>m)$。根据不同的预测策略,我们有以下期望:

$$ \left\{ \begin{array}{rcl} \mathbb{E}[L] &=& \sum_{m=1}^{n} \Big( \prod_{i=1}^{m} \mathbb{E}_{\mathrm{x}_{\le t} \sim \mathcal{D}}[p(\mathrm{x}_{t+i} | \mathrm{x}_{\le t})] \Big) \quad \text{(Vanilla策略)} \\ \mathbb{E}[L]_l &=& \sum_{m=1}^{k(n-1)+1} \Big( \prod_{i=1}^{m} \mathbb{E}_{\mathrm{x}_{\le t} \sim \mathcal{D}}[p(\mathrm{x}_{t+i} | \mathrm{x}_{\le t - (i-1)\mod k})] \Big) \quad \text{(L-MTP策略)} \end{array} \right. $$其中vanilla策略使用$t$处的隐藏状态顺序预测词元$\mathrm{x}_{t+1}, \mathrm{x}_{t+2}, \dots, \mathrm{x}_{t+n}$。L-MTP预测两个交错序列。具体来说,L-MTP使用$t-1$处的隐藏状态来弥补未预测的词元。

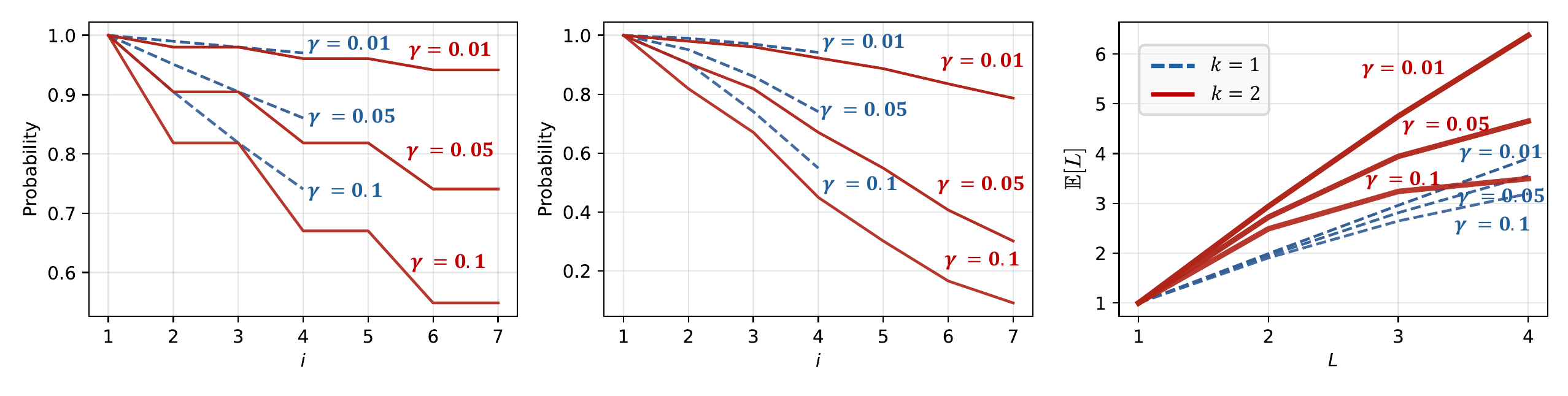

定理(更少衰减,更多加速)。 设$\gamma$表示衰减系数,$f(i):= \exp{[-\gamma\cdot (i-1)]}$是建模第$i$步预测置信度的概率衰减函数。那么存在一个常数$C > 0$,使得$\mathbb{E}[L]_l > \mathbb{E}[L]$渐近成立,只要$\gamma n^2 \le C$,即$\gamma = O(1/{n^2})$。

备注。 L-MTP引入更长的预测范围($k(n-1)+1$)来弥补跳跃位置上的置信度损失。定理揭示了衰减与预测头数量之间的关系。更少的衰减表明L-MTP相比vanilla策略有更高的加速。在实践中,$n$不会太大。较少的衰减($\gamma$)与较少的头开销($n$)导致更高的加速。我们提供了模拟曲线以更好地理解L-MTP的优越性。

图3:不同曲线分别展示了预期边缘概率(a)、联合概率(b)和接受长度(c),其中$k\in\{1,2\}$。跳跃策略将预测范围扩展到位置$i$,并实现了更高的预期长度。

:::

5. 实验

5.1 实验设置

基础LLM。 实验使用了以下基础大型语言模型:Qwen 2.5(3B和7B参数)、Llama 3.2(3B参数)、Llama 3.1(8B参数)和Gemma 3(4B和12B参数)。这些模型被选择以代表多样化的架构和参数规模,以进行全面评估。

基线。 为了比较功效,我们评估两种预测范式:下一个词元预测(NTP)和多词元预测(MTP)。这些范式评估模型在不同预测策略下生成准确且上下文相关的输出的能力。对于效率,我们使用具有自回归解码的NTP作为基础。我们将L-MTP与MTP(利用自推测解码)和一种平凡的前向解码方式进行比较,以分析推理效率。

数据集。 我们从Math、Evol-Instruct-Code和Alpaca-GPT4策划训练数据集。在第一阶段,我们使用完整数据进行自蒸馏。在第二阶段,我们随机选择10,000个样本,比例为4:4:2,分别对应数学、代码和通用数据。为了基准测试方法,我们选择Math500和GSM8K进行数学评估,MBPP、MBPP+、HumanEval和HumanEval+进行代码评估,以及MMLU和IFEval进行通用评估。

评估指标。 对于性能比较,我们对数学和通用任务使用准确率,对代码任务使用pass@1。对于效率分析,我们使用加速比作为指标,通过相对于原始的每秒生成词元数计算。数值越高表示性能越好。

实现细节。 为了使L-MTP适应基于NTP的方法,我们采用两阶段训练程序。在头预热阶段,我们冻结LLM主干,同时以1×10^-3的学习率训练头5个周期。我们使用余弦调度器,并将warmup比率设置为0.1。在下一阶段,我们使用LoRA(rank为32,alpha为16)来调整完整模型。在这里,我们仅以1×10^-5的学习率训练模型3个周期。默认情况下,我们设置$k=2$和$n=4$。此训练设置也用于MTP实现以确保公平性。

5.2 结果与讨论

整体性能(RQ1)。 为了回答RQ1,我们跨不同数据集比较L-MTP与MTP和NTP,并使用一系列基础模型作为主干。通过比较,我们可以观察到L-MTP为不同规模和系列的模型带来的改进,特别是在Llama和Gemma系列的数学任务以及Qwen系列的代码任务上。此外,我们发现所有模型在通用任务上都有所改进,例如IFEval。值得注意的是,L-MTP在大多数任务上比MTP获得更好的性能。有趣的是,我们观察到即使NTP在某些情况下也会带来更差的结果。虽然L-MTP可以弥补这一差距,但恶化仍然无法缓解。仔细选择更高质量的数据将是有益的。然而,在本文中,我们不关注如何选择数据,而是研究L-MTP与MTP相比的效果。

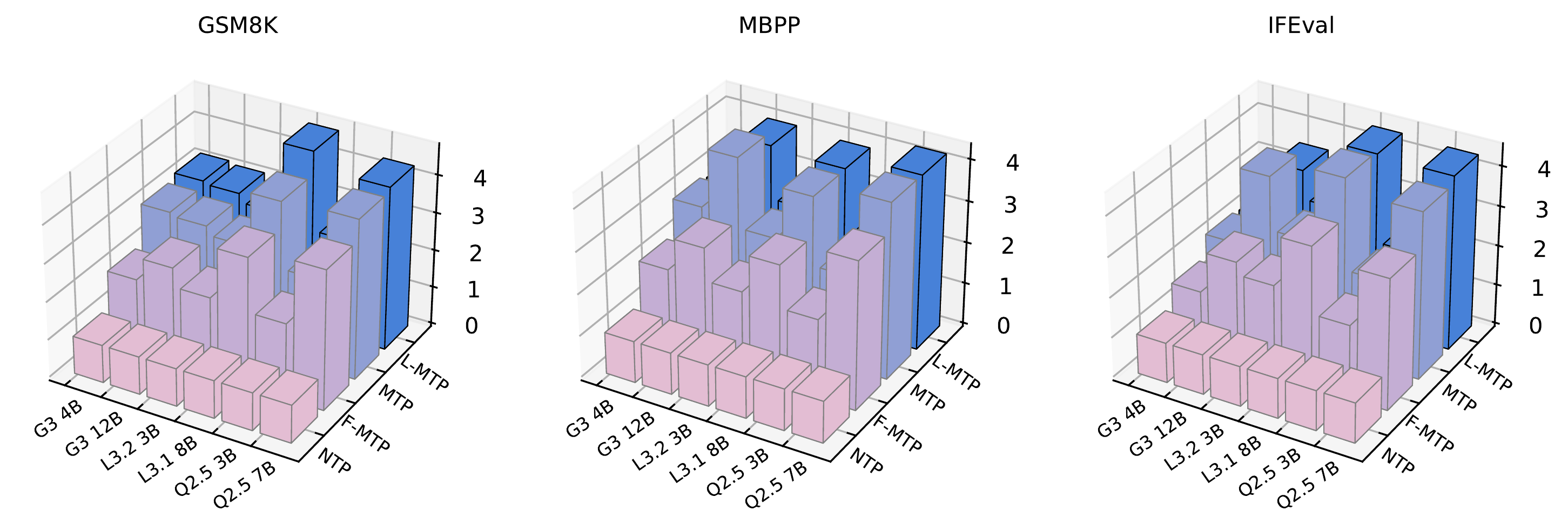

推理加速(RQ2)。 L-MTP通过向后看来实现解码,以在没有任何架构修改或复杂操作的情况下实现推理加速。我们提供如图4所示的推理加速比较。我们还实现了一种针对跳跃预测的平凡解决方案,通过向前看,记为F-MTP。我们在GSM8K上,L-MTP实现了与MTP相当但有时更高的加速,特别是在GSM8K上。L-MTP预测更远的位置,同时留下空白由之前的预测填充,从而实现更快的推理。

图4:不同系列LLM自推测解码的加速("G"代表Gemma,"L"代表Llama,"Q"代表Qwen)。Z轴代表加速比。

:::

我们还探索了将L-MTP解码扩展到现有模型的潜力,如Medusa,专门用于提高多头的接受率。我们用L-MTP解码为这些模型配备设备,并在表1中展示结果。将解码策略直接更改为跳跃范式可带来高达1.3倍的加速(22%的相对提升)。这些结果表明L-MTP的潜力,特别是对于具有更高接受率的模型。

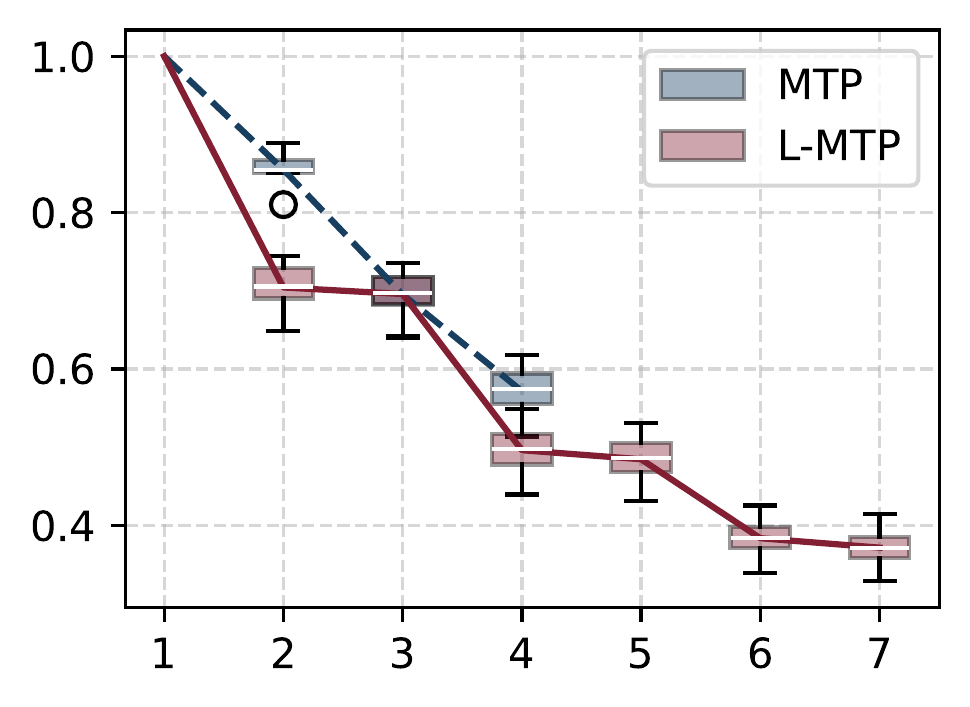

每个位置的预期分布(RQ3)。 我们计算每个位置的预测准确性,以验证我们在理论分析中的实际结果。我们在图5中绘制了不同模型(箱线图)在每个位置的不同准确性,并显示MTP和L-MTP在每个位置的平均准确性(线)。这些实际结果表现出衰减和一致性属性,类似于我们的模拟图,为我们的理论分析提供了有力支持。

图5:不同位置预测准确性,在alpaca-eval分割上估计。

:::

图6:不同模型的预测准确性。近视程度随着规模增加而恶化。

:::

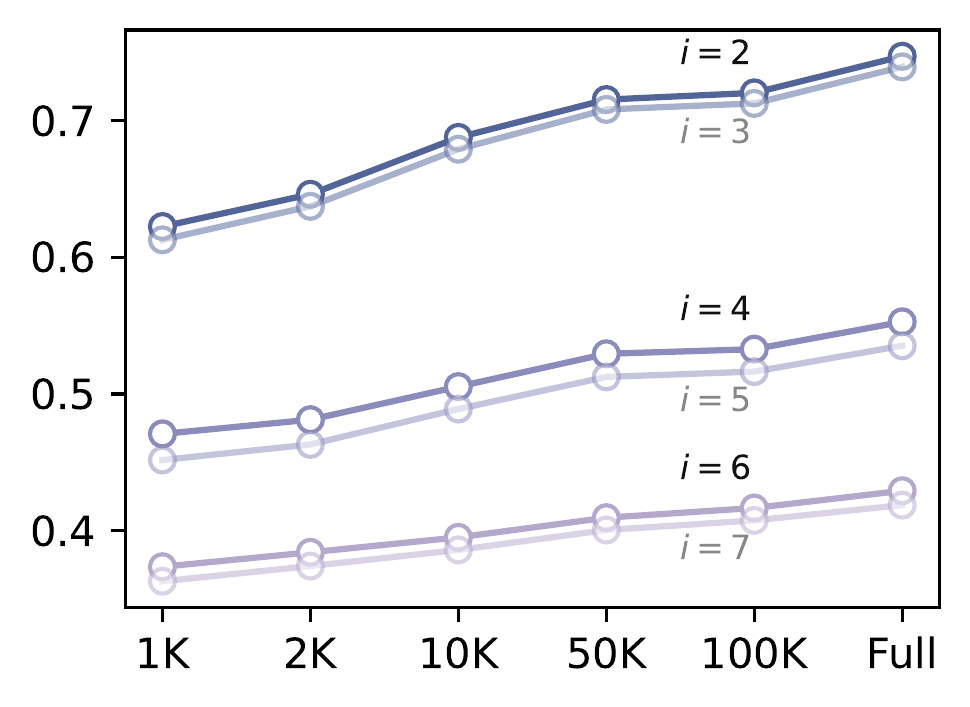

图7:预测准确性随着训练数据增加而提高(从1K到完整)。

:::

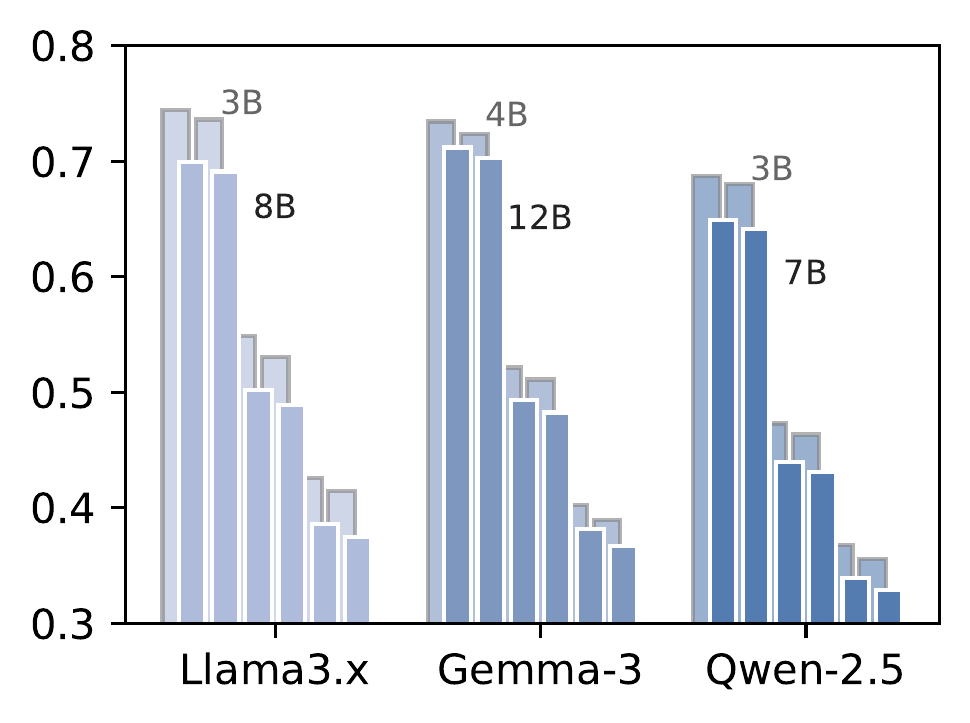

潜力分析(RQ4)。 我们通过研究LLM的近视和数据量的影响来强调L-MTP的潜力。(1)近视生成。我们展示了跨不同规模模型的预测准确性,如图6所示。对于所有系列的LLM,当从小模型切换到大模型时,准确性持续下降,表明NTP预训练固有的近视。最近的工作建议从头开始用MTP目标训练LLM。用L-MTP从头训练也很有希望使模型具有更广泛的预测范围和更快的推理。(2)数据规模。我们展示了在头预热阶段添加更多数据时预测准确性的提高,如 图7所示。大规模数据引入更多多样性,以帮助额外的头适应LLM主干。然而,我们也观察到增长并非线性的。为L-MTP配备更复杂的训练技术或模型架构也将很有前景。

四、论文简评

创新点

跳跃预测机制:L-MTP提出了一种创新的跳跃多词元预测方法,通过跳过中间词元来预测非顺序位置,这比传统的MTP(预测相邻词元)能够捕获更长距离的依赖关系。

理论分析:论文提供了严谨的理论分析,证明了L-MTP相比vanilla策略在推理加速方面的优势,并推导出衰减系数与预测头数量之间的关系。

向后看解码策略:提出了一种新颖的向后看解码策略,通过利用之前步骤已经预测的词元来填补跳跃留下的空白,实现了更高效的推理。

树注意力集成:L-MTP可以与推测解码技术(如并行树解码)无缝结合,进一步提高推理接受率。

局限性

性能波动:在某些模型和任务上,L-MTP的性能提升并不稳定,有时甚至不如NTP基线,表明该方法可能对特定模型架构或数据分布更敏感。

超参数选择:$k$(跳跃步长)和$n$(预测头数量)的最佳值需要手动设置,自适应选择机制尚未完全解决。

训练复杂性:两阶段训练流程(头预热+全模型调优)增加了训练时间和复杂度。

应用场景

需要长程推理的任务:L-MTP特别有利于需要捕获长距离依赖的数学和代码推理任务。

延迟敏感的推理应用:通过加速推理,L-MTP适用于需要快速响应的生产部署场景。

与现有加速技术结合:L-MTP可以与Medusa等现有推理加速方法结合,进一步提升性能。

可改进方向

自适应跳跃机制:根据预测词元的局部不确定性或熵自适应地选择$k$和$n$,允许模型在低熵区域更激进地跳跃,而在更模糊的上下文中保持更细的粒度。

强化学习微调:将L-MTP与强化微调框架结合,可能为训练LLM开辟令人兴奋的机会。

从头训练:与在预训练后添加预测头不同,从头开始用L-MTP目标训练可能从根本上改善模型的预规划能力。

更复杂的架构:探索更复杂的预测头架构(如Hydra架构)或更先进的训练技术可能进一步提高性能。