论文分析报告

一、论文摘要(必须)

Transformer 架构的大型语言模型(LLM)在推理过程中将上下文缓存为键值(KV)对。随着上下文长度增加,KV 缓存大小急剧膨胀,导致显著的内存开销和注意力延迟增加。本论文提出了 KVzip,一种查询无关的 KV 缓存驱逐方法,能够在多样化的查询中有效复用压缩后的 KV 缓存。KVzip 利用底层 LLM 从缓存的 KV 对中重建原始上下文来量化其重要性,随后驱逐重要性较低的 KV 对。大量实证评估表明,KVzip 能够将 KV 缓存大小减少 3 至 4 倍,将 FlashAttention 解码延迟降低约 2 倍,同时在问答、检索、推理和代码理解任务中保持几乎无损的性能。评估涵盖 LLaMA3.1、Qwen2.5 和 Gemma3 等多种模型,上下文长度最长可达 170K tokens。KVzip 显著优于现有的查询感知 KV 驱逐方法,这些方法在多查询场景下即使在 90% 缓存预算比率下也会出现性能下降。

二、基本信息

| 项目 | 内容 |

|---|---|

| 论文 ID | 2505.23416 |

| 标题 | KVzip: Query-Agnostic KV Cache Compression with Context Reconstruction |

| 作者 | Jang-Hyun Kim, Jinuk Kim, Sangwoo Kwon, Jae W. Lee, Sangdoo Yun, Hyun Oh Song |

| 单位 | Seoul National University, Neural Processing Research Center, NAVER AI Lab |

| 会议/期刊 | NeurIPS 2025 |

| 原文保存位置 | ~/.openclaw/workspace/papers/20260319_KVzip/source/ |

| 报告生成日期 | 2026-03-19 |

三、论文主体分析

1 引言

Transformer 架构的 LLM 在长上下文能力方面取得了显著进步,极大地增强了现实世界的应用,包括长文档分析和个性化对话智能体。然而,上下文长度的增加大幅提高了 KV 缓存的内存消耗和注意力机制的计算成本。例如,在 Qwen2.5-14B 中缓存 120K tokens(使用 FP16 精度)需要约 33 GB 内存,超过了同等精度下模型 28 GB 的参数存储。

现有方法主要针对在保持推理精度的同时减少 KV 缓存内存大小,包括:合并注意力头、将 KV 对压缩成更短的序列、使用滑动窗口技术限制上下文窗口。其他研究则利用注意力稀疏性在解码和预填充阶段进行动态 KV 驱逐。现有的驱逐方法通常采用查询感知的 KV 对重要性评分方法,在推理期间在线计算,保留与当前查询最相关的 KV 对。虽然在单查询场景下效果显著,但这些方法在多查询设置下表现出显著的性能下降,因为保留的 KV 对主要过度拟合初始查询。

在本文中,我们介绍了 KVzip,这是一种新型的查询无关(query-agnostic)KV 缓存驱逐算法。KVzip 优化了给定上下文的可复用压缩 KV 缓存,使不同未来查询的推理都能高效进行。

KVzip 的方法特别有利于离线准备 KV 缓存的场景,例如保留用户指令和聊天历史的个性化对话智能体,或使用预计算文档 KV 缓存进行检索的企业系统。

设计有效的查询无关驱逐策略具有挑战性,因为对未来查询存在不确定性。本研究证明了对重建原始上下文至关重要的简洁 KV 对集合可以作为有效的压缩表示。KVzip 利用的洞察是:Transformer 自然地作为编码器-解码器架构运行,将上下文编码到 KV 对中,类似于 Zip 等传统压缩方法。具体而言,我们的方法通过 LLM 前向传递模拟上下文重建,根据 KV 对在此过程中收到的最大注意力分数分配重要性分数。

实验表明,KVzip 在 FlashAttention 解码中实现约 2 倍的延迟减少,KV 缓存大小减少 3-4 倍,在多样化查询上性能损失可忽略不计。KVzip 支持上下文依赖驱逐(达到更高压缩比但产生每上下文压缩开销)和上下文无关驱逐(在部署后无开销但达到中等压缩比)。

实验证明了 KVzip 在多个基准测试上的鲁棒性和有效性,包括文档问答、数学推理、检索和代码理解任务,上下文长度最长可达 170K tokens。与现有驱逐方法(即使在 10% KV 驱逐下也表现出显著性能下降)不同,KVzip 即使在驱逐高达 70% 的 KV 缓存时也能保持一致的推理精度。实验涵盖 12 个基准数据集,包括 SQuAD、GSM8K 和 SCBench,涉及 LLaMA3.1、Qwen2.5 和 Gemma3 等多种模型,参数量从 3B 到 14B 不等。此外,KVzip 可与 KV 缓存量化、头级别 KV 驱逐等现有优化无缝集成。

图 1:多查询场景下 KV 驱逐策略概览。LLM 处理输入上下文(CTX)和查询 Qi 来生成答案 Ai。现有方法(如 SnapKV 和 PyramidKV)基于即时查询信息驱逐上下文 KV 对。(a) 查询感知 KV 驱逐对每个查询独立执行预填充和驱逐,产生重复的预填充开销。(b) 重用查询依赖的压缩缓存会导致后续查询的性能下降。(c) 提出的查询无关 KV 驱逐框架在初始预填充期间仅压缩 KV 缓存一次,使跨不同查询的高效复用成为可能,无需重复预填充或性能损失。

:::

2 预备知识

2.1 符号表示与问题形式化

令文本域为 $\mathcal{T}$,自回归 Transformer 架构的 LLM 为 $\lm: \mathcal{T} \rightarrow \mathcal{T}$,通过贪心解码生成序列。模型由 $L$ 层组成,采用分组查询注意力(GQA),具有 $H$ 个 KV 头,每个头由 $G$ 个查询头组成的组进行服务。推理期间,$\lm$ 将隐藏表示缓存为 KV 对以提高计算效率。

给定一个被标记为 $n_c$ 个 tokens 的输入上下文 $c$,预填充阶段生成一个包含 $L \times H \times n_c$ 个 KV 对的缓存,记为 $\kvc$。使用缓存的条件生成表示为 $\lm(\cdot \mid \kvc)$。我们的目标是从中导出一个紧凑的剪枝缓存 $\kvp \subseteq \kvc$,满足:

$$\lm(q \mid \kvp) \approx \lm(q \mid \kvc),\ \forall q \in \mathcal{T}.$$2.2 现有方法分析

现有的 KV 驱逐方法(如 SnapKV 和 PyramidKV)基于预填充期间给出的信息压缩 KV 缓存。这些方法利用尾部上下文窗口中的查询计算 KV 对的基于注意力的重要性分数,选择性地保留与这些查询相关的 KV 对。虽然在单查询基准测试(如大海捞针和 LongBench)上效果显著,但这些方法需要为每个新查询重复预填充缓存。

替代方案是重用一个预先压缩的 KV 缓存来处理后续查询,这样可以减少计算开销。然而,现有方法通常只保留与初始查询相关的上下文 KV 对,不能泛化到不同的查询。

图 2:使用 LLaMA3.1-8B 在 SQuAD 上的准确性。我们评估 SnapKV 对每个查询的重复预填充、重用第一个问题压缩缓存,以及 KVzip 单次预填充和查询无关压缩。

:::

3 方法

3.1 直观理解

为了有效回答任意查询,压缩缓存 $\kvp$ 和 $\lm$ 应保留完整的上下文信息。我们的直觉是我们可以通过明确提示 $\lm$ 从 $\kvp$ 重建先前的上下文来验证这种完整性。如果 $\kvp$ 使 $\lm$ 能够使用重复提示准确重建原始上下文 $c$,我们可以重新预填充原始缓存 $\kvc$ 并进行准确的推理。

然而,在每次推理时重新生成原始缓存仍然不切实际。令人鼓舞的是,我们的实证研究表明,即使不重建原始缓存,压缩缓存也表现出强大的泛化能力。这一发现与基于重建的自监督学习原则产生共鸣,表明在多样化的下游任务中具有强大的泛化能力。

图 3:Transformer LLM 视为上下文编码器-解码器。每个矩阵单元格表示一个 KV 对。我们使用提示"Repeat the previous context:"。

:::

3.2 KV 重要性评分

KVzip 基于 KV 对在上下文重建中的贡献来量化其重要性。具体而言,我们通过教师强制解码模拟重建,通过包含重复提示和原始上下文的前向传递并行化。我们定义重要性分数为每个 KV 对在此前向传递期间收到的最大注意力分数,利用洞察:收到最小注意力的 KV 对对 Transformer 计算贡献很小。

形式上,给定长度为 $n_c$ 的上下文,我们通过连接长度为 $n_\text{prompt}$ 的重复提示和上下文来构建长度为 $n_\text{in} = n_\text{prompt} + n_c$ 的输入序列。通过 $\lm$ 前向传递生成 $d$ 维分组查询特征 $Q_{l,h}\in \R^{G\times n_\text{in}\times d}$ 和键特征 $K_{l,h}\in \R^{(n_c + n_\text{in})\times d}$。分组注意力产生注意力矩阵 $A_{l,h}= \text{Softmax}(Q_{l,h}K_{l,h}^\intercal)\in \mathbb{R}_+^{G \times n_\text{in} \times (n_c + n_\text{in})}$。提取对应于 $\kvc$ 中键的条目得到切片的注意力矩阵 $\bar{A}_{l,h} \in \mathbb{R}_+^{G \times n_\text{in} \times n_c}$。最后,我们通过取分组查询的最大值来计算 $h$ 个 KV 头在第 $l$ 层的重要性分数 $S_{l,h} \in \mathbb{R}^{n_c}$:

$$S_{l,h} = \max_{g =1,\ldots,G;\ i = 1,\ldots,n_\text{in}} \bar{A}_{l,h}[g,i].$$我们称跨所有 KV 头聚合的分数 $S$ 为最大交叉注意力分数。

3.3 观察

重建过程中从重复上下文到预填充上下文的交叉注意力模式表现出显著的稀疏性,表明压缩 $\kvc$ 有很大的机会。此外,重建过程中的注意力模式与来自不同任务的注意力模式显著重叠。这种重叠意味着对上下文重建至关重要的 KV 特征对下游任务也有重要贡献,突出了强大的泛化能力。

重建中的注意力稀疏性。 在预填充期间,模型密集交互以编码全面的上下文信息。然而,在重建中,模型有效地利用存储在 $\kvc$ 中的高级表示和模型权重中的内部知识,从而减少不必要的注意力查找。这种交叉注意力稀疏性有效地识别和移除冗余 KV 对,优于依赖预填充期间注意力分数的先前方法。

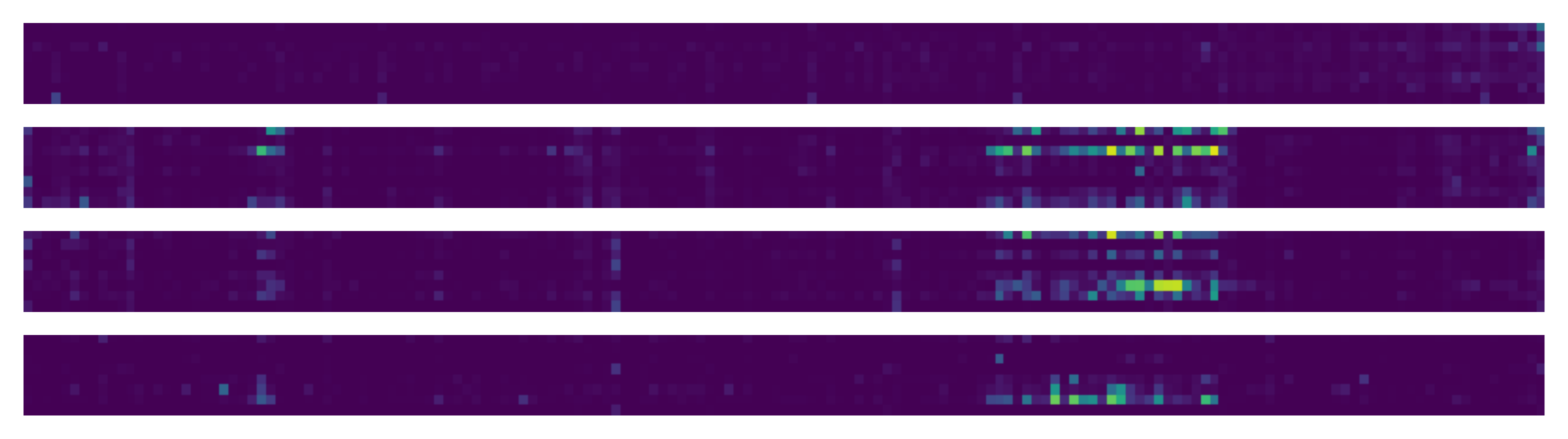

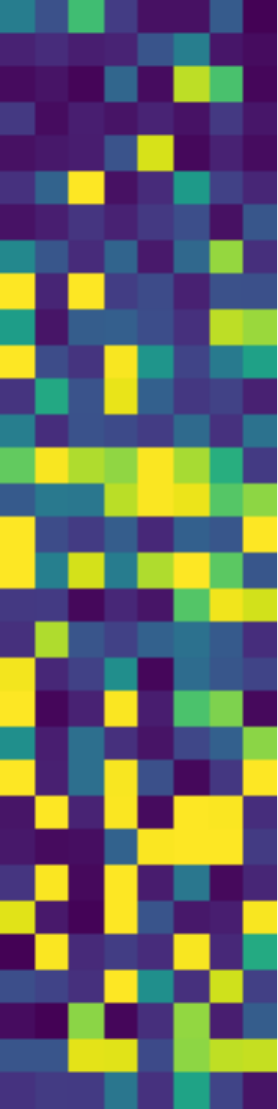

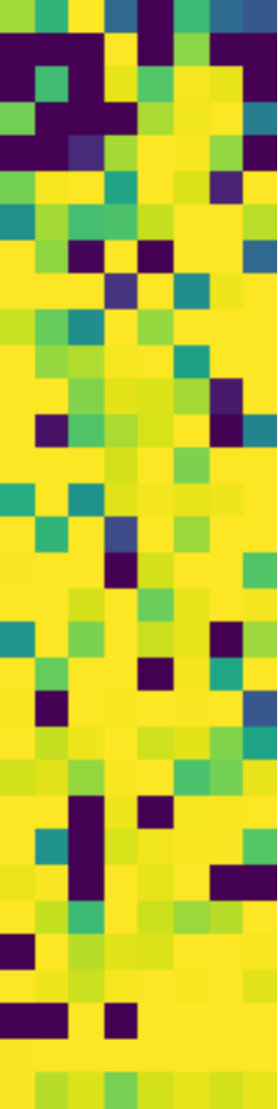

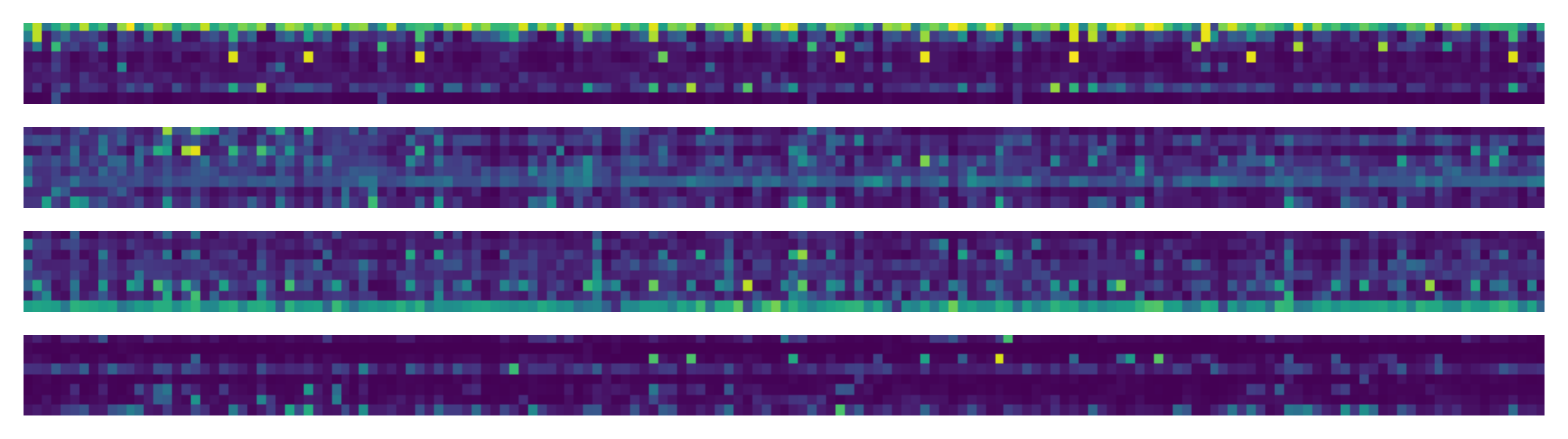

图 4:不同任务间注意力比较的 2D 直方图。可视化了 KV 对在两种不同评分输入下收到的最大交叉注意力分数的联合分布。

任务间的注意力重叠。 重建关键的 KV 对一致地贡献于多样化的任务,支持 KVzip 的有效性。我们在各任务间验证了这种泛化能力。

3.4 技术挑战与解决方案

我们的方法将重复提示与上下文标记连接起来,通过 $\lm$ 处理以获取注意力矩阵。然而,注意力矩阵随上下文长度 $n_c$ 二次方缩放,使得直接计算对于长上下文来说不可行。

分块评分。 为了解决这一挑战,我们引入了基于分块的评分,独立重建上下文段。通过固定大小的块计算重要性分数,计算复杂度从二次方 $O(n_c^2)$ 降低到线性 $O(m n_c)$,其中 $m$ 是块大小。具体而言,我们将上下文标记划分为固定长度 $m$ 的块,将每个块与重复提示连接,并处理长度为 $n_\text{in} = n_\text{prompt} + m$ 的输入。对于每个 Transformer 层,我们对 $\kvc$ 中与每个块对应的键进行下采样,获得大小为 $n_\text{in} \times (m + n_\text{in})$ 的较小注意力矩阵。

图 5:分块评分示意图

复杂度分析。 每块的计算复杂度为 $O(m^2)$,假设重复提示长度可忽略,$n_\text{in}\approx m$。对所有 $n_c/m$ 块重复此计算,总复杂度为 $O(m n_c)$,与上下文长度线性相关。峰值内存开销为 $O(m^2)$,与 $n_c$ 无关,与模型参数和 KV 缓存大小相比可以忽略不计。

实证效率分析。 在 NVIDIA A100 GPU 上的实证评估确认了在压缩期间计算开销约为标准预填充的两倍,额外内存很小(低于 2%)。重要的是,压缩每个上下文或每个模型只发生一次。

4 实验

4.1 设置

驱逐结构。 我们采用非均匀头预算分配策略进行 KV 驱逐,保留跨所有注意力头的重要性分数最高的 $r\%$ 个 KV 对,其中 $r\%$ 是目标压缩比。初始系统提示的 KV 对保持完整。

评估。 我们的评估重点是 KV 缓存有效处理多样化查询的能力。我们采用查询无关框架,具体而言,我们独立预填充和压缩上下文 KV 缓存,而不涉及任务查询。

基准、数据集和模型。 我们与最先进的 KV 缓存驱逐方法进行基准测试,包括 $\text{H}_2\text{O}$、SnapKV 和 PyramidKV。我们还比较了 DuoAttention 使用头级别驱逐进行上下文无关压缩。评估涵盖多样化的数据集:SQuAD、GSM8K、大海捞针(NIAH)和 SCBench 的九个任务。

我们使用各种指令微调的 LLM 进行评估,包括 Qwen2.5-7B-1M、LLaMA3.1-8B 和 Gemma3-12B。

4.2 基准测试

任务泛化。 图 6 展示了 Qwen2.5-7B-1M 在 12 个基准数据集上的多查询评估结果,分为三类。第一行包括检索密集型任务,我们的方法显著优于基准,在 30% 缓存比下保持性能。第二行包含上下文理解任务,包括数学推理。我们的方法在 20-30% 下实现近乎无损的压缩,始终优于基准。

图 6:基准测试结果

模型规模和架构。 图 7 展示了跨更大模型、不同模型系列和混合注意力架构的性能。Gemma 采用全局和滑动窗口注意力层按 1:5 的比例组合。我们仅对全局注意力层应用 KV 驱逐。结果确认 KVzip 在各种模型上具有泛化性和卓越的压缩性能。

KV 量化。 KVzip 有效地与 KV 缓存量化集成,进一步减少缓存大小。结果确认 KVzip 在量化下保持稳健。

上下文无关驱逐。 KVzip 还支持上下文无关驱逐策略,每个模型只需要一次重要性评分,部署后无压缩开销。具体而言,我们通过聚合成对分数(沿序列维度取最大值)分配静态头级别重要性分数。

图 7:模型性能比较

4.3 分析

上下文重建的必要性。 KVzip 使用连接重复提示和上下文的输入进行重要性评分。实验证明了完整上下文重建的必要性。

任务解决之外的行为分析。 进一步分析揭示了源自 KV 驱逐的与隐私相关的有趣行为。比较了在使用完整 KV 缓存和使用 KVzip 40% 压缩缓存时,隐私相关示例的生成结果。

5 相关工作与结论

相关工作

KV 缓存压缩。 压缩 Transformer 模型的 KV 缓存对高效推理至关重要。稀疏 Transformer 方法明确训练模型使用稀疏或本地化的 KV 缓存。压缩 Transformer 方法进一步通过在训练期间合并 KV 对来压缩缓存。已有研究表明 Transformer 驱动的 LLM 在推理期间表现出上下文稀疏性,催生了动态 KV 驱逐方法。

高效 LLM 推理。 另一条研究路线通过使用稀疏注意力机制而不是直接压缩 KV 缓存来提高推理效率。

结论

我们引入了 KVzip,这是一种查询无关的 KV 缓存驱逐算法,通过从 KV 对重建原始上下文来有效优化可复用的压缩 KV 缓存。通过在多样化的任务、模型和长上下文基准测试上对多查询设置进行广泛评估,KVzip 展示了强大的压缩性能,在性能损失可忽略的情况下将 KV 缓存大小减少高达 70%,同时在使用 FlashAttention 时将解码注意力延迟提高约 2 倍。KVzip 始终优于现有的 KV 驱逐方法,这些方法在 10% 驱逐比下就会出现性能下降。KVzip 的实际适用性进一步扩展到量化模型和多样化的 KV 缓存结构,突出了其适应性和效率。

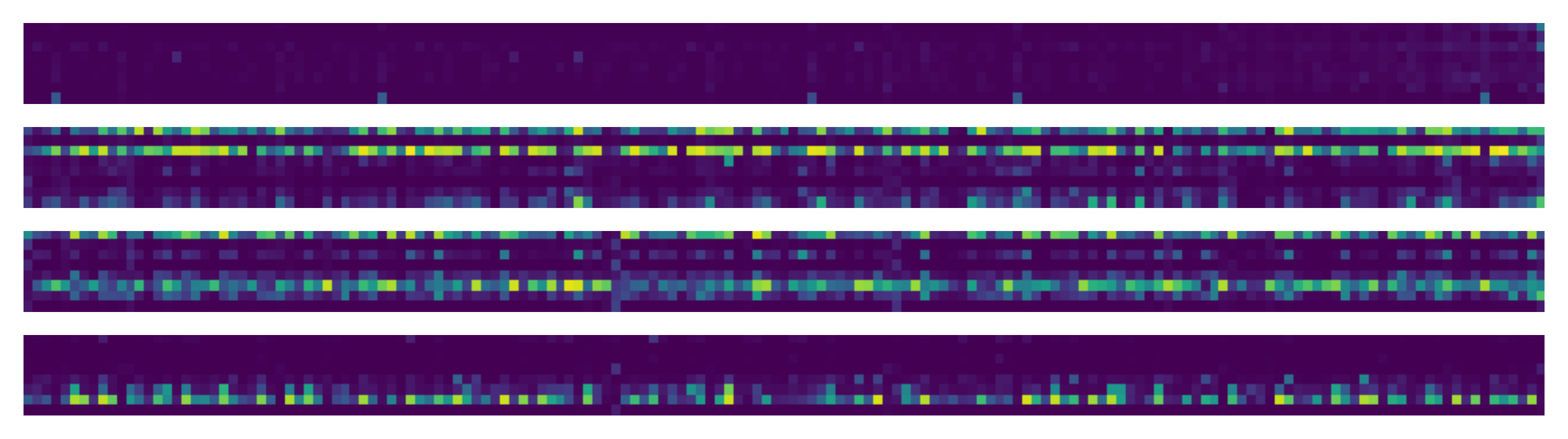

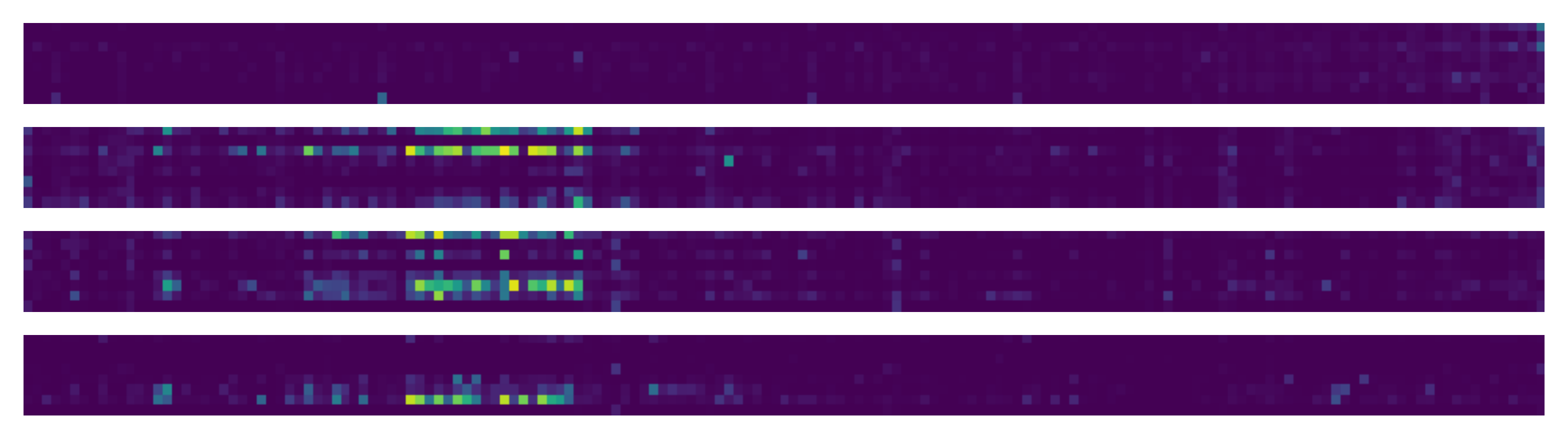

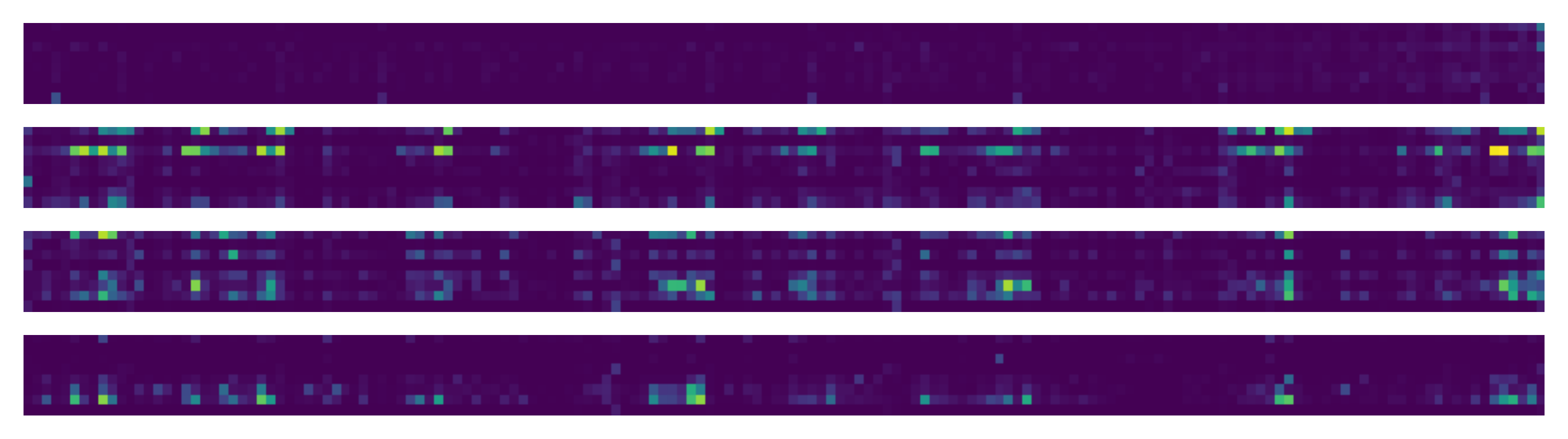

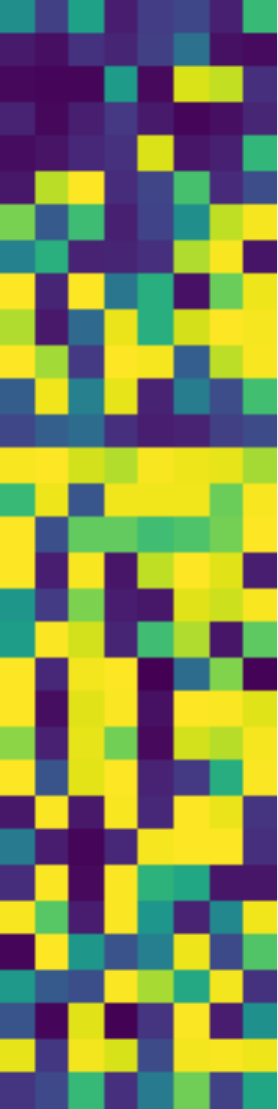

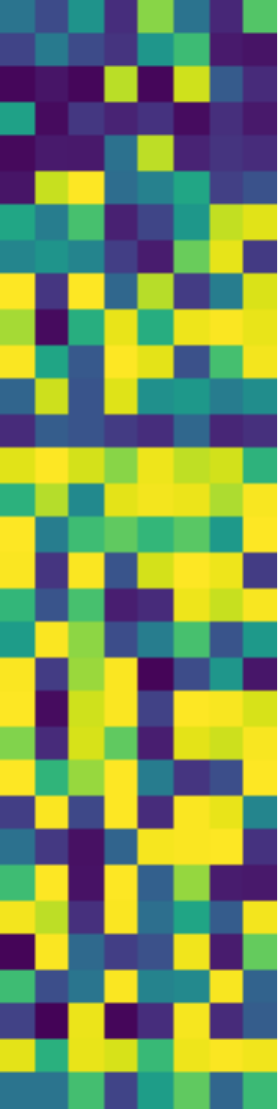

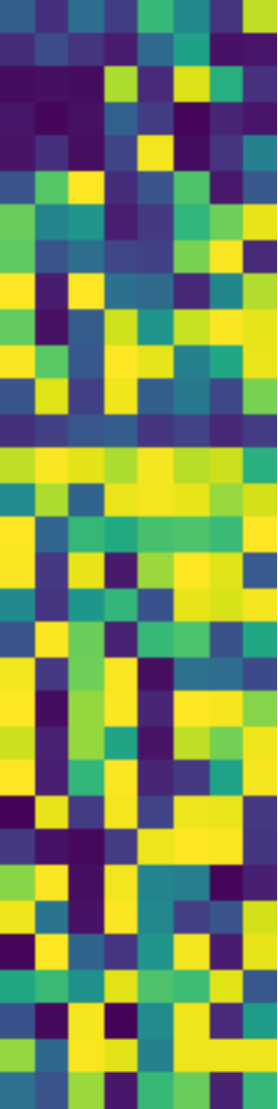

图 8:KV 重要性分数可视化。每个热图可视化了 $\kvc$ 中 KV 对收到的最大注意力分数。

图 9:性能结果

图 10:头级别驱逐的平均相对性能

图 11:自注意力 vs 交叉注意力模式对比

四、论文简评

创新点

查询无关的 KV 缓存压缩框架:提出了一种全新的查询无关(query-agnostic)KV 缓存驱逐方法,与现有的查询感知方法形成鲜明对比。核心思想是利用 LLM 自身从缓存的 KV 对重建原始上下文的能力来评估各 KV 对的重要性。

上下文重建作为压缩准则:利用自监督学习中的重建原则,将 Transformer 视为上下文编码器-解码器,通过"重复提示 + 上下文"的前向传递来计算 KV 对的重要性分数。这一方法具有良好的泛化能力,因为重建关键的信息对多种下游任务都有贡献。

高效的分块评分算法:为处理长上下文(最长 170K tokens),提出了分块评分方法,将计算复杂度从 $O(n_c^2)$ 降低到 $O(m n_c)$,其中 $m$ 是固定块大小(2K)。

显著的压缩效果:在保持几乎无损性能的前提下,实现了 3-4 倍的 KV 缓存压缩和约 2 倍的注意力延迟降低。

局限性

压缩开销:虽然压缩后可以显著提升推理效率,但压缩过程本身需要额外的计算开销(约 2 倍标准预填充时间)。

理论与保证缺失:本研究主要采用实证方法,缺乏关于压缩导致信息丢失的理论保证。

隐私问题:KV 驱逐可能会引发隐私泄露的担忧,因为某些信息可能在压缩后更容易被模型"忘记"。

应用场景

- 个性化对话智能体:保留用户指令和聊天历史的场景

- 企业检索系统:使用预计算文档 KV 缓存进行检索

- 长文档分析:处理 100K+ tokens 的长文档问答任务

- 资源受限部署:需要在有限 GPU 内存上运行大模型的应用

可改进方向

- 硬件协同优化:开发更高效的 CUDA 内核,进一步减少压缩开销

- 理论分析:提供压缩后信息保留程度的理论保证

- 与其他技术的集成:与更先进的量化方法、剪枝技术结合

- 动态压缩策略:根据查询类型动态调整压缩比例

报告生成日期:2026-03-19