ARLArena: A Unified Framework for Stable Agentic Reinforcement Learning

一、论文摘要

智能体强化学习(Agentic Reinforcement Learning, ARL)作为训练智能体解决复杂多步交互任务的前沿范式,已展现出令人鼓舞的初步成果。然而,ARL 训练过程高度不稳定,常常导致训练崩溃。这种不稳定性限制了向更大规模和更长交互 horizon 的扩展,也制约了对算法设计选择进行系统化探索。

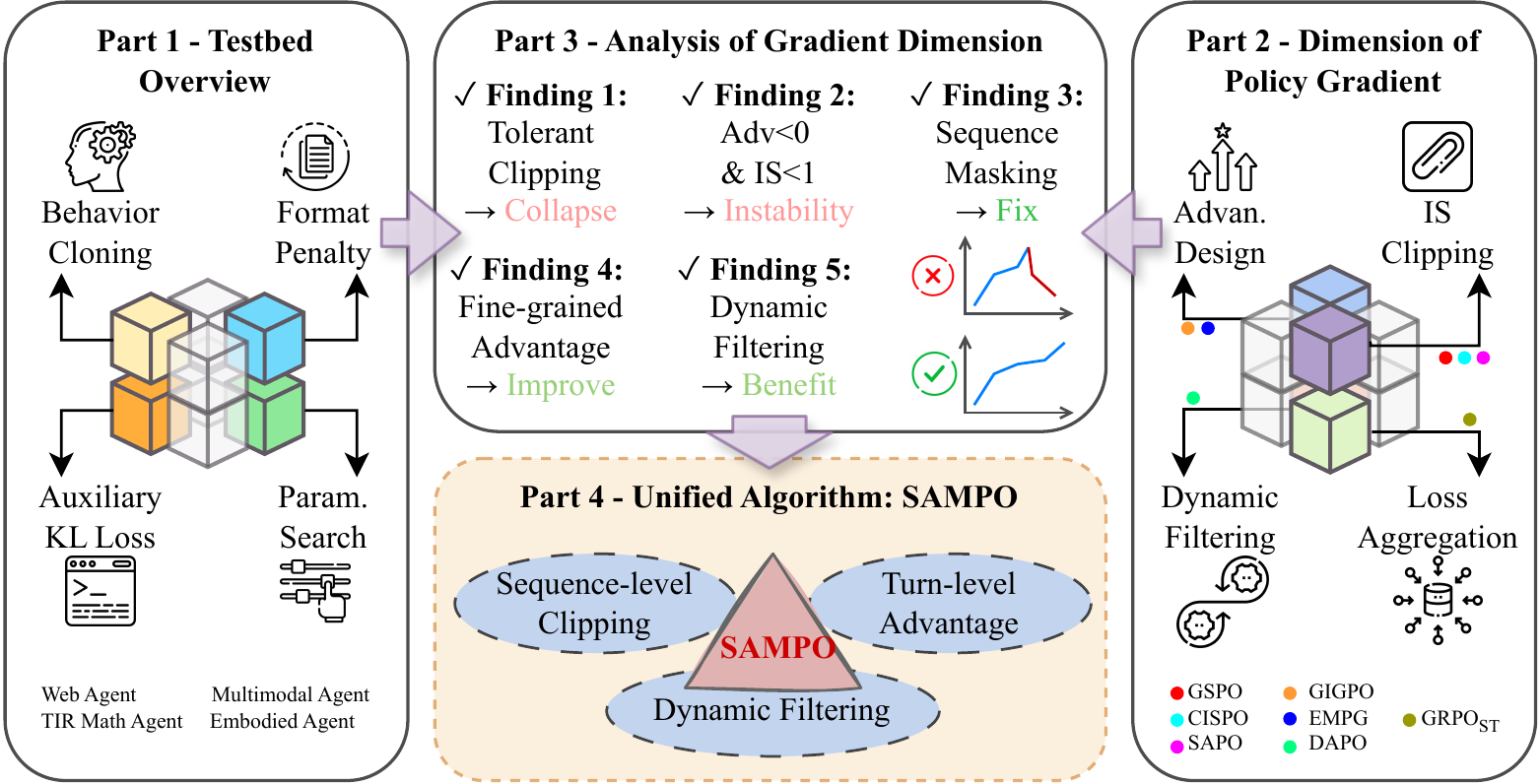

本文首先提出 ARLArena,这是一个稳定的训练方案和系统性分析框架,用于在可控且可复现的环境中研究训练稳定性。ARLArena 首先构建了一个干净、标准化的测试平台,然后将策略梯度分解为四个核心设计维度,并评估每个维度的性能和稳定性。通过这种细粒度分析,我们提炼出对 ARL 的统一视角,并提出 SAMPO(Stable Agentic Multi-turn Policy Optimization),这是一种稳定的智能体策略优化方法,旨在缓解 ARL 中主要的稳定性问题。

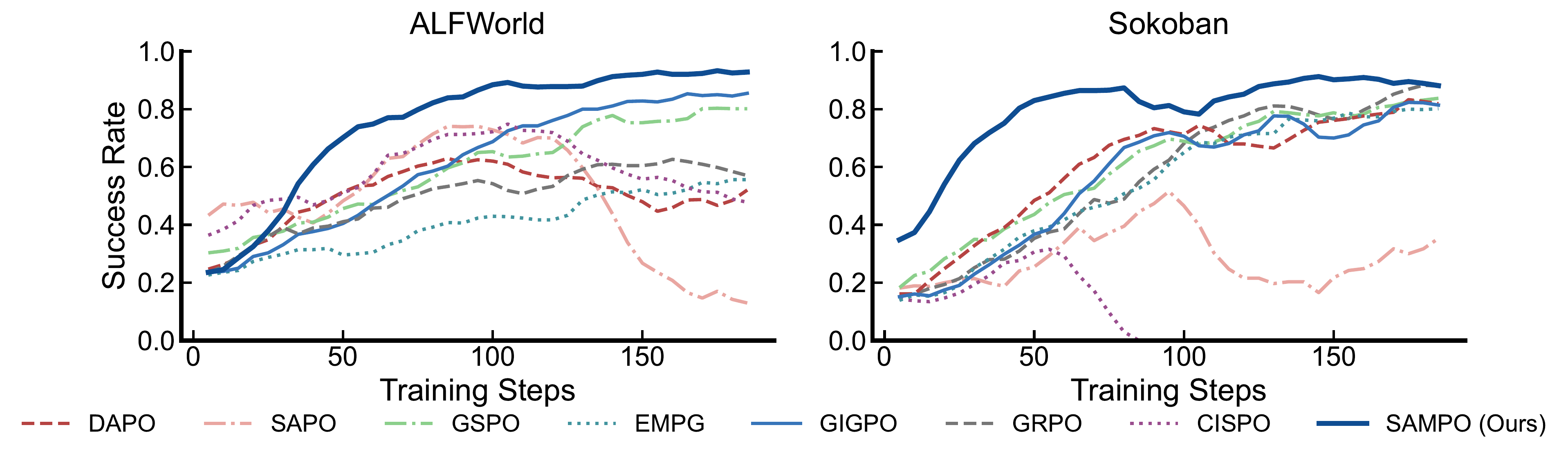

经验性地看,SAMPO 在各种智能体任务中实现了持续稳定的训练和强劲的性能。总体而言,本研究为 ARL 提供了一个统一的策略梯度视角,并为构建稳定且可复现的基于 LLM 的智能体训练流程提供了实践指导。

二、基本信息

| 项目 | 内容 |

|---|---|

| 论文 ID | 2602.21534 |

| 标题 | ARLArena: A Unified Framework for Stable Agentic Reinforcement Learning |

| 作者 | Xiaoxuan Wang, Han Zhang, Haixin Wang, Yidan Shi, Ruoyan Li, Kaiqiao Han, Chenyi Tong, Haoran Deng, Renliang Sun, Alexander Taylor, Yanqiao Zhu, Jason Cong, Yizhou Sun, Wei Wang |

| 单位 | University of California, Los Angeles; University of Wisconsin--Madison |

| 原文保存位置 | ~/.openclaw/workspace/papers/20260309_Transformers/source/ |

| 报告生成日期 | 2026-03-09 |

三、论文主体分析

1. Introduction

大型语言模型(LLMs)越来越多地被部署为自主智能体,用于解决复杂的多步交互任务,涵盖网页导航、具身环境、游戏和深度研究等领域。这些任务需要规划、工具使用和长程决策,这使得训练目标能够捕捉多轮交互变得至关重要。强化学习(RL)为这一目的提供了一个原则性的后训练框架,其在静态推理任务(例如 DeepSeek-R1、OpenAI o1)中已取得成功,智能体设置中的早期结果也很有前景。

然而,智能体 RL(ARL)训练仍然高度不稳定,容易崩溃。这种不稳定性源于智能体环境的多轮交互特性,引入了一系列挑战:无效动作、稀疏奖励、长程信用分配和非平稳的智能体-环境动态。早期决策中的微小偏差可能会级联传播,导致分布偏移,从而放大信用分配噪声并产生退化 rollout。因此,ARL 结果在不同运行和环境之间难以复现,向更长 horizon 或更复杂交互空间的扩展仍然受到严重限制。

本文通过引入 ARLArena 来解决这一空白,这是一种用于智能体强化学习的稳定训练方案和系统性分析框架。我们首先通过格式校正、行为克隆初始化和基于 KL 的正则化构建一个干净、标准化的测试平台,建立可靠的基线性能。然后,我们将基于策略梯度的 RL 分解为四个正交设计维度,并评估每个维度在各种智能体任务中的有效性和稳定性。每个维度都使用代表性策略优化(PO)方法进行单独研究;对于表现出训练崩溃的方法,我们进一步诊断潜在的失败模式并开发针对性的稳定化策略。

这一系统性分析产生了三个关键发现:(1)容错裁剪导致训练崩溃,而序列级裁剪确保稳定改进;(2)将环境级信息纳入优势设计可以提高稳定性和性能;(3)动态采样结合细粒度优势设计进一步有利于 ARL 训练。

基于这些见解,我们提出 SAMPO(Stable Agentic Multi-turn Policy Optimization),这是一种统一的 PO 方法,直接解决我们分析中识别出的主要不稳定源。SAMPO 持续提高训练稳定性和性能,相比 GRPO 基线平均提升 25.2%。我们还研究了离策略过期在智能体环境中的影响,并与专有模型进行了比较评估,展示了方法的鲁棒性和通用性。

贡献总结:

- 为 ARL 提供统一的策略梯度视角和 PO 方法的四维分类;

- 为多轮 ARL 稳定性提供标准化、可复现的测试平台和诊断方法;

- 为常见崩溃模式提供原则性、任务鲁棒的发现和补救措施;

- SAMPO 一种新的 PO 方法,实现可靠的训练和强劲的最终性能。

图 1:ARLArena 概览。第一部分:通过行为克隆、格式惩罚、KL 正则化和超参数搜索构建标准化测试平台。第二部分:策略梯度分解为四个维度,每个维度有代表性方法映射。第三部分:关于训练稳定性和崩溃模式的关键发现。第四部分:将见解统一为 SAMPO 用于稳定的 ARL 训练。

:::

2. Problem Formulation

2.1 Policy Gradient for Agentic RL

在 LLM 的 RL 优化过程中,策略 $\pi_\theta$ 生成以提示 $x$ 为条件的响应轨迹 $y = (y_0, \dots, y_T)$,随后用于策略更新。遵循 PPO 风格的优化,在行为策略 $\pi_{\theta_{\mathrm{old}}}$ 下收集的轨迹用于更新当前策略 $\pi_\theta$。对应的策略梯度可以写成:

$$\nabla_\theta \mathcal{L}(\theta) = \mathbb{E}_{y \sim \pi_{\theta_{\texttt{old}}}} \Bigg[ \sum_{t=0}^{T} w_t(y) \nabla_\theta \log \pi_\theta(y_t \mid x, y_{<t}) \; A(x,y) \Bigg]$$其中重要性采样权重为:

$$w_t(y) = \frac{P_\theta(y_t \mid x, y_{<t})}{P_{\theta_{\texttt{old}}}(y_t \mid x, y_{<t})} = \frac{\pi_\theta(y_t \mid x, y_{<t})}{\pi_{\theta_{\texttt{old}}}(y_t \mid x, y_{<t})}$$这里 $A(x,y)$ 表示采样序列的优势。

Agentic RL

智能体在 $K$ 轮中与环境交互,形成长程决策过程。每一轮,策略以累积的历史为条件生成响应,从中提取动作并在环境中执行,导致环境状态转换。

初始用户提示为 $x^{(1)}$。在第 $k$ 轮,策略生成响应 $y^{(k)} \sim \pi_\theta(\cdot \mid x^{(k)})$。给定环境状态 $s^{(k)}$,从 $y^{(k)}$ 中提取动作 $a^{(k)}$,环境根据更新函数 $f$ 转换到下一状态 $s^{(k+1)} = f(a^{(k)}, s^{(k)})$。第 $k+1$ 轮的用户提示 $x^{(k+1)}$ 由更新后的状态 $s^{(k+1)}$ 构造。最终,多轮交互轨迹定义为 $\tau = (x^{(1)}, y^{(1)}, x^{(2)}, y^{(2)}, \dots, x^{(K)}, y^{(K)})$。

在上述多轮智能体-环境设置中,我们将 $K$ 轮轨迹分解为单轮更新,得到智能体 LLM 交互的策略梯度公式:

$$\nabla_\theta \mathcal{L}(\theta) = \mathbb{E}_{\tau \sim \pi_{\theta_{\texttt{old}}}} \Big[ \sum_{k=1}^{K} \sum_{t=0}^{T_k} \underbrace{w_t(y^{(k)})}_{\text{IS}} \underbrace{\nabla_\theta \log \pi_\theta\left( y^{(k)}_t \mid x^{(k)}, y^{(k)}_{<t} \right)}_{\text{Log prob}} \, \underbrace{A(x^{(k)}, y^{(k)})}_{\text{Advantage}} \Big]$$2.2 Policy Gradient Decomposition Dimensions

根据上述公式,智能体 LLMs 的策略梯度公式可以分解为四个关键研究维度:

- Loss Aggregation(损失聚合)

- Importance Sampling (IS) Clipping(重要性采样裁剪)

- Trajectory Filtering and Resampling(轨迹过滤和重采样)

- Advantage Design(优势设计)

Loss Aggregation

在实践中,我们使用不同的损失聚合方案来近似损失目标:

$$\mathcal{L}(\theta) = \mathbb{E}_{y^{(i)} \sim \pi_{\theta_{\mathrm{old}}}} \Big[ \mathbb{E}_t[\ell_{i,t}(\theta)] \Big]$$两种聚合方式:

- seq-mean-token-mean:每个 token 按其轨迹长度的倒数加权

- token-mean:对批次中所有未 mask 的 token 赋予相等权重

IS Clipping

裁剪方法通过限制相对于旧策略的动作概率变化幅度来约束策略更新。损失目标为:

$$\mathcal{L}(\theta) = \frac{1}{\sum_{i=1}^{N} T_i} \sum_{i=1}^{N} \sum_{t=0}^{T_i-1} \min\Big( w_{i,t}(\theta) A_i, \; \mathrm{clip}\big(w_{i,t}(\theta), 1 \pm \varepsilon\big) A_i \Big)$$本文考虑了多种裁剪变体:CISPO(使用 stop-gradient 机制)、SAPO(采用软裁剪策略)、GSPO(使用序列级重要性比率作为裁剪标准)。

Trajectory Filtering and Resampling

动态采样解决了长程智能体训练中由零梯度轨迹引起的效率问题:

$$\mathcal{L}(\theta) = \frac{1}{\sum_{i=1}^{N} T_i} \sum_{i=1}^{N} \sum_{t=0}^{T_i-1} \min\Big( w_{i,t}(\theta) A_i, \; \mathrm{clip}\big(w_{i,t}(\theta), 1 \pm \varepsilon\big) A_i \Big), \quad \text{s.t.} \quad 0 < \left| \left\{ y^{(i)} \mid \mathrm{is\_equivalent}(a, y^{(i)}) \right\} \right| < G$$Advantage Design

多轮智能体强化学习引入了额外的交互步骤和显式的智能体-环境状态转换,这推动了专门的优势设计。GiGPO 在状态级别定义优势,EMPG 通过熵依赖项增强优势函数。

3. Experimental Setup

3.1 Standardized Testbed

构建公平有效的算法比较测试平台是一个主要挑战。我们逐步应用表 1 中所示的一系列稳定化策略。

(1)行为克隆(Behavior Cloning)

我们首先在监督交互轨迹上进行行为克隆(BC),将策略初始化到合理的行为流形中。具体来说,我们通过在目标训练环境中部署 Qwen3 系列模型来构建多轮 SFT 数据集,收集自生成的交互轨迹,并仅保留高分 rollouts 进行监督。这一自举 SFT 阶段将策略初始化到与环境动态一致的行为流形中。

(2)格式惩罚(Format Penalty)

我们引入 $\mathcal{R}_{\text{format}}$ 来强制结构化输出,使用显式的 <think> </think> 和 <action> </action> 标签。如果生成的输出违反此格式,我们对最终奖励应用固定惩罚。这种显式结构约束在早期训练期间提供了密集的塑造信号,并大大减少了否则会破坏策略更新的无效 rollouts。

(3)辅助 KL 损失

不受约束的更新可能导致策略过度偏离参考模型。为了正则化策略更新并保留预训练模型中嵌入的先验知识,我们在当前策略 $\pi_\theta$ 和参考策略 $\pi_{\mathrm{ref}}$ 之间引入 KL 散度惩罚。我们采用常用的 Bregman 散度估计器 $k_3$ 进行 KL 近似。

$$k_3(x) = \delta(x) - 1 - \log \delta(x)$$其中 $\delta(x) = \frac{p(x)}{q(x)}$ 表示似然比。

(4)PO 特定超参数网格搜索

我们的解决方案是首先使用默认配置运行每个方法,然后执行 PO 特定超参数网格搜索。我们继续调优,直到训练轨迹变得稳定(以最终 20% 训练步骤的成功率方差低于预定义阈值来衡量)。

3.2 Tasks and Training Details

我们采用 ALFWorld、WebShop、Sokoban 和 TIR Math 作为智能体任务。整个代码库建立在 verl RL 框架之上。我们使用智能体循环架构来协调 rollouts 和环境交互,之后将每个完整轨迹分割成多个单轮样本用于策略优化。对于数学任务,我们使用 Qwen3-4B-base 作为策略模型;对于所有其他任务,我们从 SFT 微调变体 Qwen3-4B 初始化。

图 2:ALFWorld(左)和 Sokoban(右)上的训练曲线。SAMPO(我们的方法)在两个环境中都实现了最高的成功率,在整个训练过程中稳定、单调提升,而基线方法表现出不同程度的 instability。

:::

4. Exploring Gradient Dimensions on ARL

4.1 Impact of IS on ARL

我们沿重要性采样(IS)维度研究 GSPO、CISPO 和 SAPO。GSPO 采用序列级裁剪,而 CISPO 和 SAPO 采用容错裁剪技术。

表显示 CISPO 和 SAPO 在所有任务上的表现都明显不如 GRPO,平均分数分别为 34.03 和 32.22,而 GRPO 为 46.16。相比之下,GSPO 始终优于所有其他策略优化方法,平均比 GRPO 提升 13.3%。

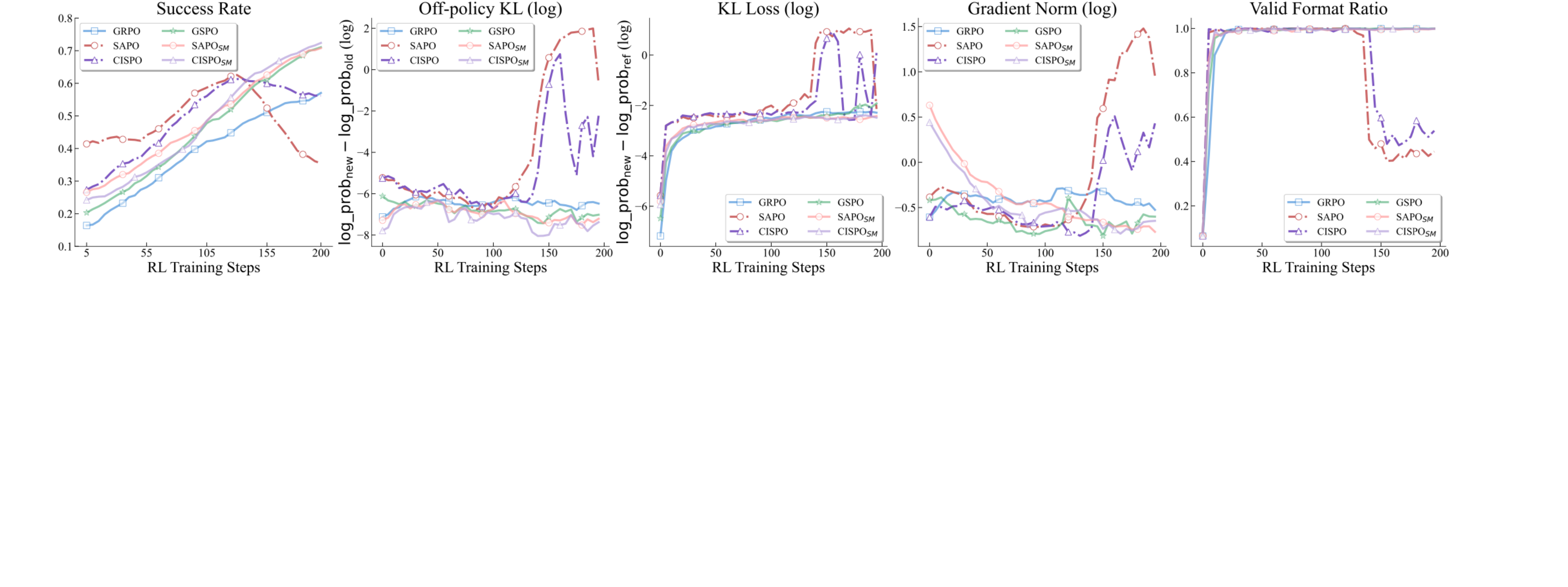

图 3 报告了成功率、旧策略和新策略之间的离策略 KL 散度、新策略和参考策略之间的 KL 损失、梯度范数和 rollout 动作 tokens 的有效格式比率。

CISPO 和 SAPO 具有容错裁剪,表现出快速初始性能提升。这种行为表明更积极的优化。然而,这种激进导致训练不稳定,约在第 130 步发生崩溃。相比之下,GSPO 表现出更稳定的训练模式,性能逐步提升,KL 散度和梯度范数保持稳定。

发现 1:ARL 对 IS 设计高度敏感:容错裁剪产生快速早期收益但导致训练崩溃,而序列级裁剪确保稳定改进。

Root Cause of Training Collapse

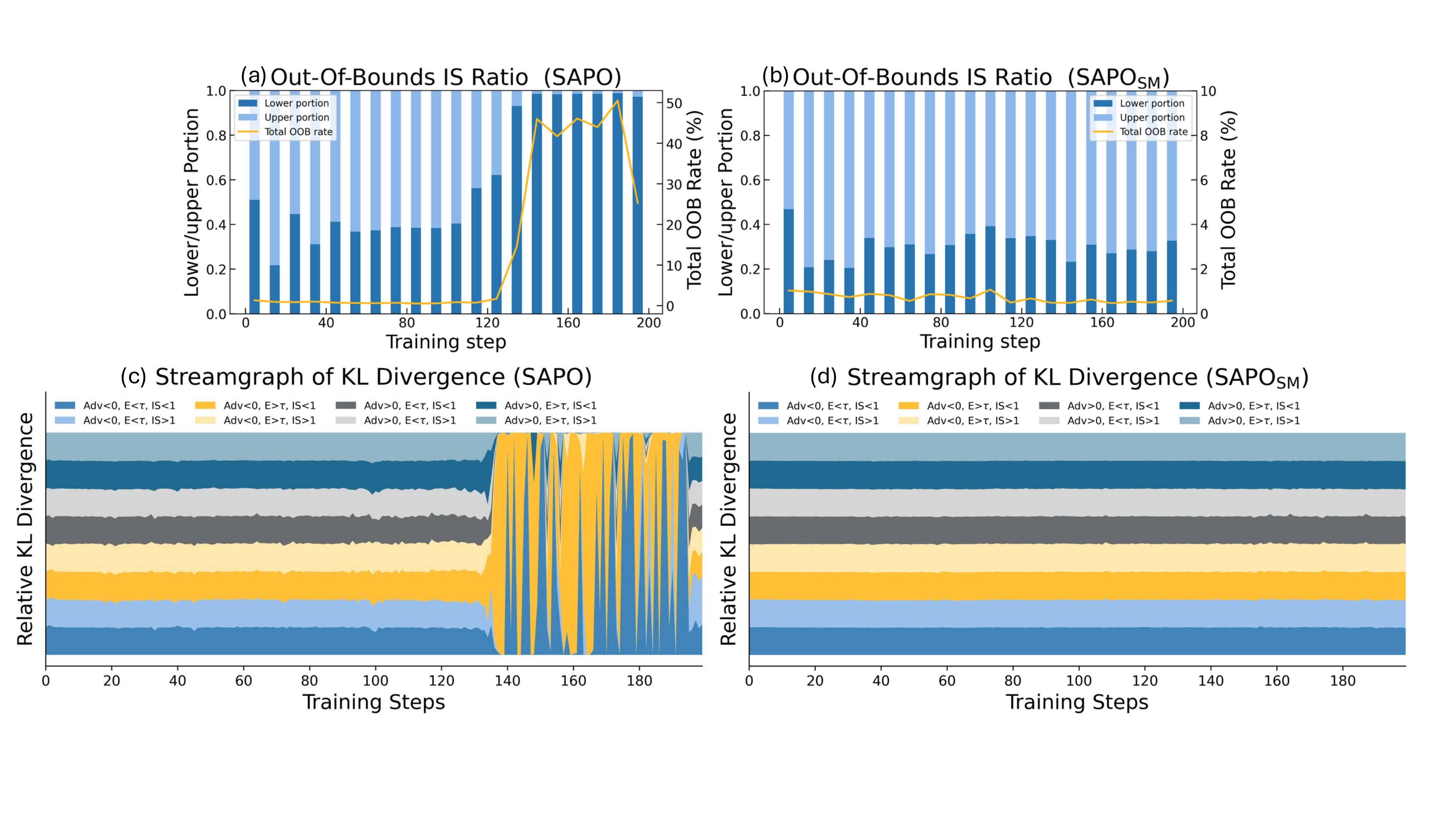

图 4 报告了 SAPO 及其序列 mask 变体 $\text{SAPO}_{\texttt{SM}}$ 的 token 级和序列级 IS 分析。在崩溃阶段,SAPO 表现出快速增长的超界 tokens 数量,主要来自具有小重要性比率的负优势序列。对于稳定训练,超界 tokens 的比例保持相当低。

序列级比较进一步强化了结论:负优势 + 低重要性比率的样本是训练不稳定的主要来源。

Stabilization Strategies for SAPO and CISPO

我们探索了几种稳定 SAPO 和 CISPO 训练的策略。根据图 4 和表,应用序列 mask 将 CISPO 的成功率从 54.12 提高到 78.88,SAPO 从 25.16 提高到 76.92。

发现 2:训练崩溃主要由具有低 IS 比率的负优势序列积累所驱动。对此类序列进行序列 mask 可以稳定训练。

4.2 Impact of Advantage Design on ARL

我们沿优势设计维度研究 GIGPO 和 EMPG。GIGPO 包含来自环境的全局和局部优势信息,实现细粒度优势估计,而 EMPG 通过包含训练数据中的不确定性信息来重塑优势。

表显示 GIGPO 通常优于 GRPO,平均分数 49.71 对比 48.08,在 ALFWorld 上特别提升了 34.4%。

发现 3:在 ARL 中纳入细粒度环境优势可以提高性能。

4.3 Impact of Dynamic Filtering on ARL

动态过滤在数学推理任务上已知的性能提升并不总是能转移到智能体强化学习设置。

发现 4:带 GIGPO 的动态过滤有利于 ARL 的训练稳定性和性能。

4.4 Impact of Loss Aggregation on ARL

序列级均值 token 级损失聚合($\text{GRPO}_{\texttt{ST}}$)相比 token 级均值聚合(GRPO),性能从 46.16 下降到 39.23。

4.5 Further Stability Considerations

由于基础设施和效率约束,策略训练通常在批量 rollouts 中执行。离策略效应在多轮设置中进一步放大,其中轮次级分解增加了受过期影响的样本数量。

实验表明,策略梯度优化对离策略比率敏感。

图 3:六个 IS 变体在 ALFWorld 上的训练动态:GRPO、GSPO、SAPO、CISPO 及其序列 mask 对应物 $\text{SAPO}_{\texttt{SM}}$ 和 $\text{CISPO}_{\texttt{SM}}$。面板显示(从左到右):成功率、旧策略和新策略之间的离策略 KL 散度、新策略和参考策略之间的 KL 损失、梯度范数、rollout 动作 tokens 的有效格式比率。

:::

图 4:SAPO 及其序列 mask 变体 $\text{SAPO}_{\texttt{SM}}$ 的 token 级和序列级 IS 分析。

:::

5. SAMPO

5.1 Motivation

通过沿 ARL 中正交设计维度系统性地分析 PO,我们可以确定决定训练稳定性和优化效率的关键因素。

在初始化阶段,格式错误和无效动作 tokens 引起严重的优化噪声。我们通过行为克隆和显式格式校正消除这些失败模式,将学习限制在有效的行为流形中。

沿重要性采样维度,序列级裁剪而非 token 级约束对长程 ARL 至关重要。这种机制通过抑制有害轨迹来解决离策略漂移,并在训练稳定性方面产生实质性改进。

对于优势设计,我们的分析表明,在更细粒度上增加优势多样性对于克服稀疏奖励至关重要。整合全局和局部信号显著增强了信用分配。

最后,我们展示了动态轨迹过滤通过去除具有退化优势的样本来稳定梯度更新,从而产生更信息丰富和有效的策略梯度。

5.2 Our Method

基于这一统一理解,我们提出 SAMPO,这是一种建立在这些原则之上的新 PO 范式。SAMPO 将序列级裁剪、细粒度优势估计和动态过滤整合到一个统一的框架中,形成一个稳定且可扩展的 ARL 解决方案。其公式为:

$$\mathcal{L}(\theta) = \frac{1}{\sum_{i=1}^{N} T_i} \sum_{i=1}^{N} \sum_{t=0}^{T_i-1} \min\Big( s_i(\theta) A_i^{'}, \; \mathrm{clip}\big(s_i(\theta), 1 \pm \varepsilon\big) A_i^{'} \Big), \quad \text{s.t.} \quad 0 < \left| \left\{ y \mid \mathrm{is\_equivalent}(a, y) \right\} \right| < G$$其中 $A_i^{'} = A_i + \omega \cdot A_{\text{step}}(\hat{y}_{i,k})$,$s_i(\theta) = \exp\Big( \frac{1}{|T_i|} \sum_{t=0}^{|T_i|-1} \log \frac{\pi_\theta(y_t \mid x, y_{<t})}{\pi_{\theta_{\texttt{old}}}(y_t \mid x, y_{<t})} \Big)$。

在所有评估的智能体任务中,SAMPO 一致性地实现了表 3 中显示的最强整体性能。与仅修改一个维度的方

法相比,SAMPO 表明结合多个设计维度对于稳定和有效的 ARL 是必要的。值得注意的是,SAMPO 在长程交互任务(如 ALFWorld)上提供了特别大的改进,突出了智能体设置中序列感知控制的重要性。这些结果验证了我们中心主张:稳定的智能体 PO 方法需要同时满足多个必要条件,而不是依赖孤立的算法修改。

SAMPO 相比 GRPO 基线平均提升 25.2%,展现出强大的训练稳定性和最终性能。

5.3 Benchmarking against Inference Paradigms

为了进一步 contextualize SAMPO 的性能,并评估一个用稳定 RL 训练的小型开源模型是否能与最先进推理策略竞争,我们将 ARLArena 与前沿闭源模型和复杂多智能体工作流进行基准测试。这一比较验证了一个关键假设:原则性 RL 训练在智能体任务中可能比在通用模型上进行重型推理时工程提供更大的收益。

实验设置和结果:我们在 ALFWorld 和 WebShop 上评估 GPT-5.2、o3 和 Gemini 2.5 Pro,考虑两种主要范式:

- 单 LLM 作为智能体(SLA):模型遵循标准化协议与环境交互;

- 多智能体系统(MAS):具有 Debate 和 Aggressive Debate 协调策略。

使用 SAMPO 后训练的 Qwen3-4B-RFT 在 ALFWorld 上实现了 92.72% 的全任务成功率,显著优于 GPT-5.2(51.56%)和基于 o3 的 MAS(56.25%)。使用 SAMPO 优化的开源模型始终超过更大的闭源模型,表明规模和复杂推理无法替代稳定、环境对齐的 ARL 训练。

6. Insights for Future Work

基于我们对 ARL 中策略梯度设计选择的系统分析,我们确定了几个值得深入探索的有前景的方向。

(1)清洁训练方法是复杂推理的基础

ARLArena 揭示了 ARL 对初始化和早期训练动态非常敏感。精心构建的清洁设置,结合短监督冷启动 SFT、格式强制结构约束和保守 KL 正则化,对于解锁稳定的多轮推理行为至关重要。没有这种受控配方,策略梯度信号很容易被畸形轨迹或提前崩溃所破坏。这表明未来研究应将训练方法视为辅助技巧,而是定义复杂推理策略可以出现的可行区域的基本算法组件。

(2)IS 裁剪高度敏感,而优势设计提供相对稳定的收益

在我们检查的策略梯度维度中,IS 裁剪策略表现出高度敏感性:裁剪阈值或比率参数化的微小变化会极大地影响稳定性。相比之下,优势设计在任务中倾向于提供更稳定但相对较小的改进。这些观察表明,IS 裁剪策略代表了一个高风险、高回报的方向,而优势设计在 ARL 中提供更可预测但有限的性能提升。

(3)稳定的 ARL 解锁长程扩展机会

一旦训练崩溃得到缓解,我们观察到智能体策略可以在显著更多的优化步骤中保持性能改进,而不会退化。这种稳定性为扩展交互 horizon 和环境规模打开了大门,类似于监督预训练中的扩展定律。因此,该领域的未来进展将越来越依赖于环境多样性、交互数据量和多任务课程表的扩展。

四、论文简评

创新点

系统性分析框架(ARLArena):本文提出了一个统一的分析框架,将策略梯度分解为四个正交维度(损失聚合、重要性采样裁剪、轨迹过滤、优势设计),为 ARL 研究提供了系统性的分析视角。这种分解方法有助于识别导致训练不稳定的关键因素。

序列级裁剪的发现:论文的重要发现是容错裁剪(tolerant clipping)虽然能带来快速的早期收益,但会导致训练崩溃;而序列级裁剪(sequence-level clipping)能够确保稳定、单调的性能提升。这一发现对 ARL 的实践具有重要指导意义。

崩溃根因分析:论文深入分析了训练崩溃的根本原因,发现具有低重要性采样比率的负优势序列是导致不稳定的主要来源。通过序列掩码(sequence masking)策略可以有效稳定训练。

SAMPO 方法:基于分析结果,论文提出了 SAMPO 方法,将序列级裁剪、细粒度优势设计和动态过滤整合到统一框架中。在多个智能体任务上实现了平均 25.2% 的性能提升。

局限性

测试环境有限:实验主要集中在 ALFWorld、WebShop、Sokoban 和 TIR Math 四个任务上,可能无法完全覆盖所有类型的智能体应用场景。

超参数敏感性:尽管论文对超参数进行了系统性搜索,但某些方法(如 IS 裁剪策略)的敏感性仍然很高,可能需要针对不同任务进行细致的调优。

模型规模:实验主要使用 Qwen3-4B 模型,对于更大规模的模型(如 70B+)的适用性需要进一步验证。

应用场景

LLM 智能体后训练:本文的方法适用于训练用于网页导航、具身智能体、游戏 AI 和自动化研究等场景的 LLM 智能体。

多轮对话系统:ARL 方法可用于训练需要长程交互和工具使用的对话系统。

复杂任务自动化:在需要多步骤规划、工具调用和长期决策的复杂任务中具有应用价值。

可改进方向

更大规模验证:在更大规模的模型和环境上进行验证,验证方法的可扩展性。

端到端训练:当前框架依赖于行为克隆初始化,未来可以探索端到端的训练方法,减少对监督数据的依赖。

多智能体设置:将分析扩展到多智能体协作场景,研究智能体间通信和协调对训练稳定性的影响。

更丰富的环境类型:扩展到更多类型的智能体环境,如代码生成、科学发现等。

本报告由 arxiv-paper-reader 自动生成